Construction and Recognition Performance Analysis of Wide-swath SAR Maritime Large Moving Ships Dataset

-

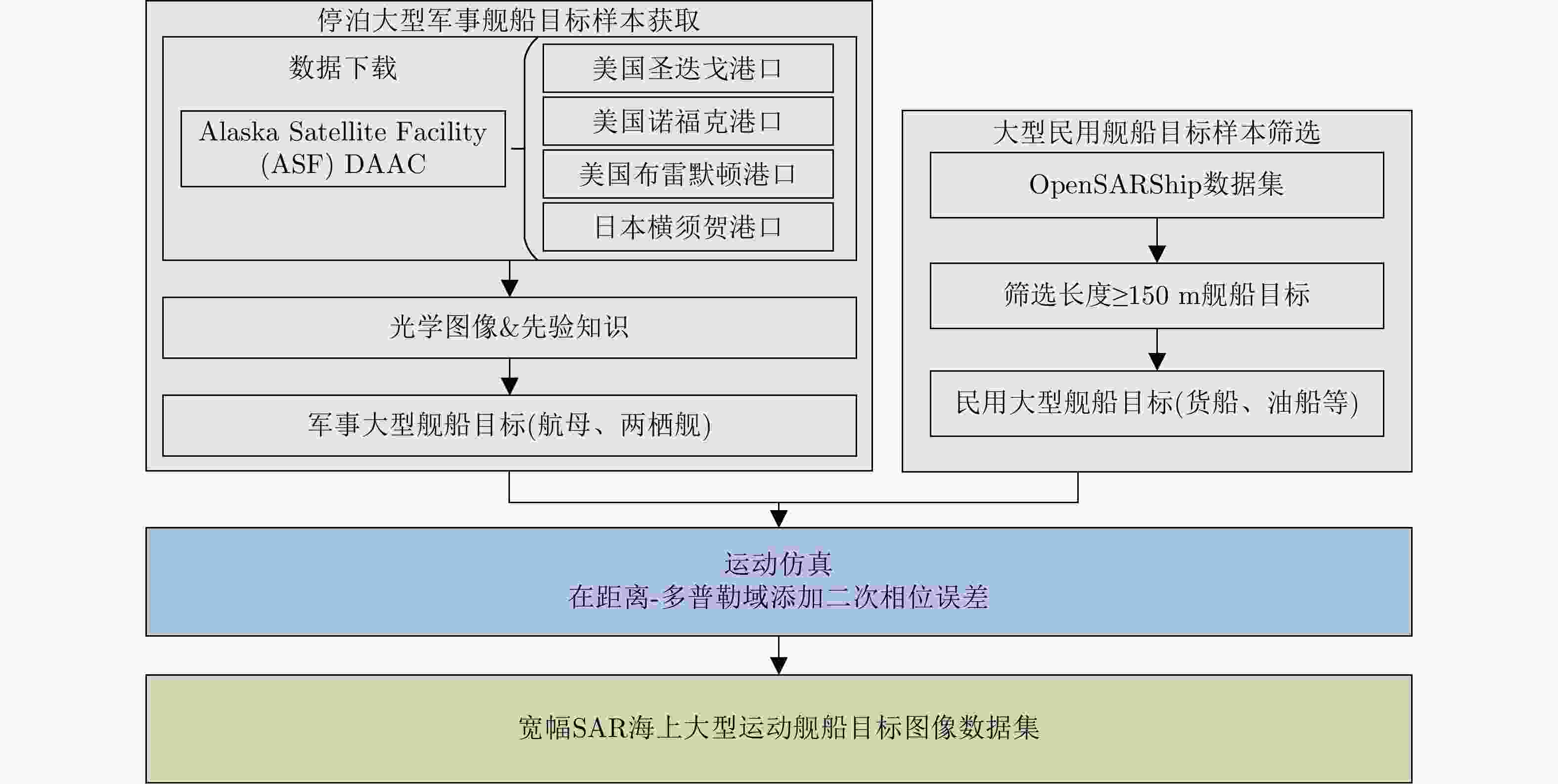

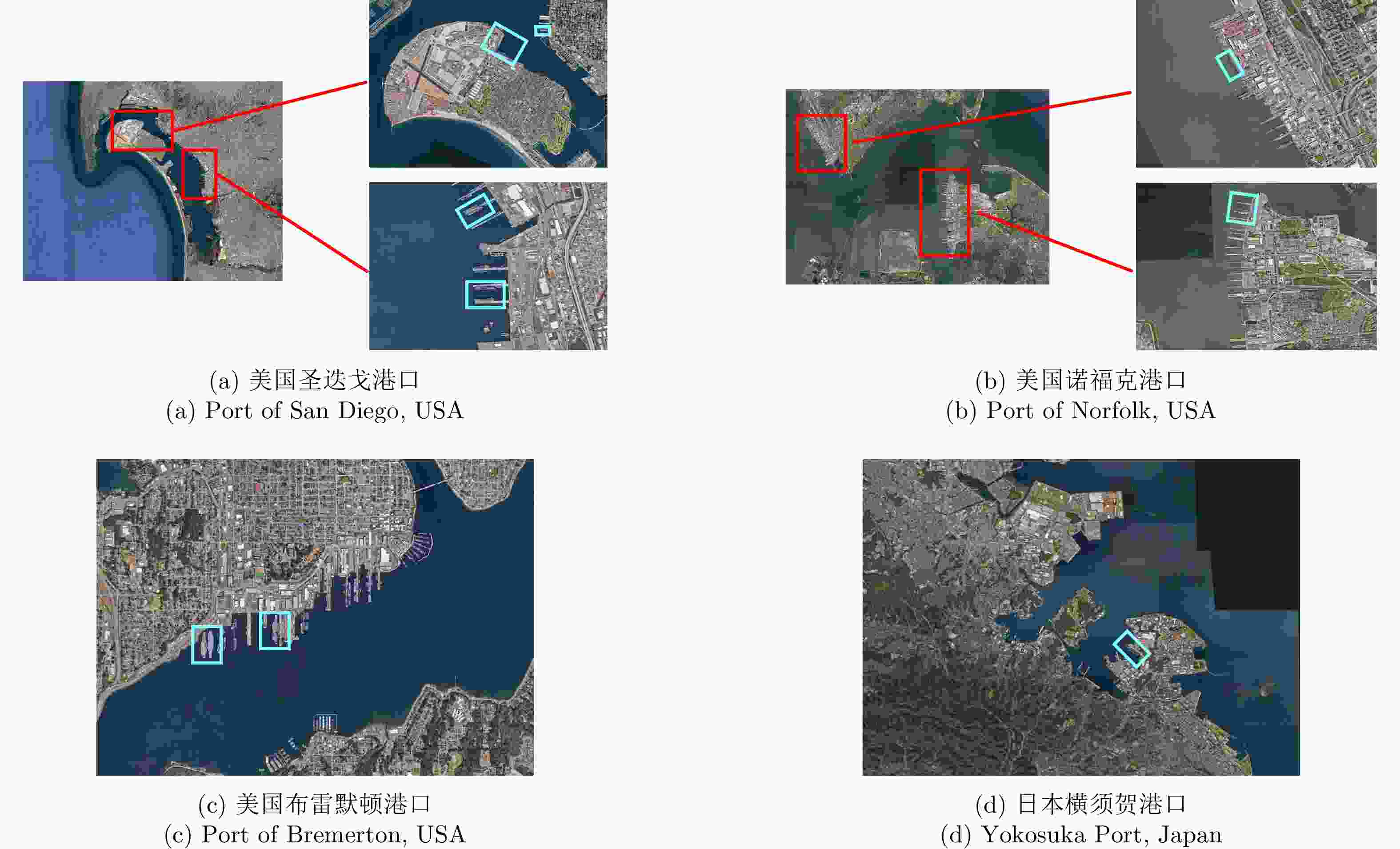

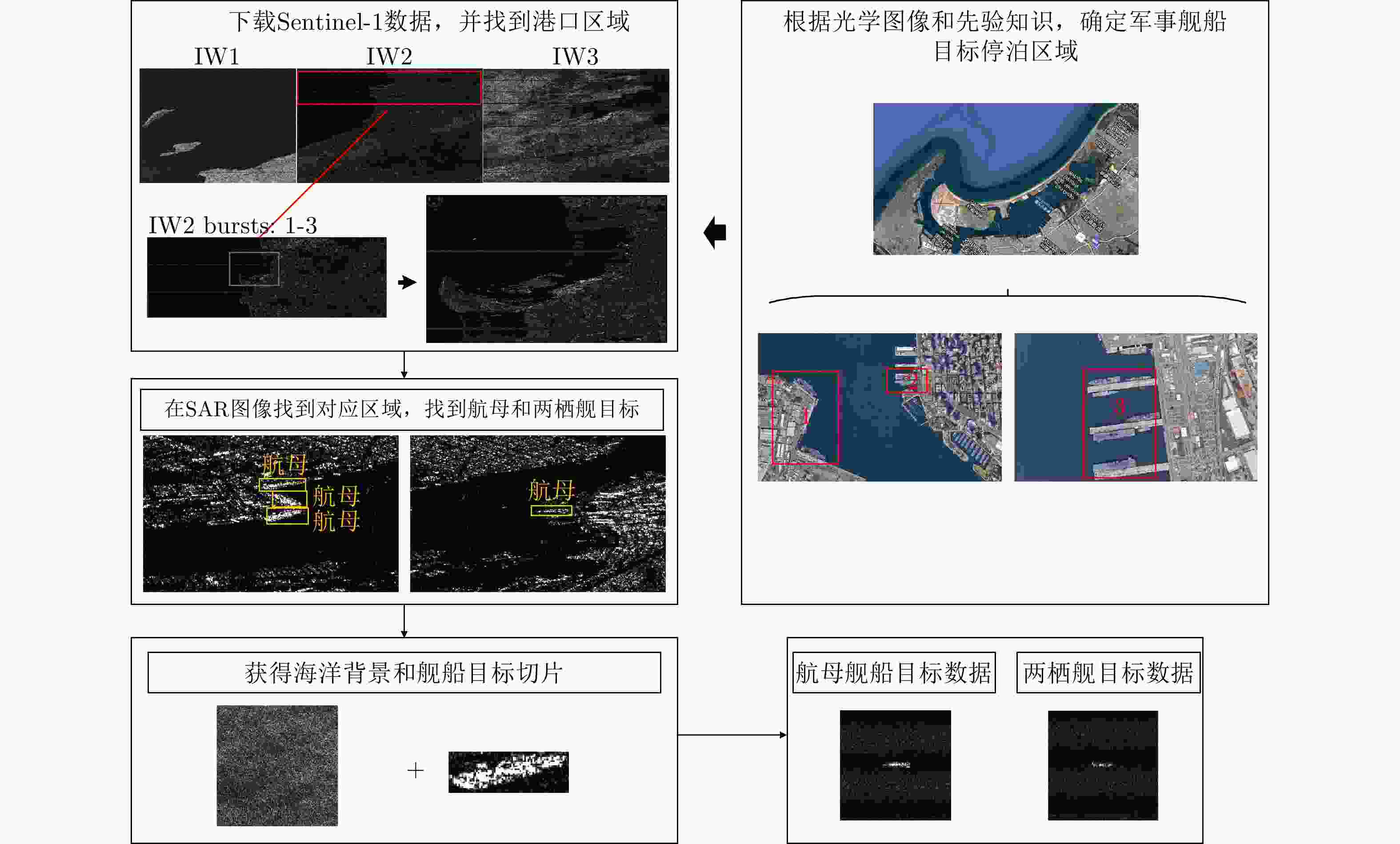

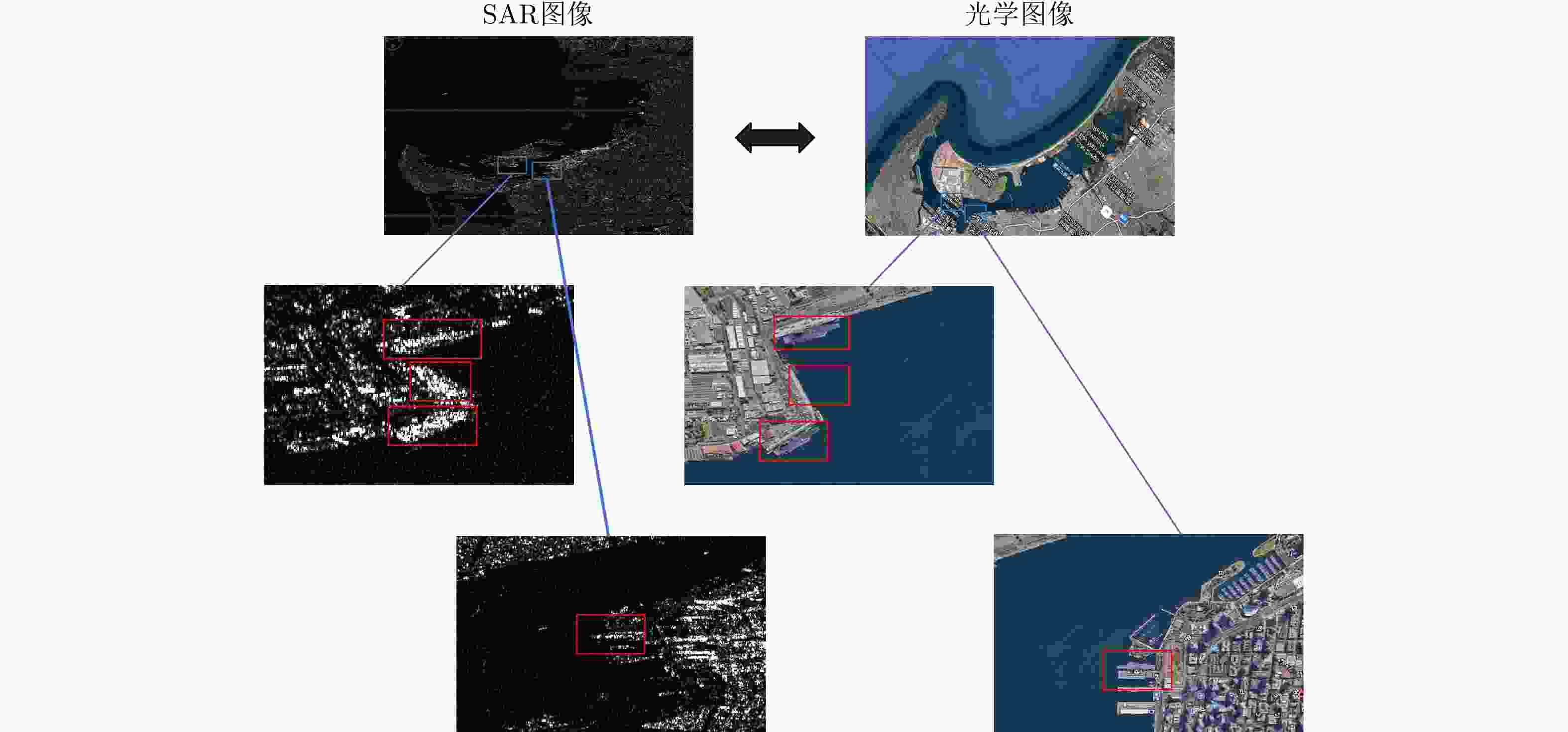

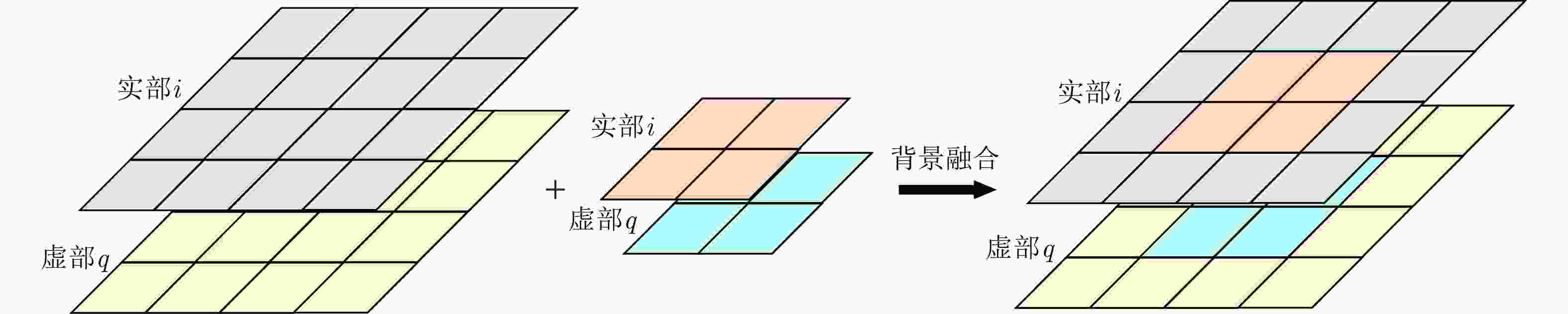

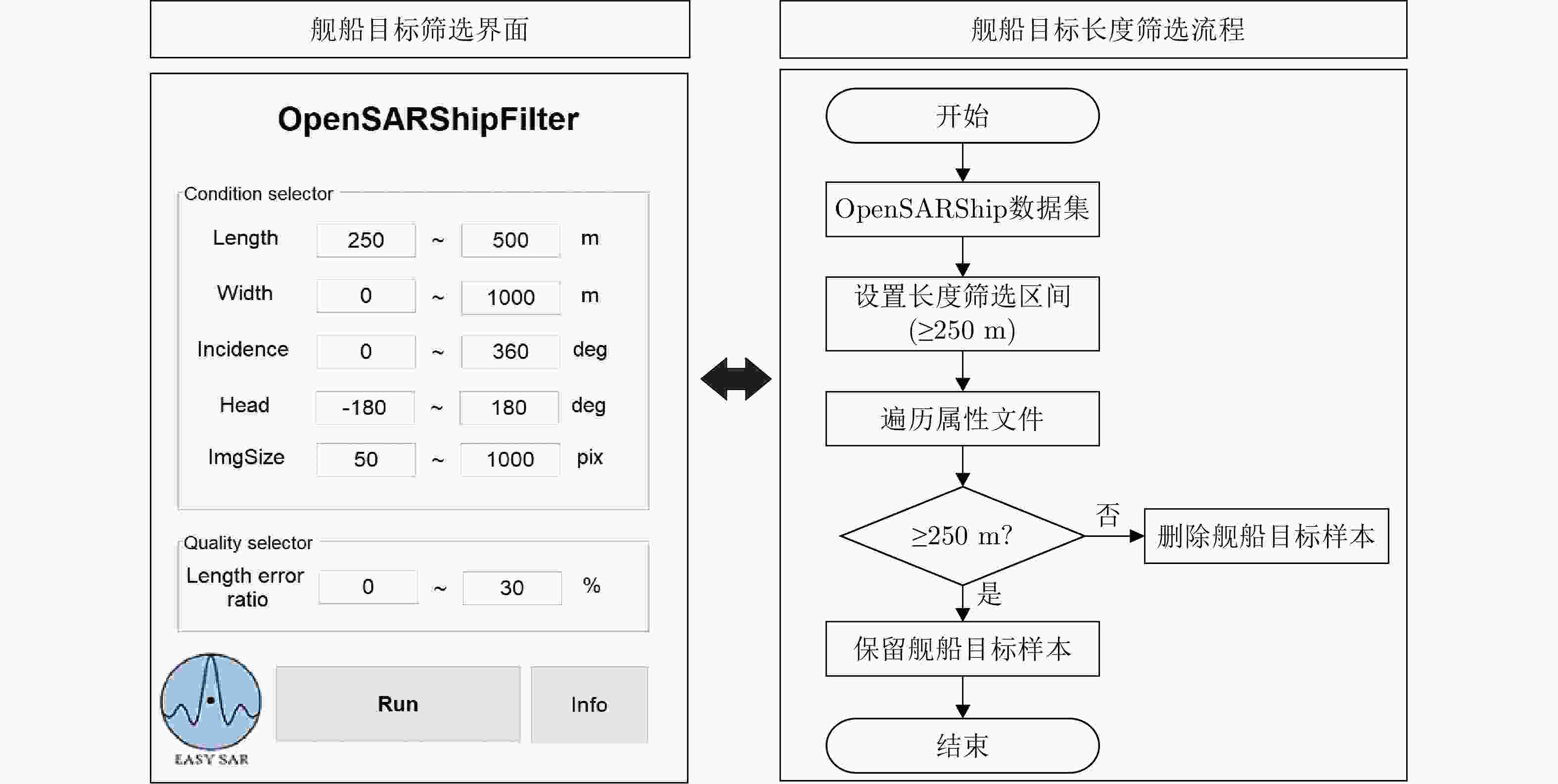

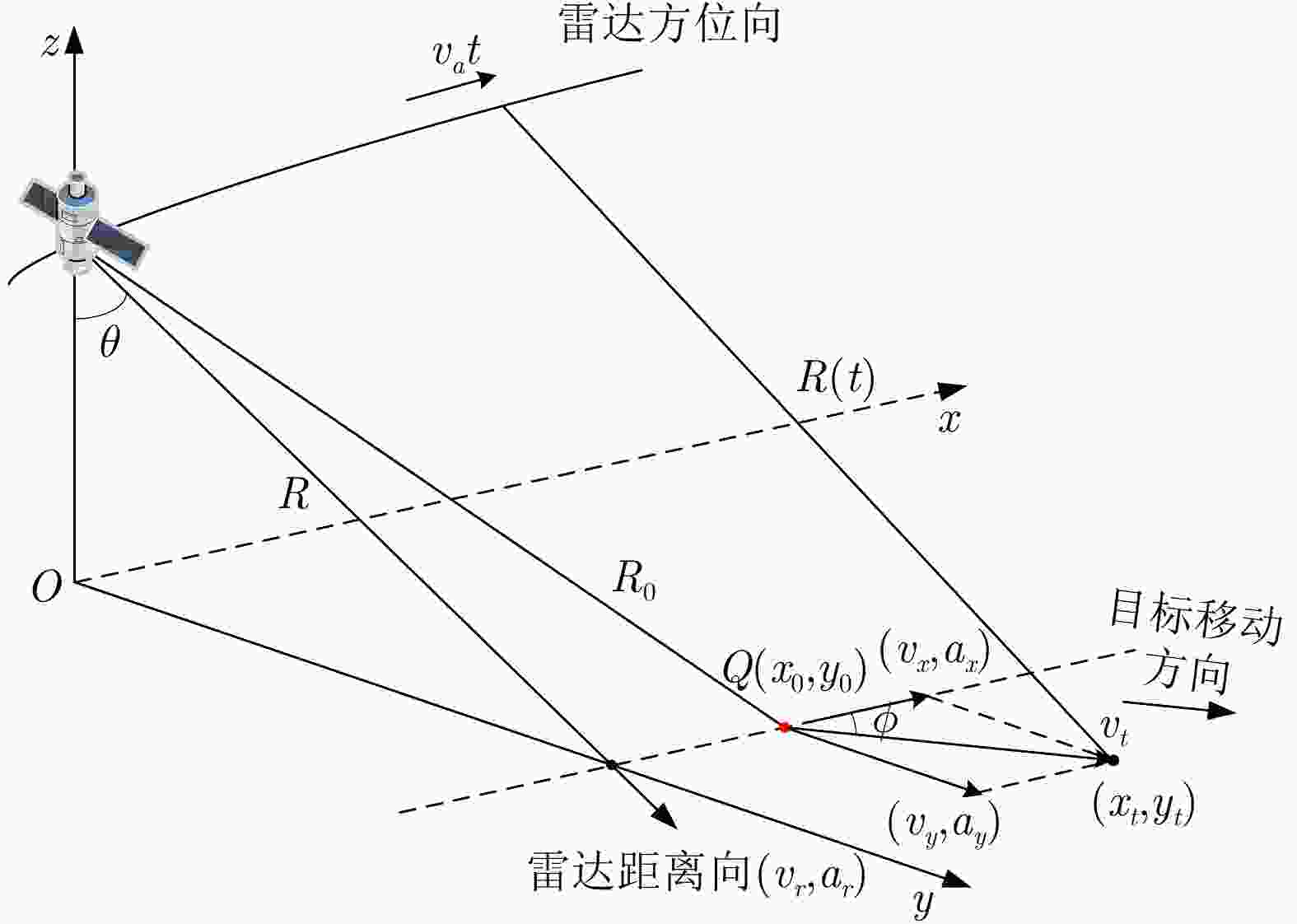

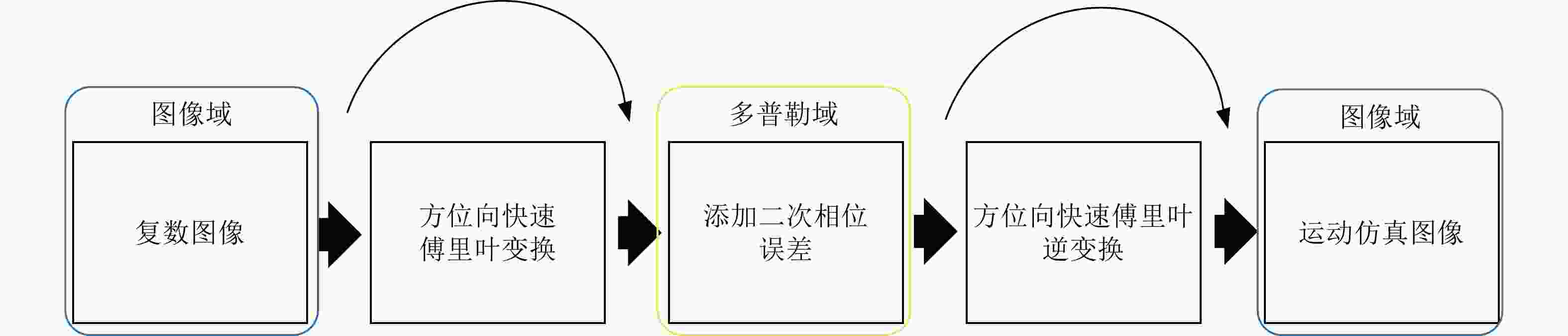

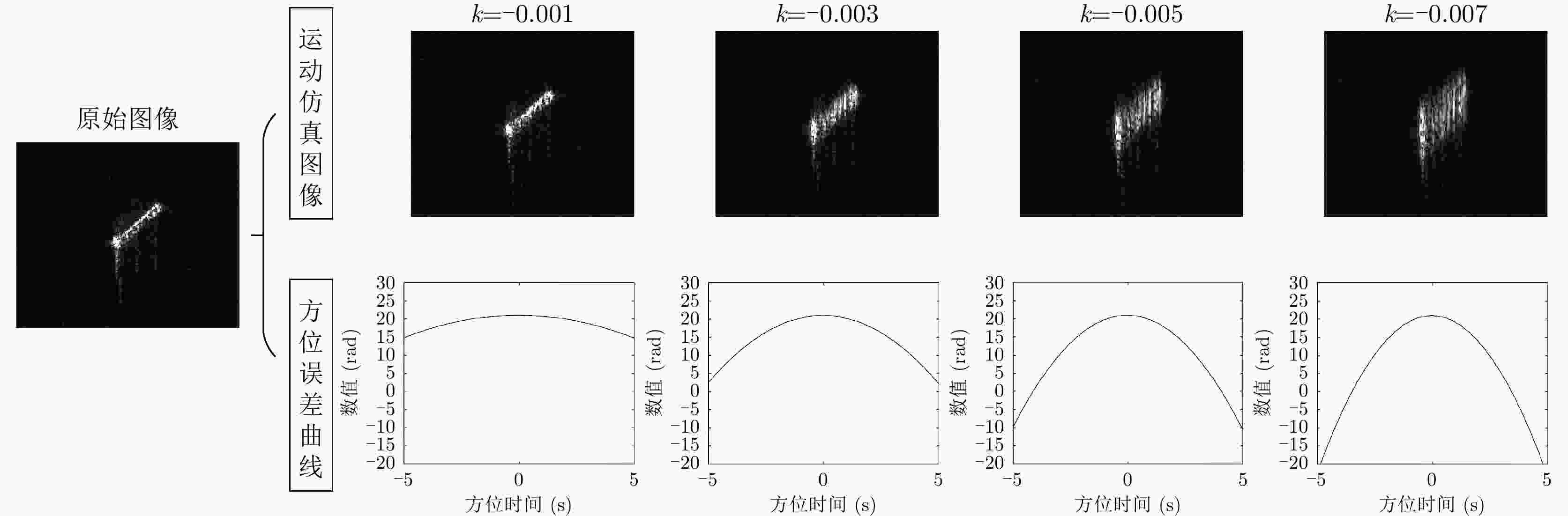

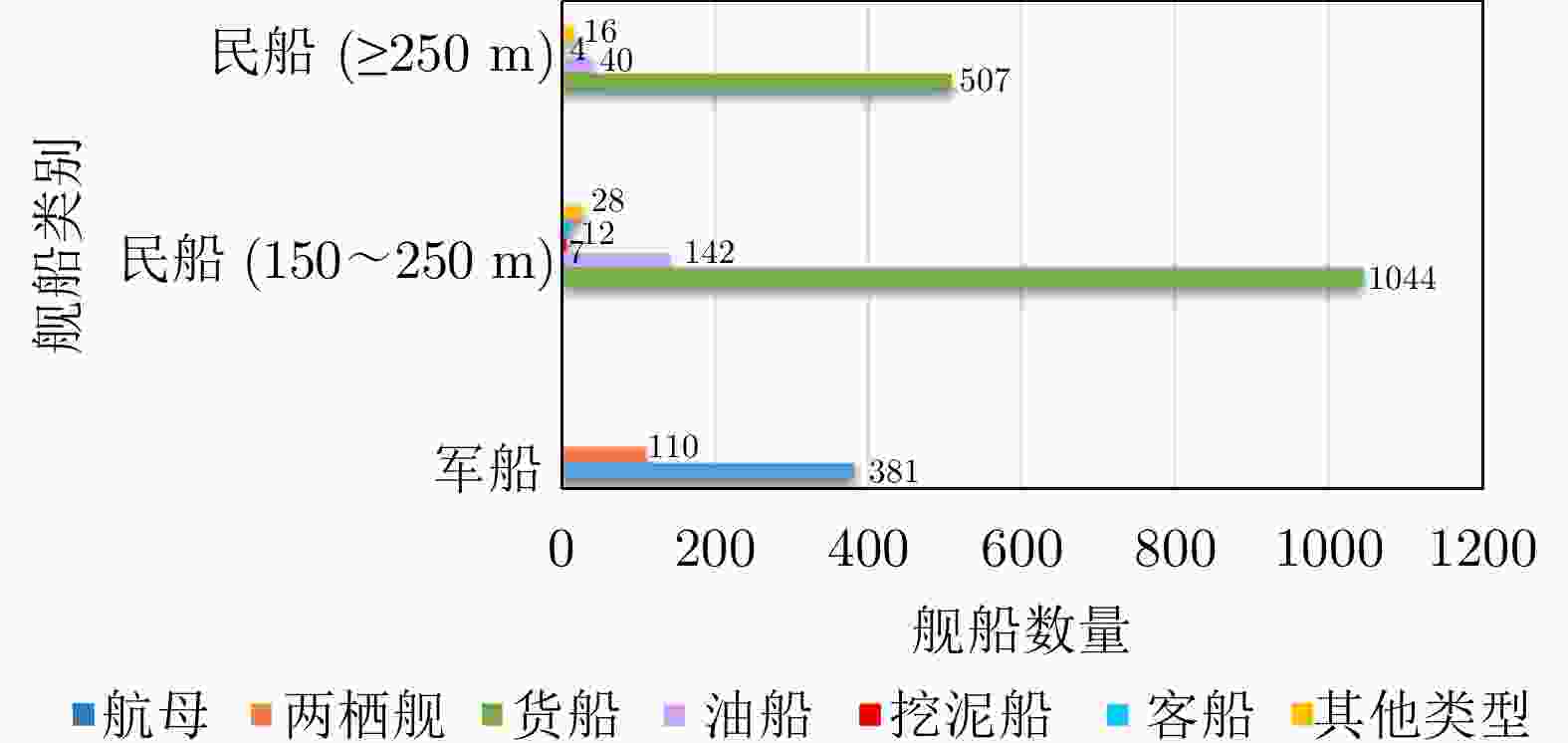

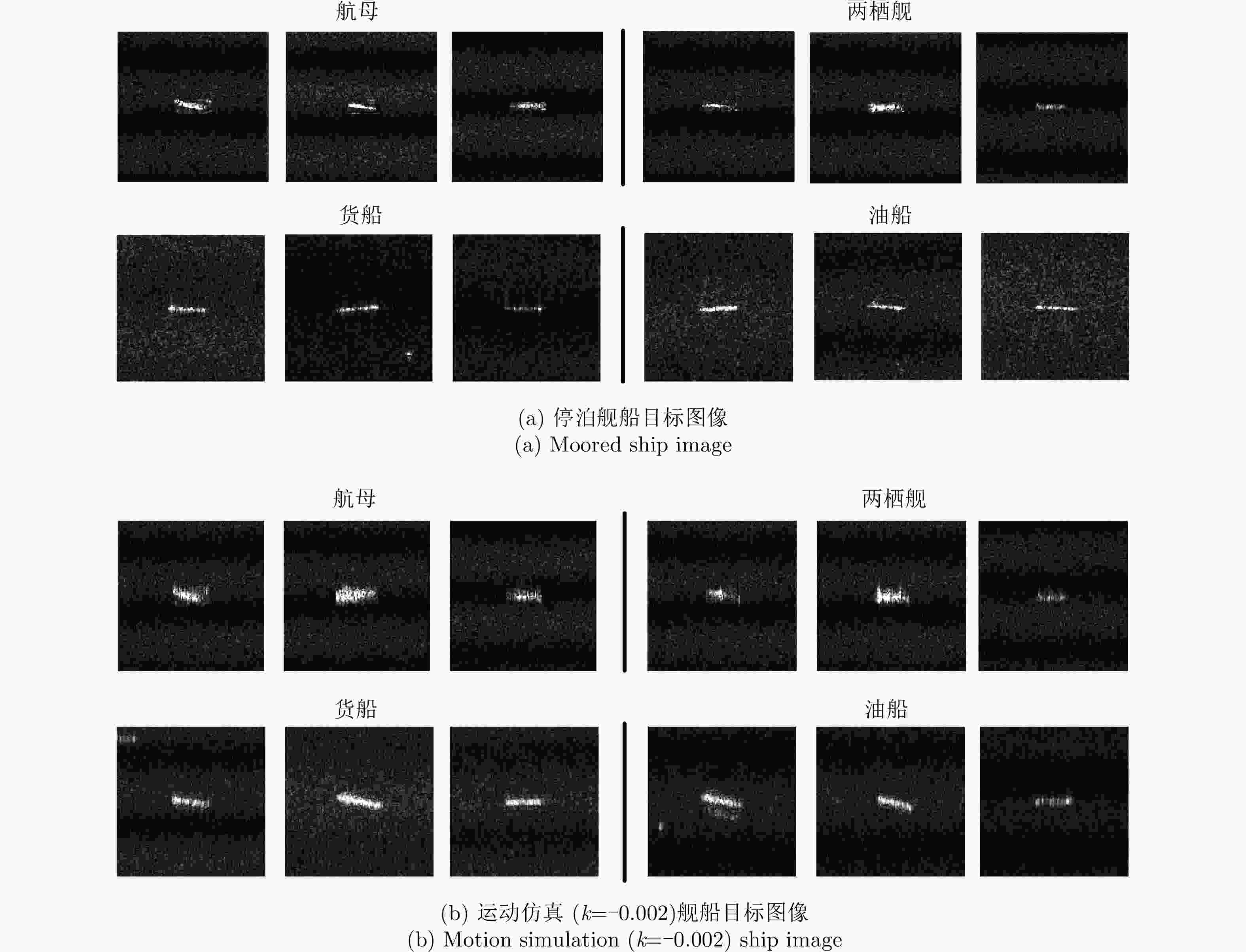

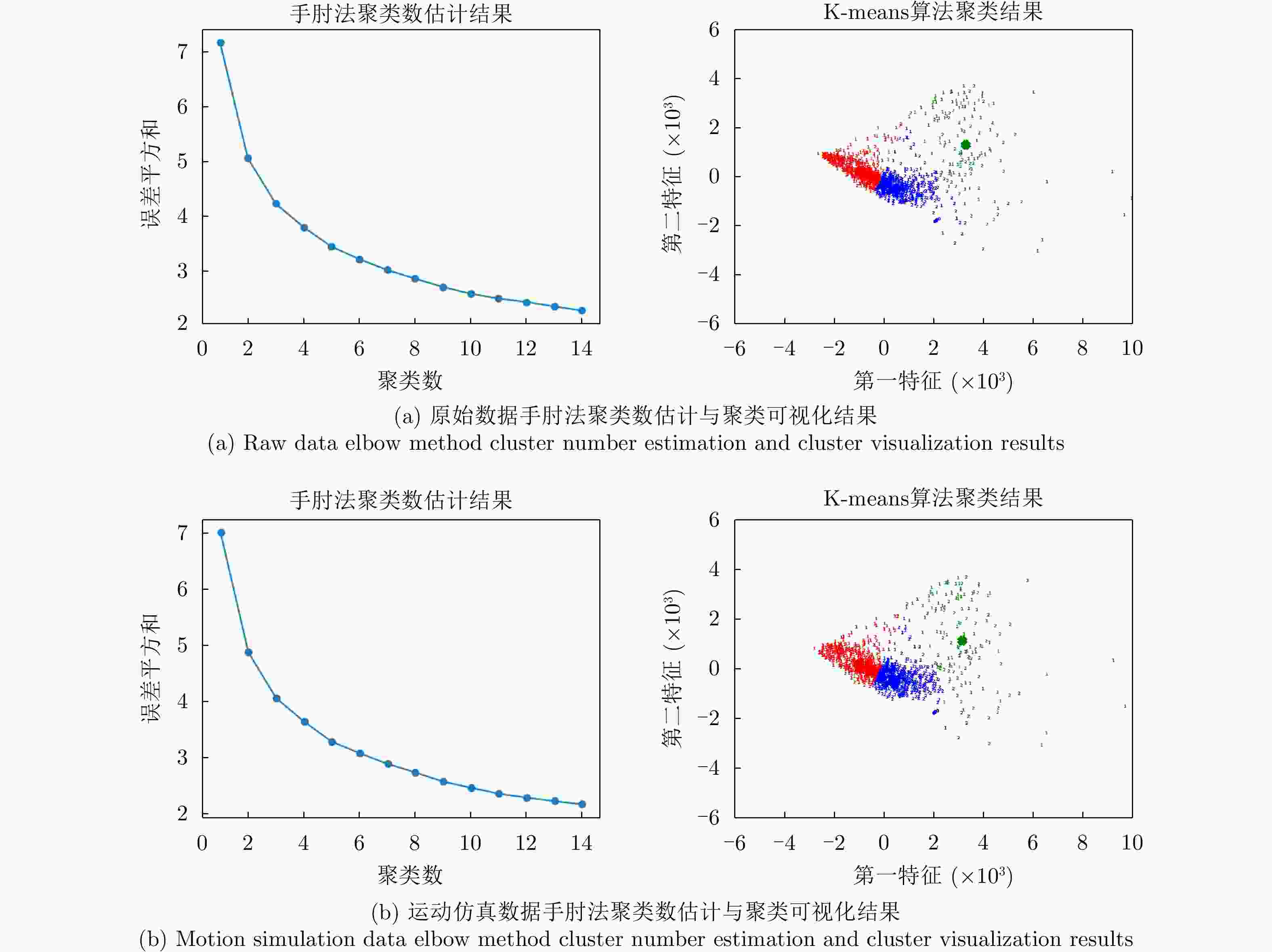

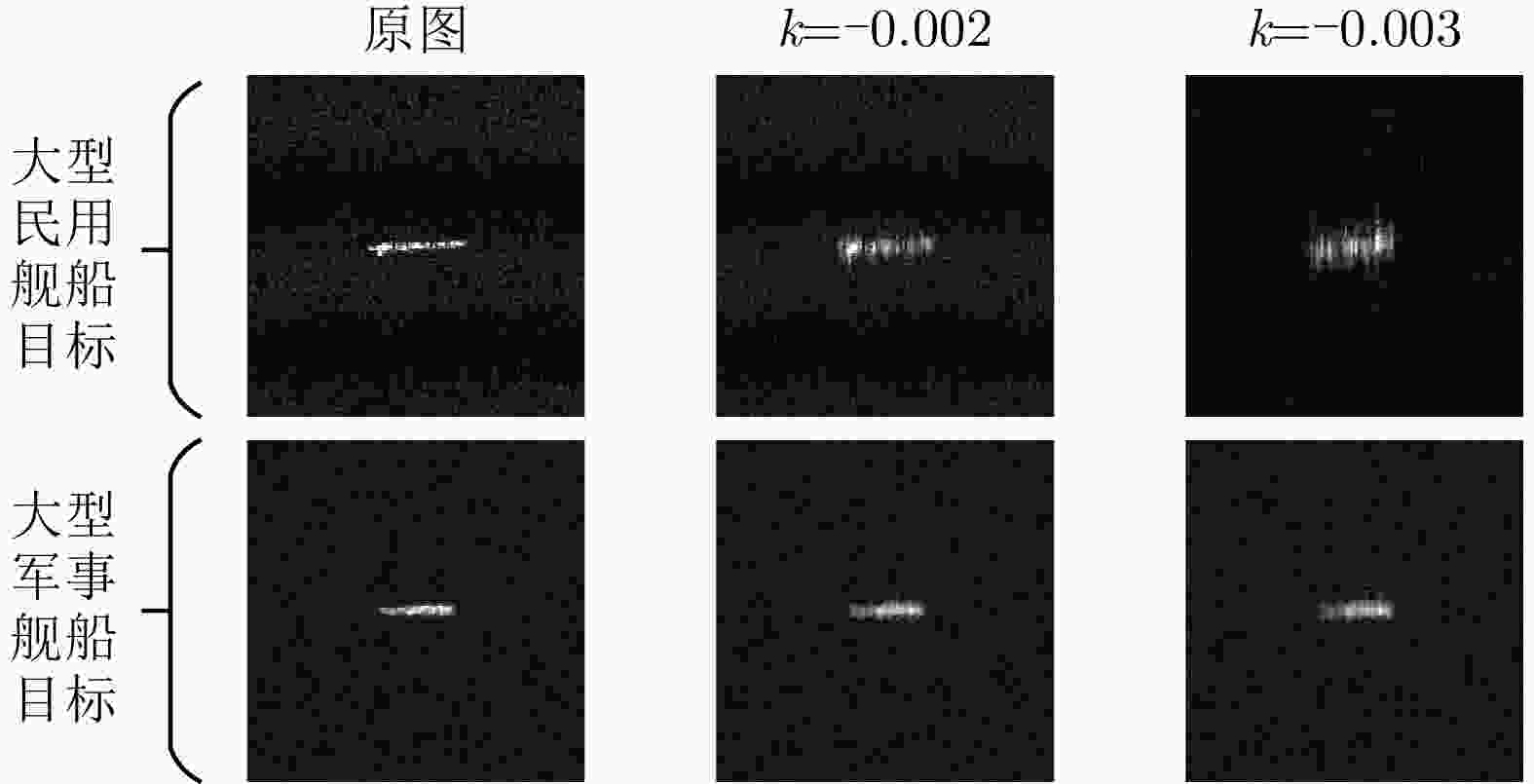

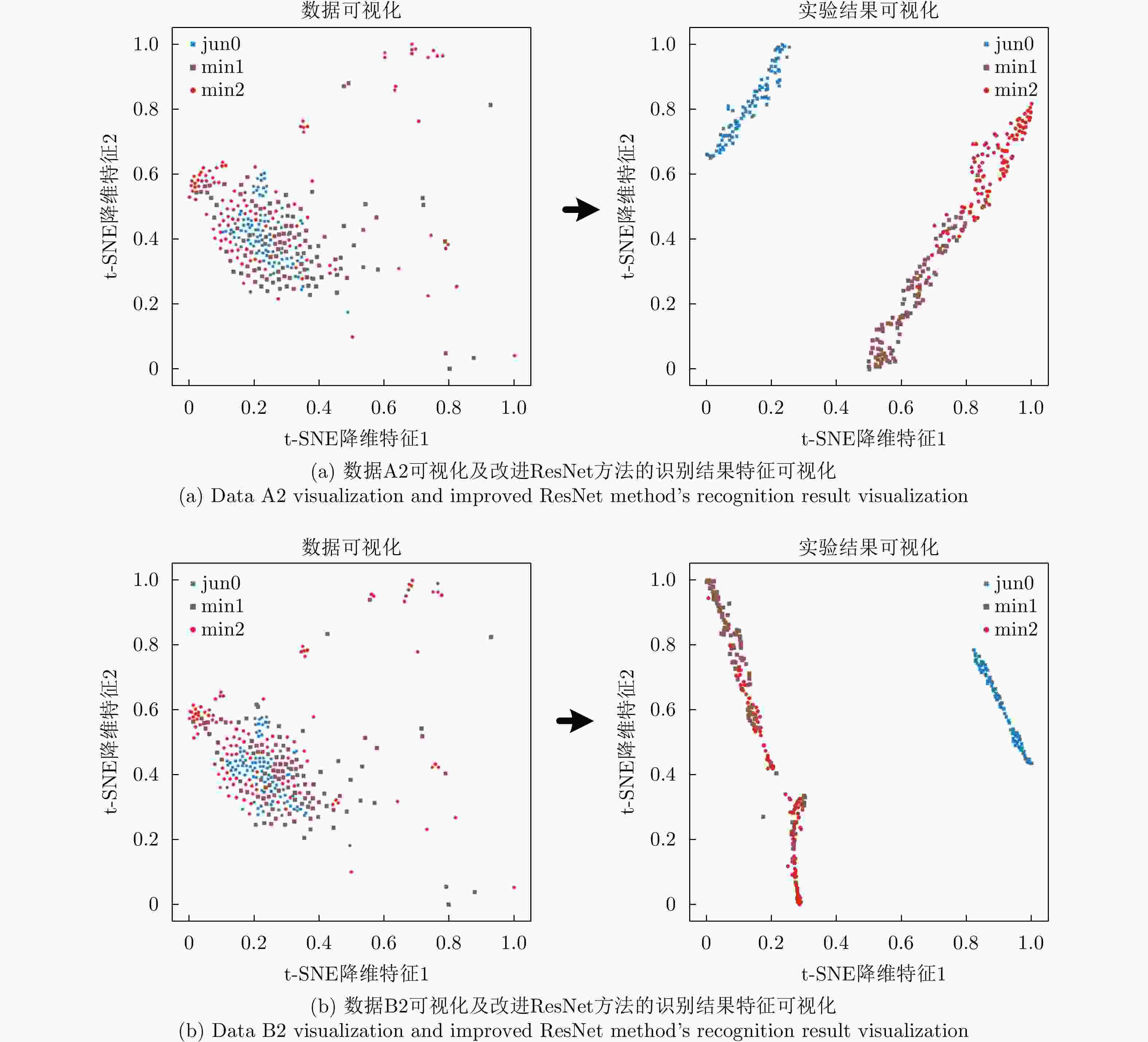

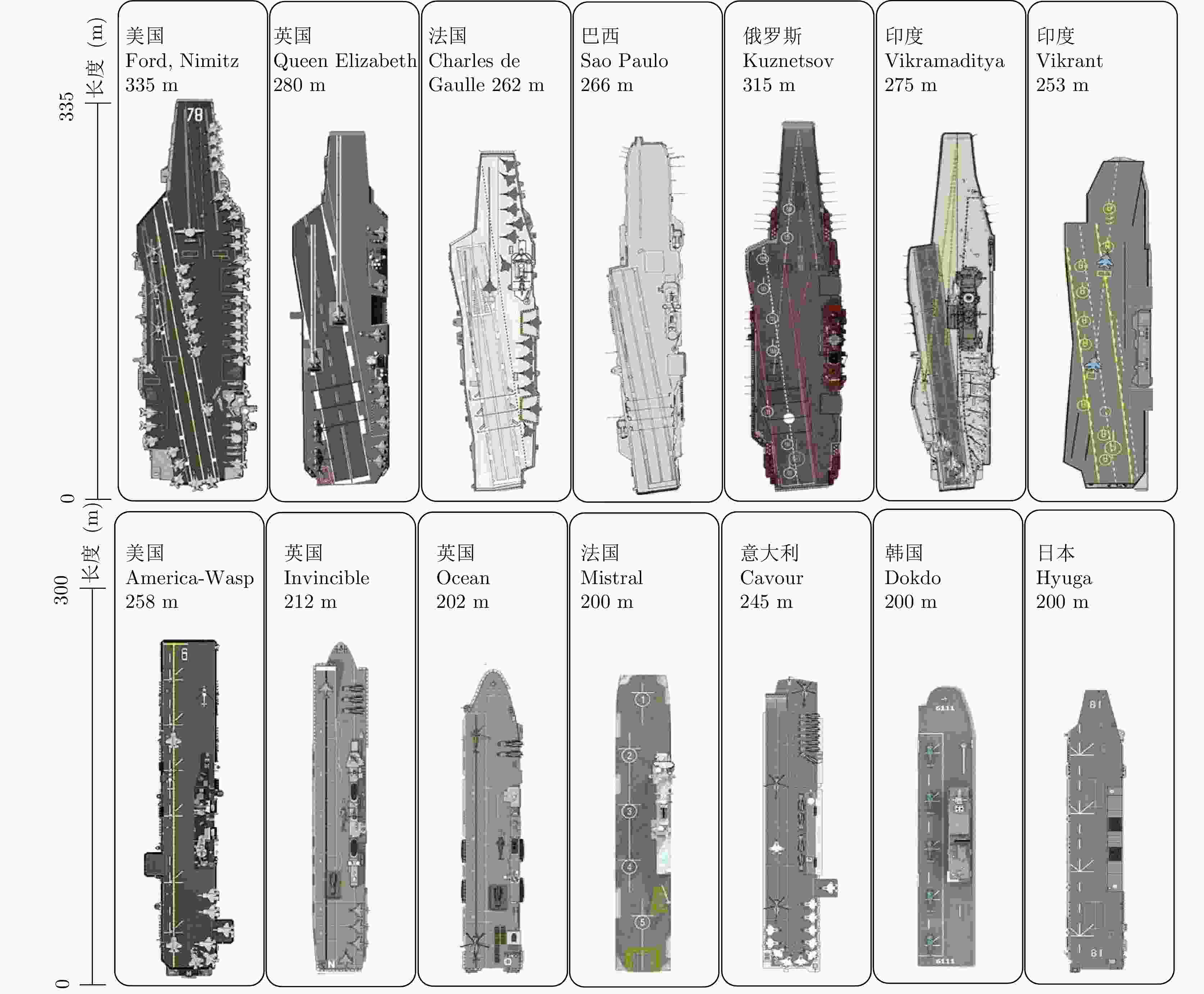

摘要: 以TopSAR和ScanSAR成像模式为代表的宽幅合成孔径雷达(SAR)可以实现更大范围的海洋场景观测。但实现宽测绘带的同时降低了成像分辨率,因此宽幅SAR图像中的舰船目标缺乏清晰的结构特征,给大范围海上舰船目标识别带来了极大的挑战。同时,由于缺乏海上运动航母、两栖舰等大型关键目标的宽幅SAR样本数据,使得海上运动大型关键舰船目标识别更加困难。针对该问题,该文构建了宽幅SAR海上大型运动舰船目标数据集,共包含2291个大型舰船目标样本,类别划分为大型军事舰船,长度为≥250 m的大型民用舰船和长度为150~250 m的大型民用舰船。其构建过程为:首先,通过先验知识辅助获取港口区域大型军事舰船目标样本;其次,利用属性信息对OpenSARShip数据集进行长度筛选获取大型民用舰船目标样本;最后,在样本的距离-多普勒域添加二次相位误差进行运动仿真来模拟海上运动舰船目标的成像结果。此外,该文使用经典识别算法和深度学习方法对构建的数据集与运动仿真处理后的数据进行了识别性能分析,结果表明在低分辨率情况下采用SAR图像复数信息可以在一定程度上提高算法的识别率;并且运动舰船目标的散焦问题对识别准确率具有较大影响。Abstract: Wide-swath Synthetic Aperture Radar (SAR), represented by TopSAR and ScanSAR acquisition modes, can observe a vast area of ocean scenes. However, achieving wide-swath reduces the quality of imaging resolution, which causes the ships captured in wide-swath SAR images to not have clear structural characteristics. This phenomenon brings a great challenge to the identification of large maritime ships. Further, the lack of wide-swath SAR sample data of large critical ships, such as moving aircraft carriers and amphibious ships, makes the identification of maritime moving ships difficult. To solve this problem, we construct a wide-swath SAR large maritime moving ships dataset, which includes 2291 samples. The dataset is divided into the following categories: large military ships, large civilian ships of lengths greater than 250 m, and large civilian ships of lengths between 150~250 m. The construction process of the dataset is as follows: first, the sample data of large military ships in the port area are obtained from prior knowledge; second, the sample data of large civilian ships are obtained via the length screening of OpenSARShip dataset with attribute information; finally, the imaging results of moving ships at sea are simulated by adding quadratic phase error in a range-Doppler domain. This study also analyzes the recognition performance of the constructed dataset and motion simulation of the processed data using classical recognition algorithms and deep learning methods. Experimental results show that using SAR image complex information at low resolution can improve the recognition rate of the algorithm to a certain extent, and the defocusing problem of the moving ship target has a considerable impact on the recognition accuracy.

-

Key words:

- Synthetic Aperture Radar (SAR) /

- Wide-swath /

- Motion simulation /

- Large ship

-

表 1 Sentinel-1图像参数

Table 1. Sentinel-1 image parameters

参数 数值 成像模式 IW 产品类型 SLC 产品级别 L1 极化方式 VV+VH/VV 轨道模式 升轨/降轨 分辨率(m) 20 幅宽(km) 250 表 2 复数信息对识别性能影响实验设置

Table 2. Experimental setup for the influence of complex information on recognition performance

组号 处理方式 是否运动仿真处理 A A1 幅度 否 A2 3通道重组 否 B B1 幅度 二次相位参数设置为$k = - 0.002$,

进行运动仿真B2 3通道重组 二次相位参数设置为$k = - 0.002$,

进行运动仿真表 3 复数信息对识别性能影响实验结果

Table 3. Experimental results of the effect of complex information on recognition performance

网络 数据 准确率(%) 数据 准确率(%) VGG16Net A1 85.19 A2 87.59 GoogLeNet A1 85.88 A2 86.13 ResNet18 A1 87.72 A2 88.35 VGG16Net B1 79.87 B2 81.77 GoogLeNet B1 84.87 B2 85.94 ResNet18 B1 86.51 B2 86.89 表 4 民船目标识别实验结果

Table 4. Experimental results of civilian ship recognition

网络 数据 准确率(%) 数据 准确率(%) 数据 准确率(%) SVM+GLGM C 66.33 D 65.66 E 64.70 VGG16Net C 69.10 D 68.51 E 67.26 GoogLeNet C 69.96 D 68.38 E 68.18 ResNet18 C 71.28 D 70.42 E 68.18 表 5 混合数据F组识别实验结果

Table 5. Mixed data F recognition experimental results

网络 准确率(%) SVM+GLGM 47.17 VGG16Net 74.43 GoogLeNet 74.36 ResNet18 77.05 改进ResNet 78.29 表 6 运动仿真对识别性能影响实验设置

Table 6. Experimental setup of the influence of motion simulation on recognition performance

组号 处理方式 A2 未处理 B2 二次相位参数设置为$k = - 0.002$,进行运动仿真 G2 二次相位参数设置为$k = - 0.003$,进行运动仿真 表 7 运动仿真对识别性能影响实验结果

Table 7. Experimental results of the influence of motion simulation on recognition performance

组号 实验方法 实验数据 jun0精确率(%) min1精确率(%) min2精确率(%) 准确率(%) 1 SVM+GLGM A2 97.96 68.81 73.39 55.13 VGG16Net A2 98.64 82.36 83.24 87.59 GoogLeNet A2 99.80 77.96 82.68 86.13 ResNet18 A2 99.60 82.98 83.80 88.35 改进ResNet A2 100 90.60 83.44 90.75 2 SVM+GLGM B2 98.98 62.39 75.23 53.37 VGG16Net B2 98.44 72.72 76.28 81.77 GoogLeNet B2 99.40 78.38 81.66 85.94 ResNet18 B2 99.60 83.80 79.36 86.89 改进ResNet B2 100 78.72 86.40 87.02 3 SVM+GLGM G2 97.96 61.47 71.56 52.75 VGG16Net G2 95.74 72.28 72.60 79.11 GoogLeNet G2 100 76.68 82.06 85.31 ResNet18 G2 99.60 77.40 83.88 85.94 改进ResNet G2 100 76.54 85.50 86.26 -

[1] 邢相薇, 计科峰, 康利鸿, 等. HRWS SAR 图像舰船目标监视技术研究综述[J]. 雷达学报, 2015, 4(1): 107–121. doi: 10.12000/JR14144XING Xiangwei, JI Kefeng, KANG Lihong, et al. Review of ship surveillance technologies based on high-resolution wide-swath synthetic aperture radar imaging[J]. Journal of Radars, 2015, 4(1): 107–121. doi: 10.12000/JR14144 [2] 李健. 星载宽幅 SAR及目标检测算法研究[D]. [博士论文], 西安电子科技大学, 2018: 15–21.LI Jian. Study on spaceborne SAR with wide swath and target detection[D]. [Ph. D. dissertation], Xidian University, 2018: 15–21. [3] RANEY R K, LUSCOMBE A P, LANGHAM E J, et al. RADARSAT (SAR imaging)[J]. Proceedings of the IEEE, 1991, 79(6): 839–849. doi: 10.1109/5.90162 [4] 匡燕, 李安, 李子扬, 等. RADARSAT卫星产品[J]. 遥感信息, 2007(2): 82–85, 27. doi: 10.3969/j.issn.1000-3177.2007.02.019KUANG Yan, LI An, LI Ziyang, et al. RADARSAT satellite overview[J]. Remote Sensing Information, 2007(2): 82–85, 27. doi: 10.3969/j.issn.1000-3177.2007.02.019 [5] 张庆君. 高分三号卫星总体设计与关键技术[J]. 测绘学报, 2017, 46(3): 269–277. doi: 10.11947/j.AGCS.2017.20170049ZHANG Qingjun. System design and key technologies of the GF-3 satellite[J]. Acta Geodaetica et Cartographica Sinica, 2017, 46(3): 269–277. doi: 10.11947/j.AGCS.2017.20170049 [6] SUN Zhongzhen, DAI Muchen, LENG Xiangguang, et al. An anchor-free detection method for ship targets in high-resolution SAR images[J]. IEEE Journal of Selected Topics in Applied Earth Observations and Remote Sensing, 2021, 14: 7799–7816. doi: 10.1109/JSTARS.2021.3099483 [7] KANKAKU Y, SUZUKI S, and OSAWA Y. ALOS-2 mission and development status[C]. 2013 IEEE International Geoscience and Remote Sensing Symposium-IGARSS, Melbourne, Australia, 2013: 2396–2399. [8] VAN WIMERSMA GREIDANUS H and SANTAMARIA S C. First analyses of Sentinel-1 images for maritime surveillance[R]. JRC92666, 2014. [9] SANTAMARIA C, ALVAREZ M, GREIDANUS H, et al. Mass processing of Sentinel-1 images for maritime surveillance[J]. Remote Sensing, 2017, 9(7): 678. doi: 10.3390/rs9070678 [10] GEUDTNER D, TORRES R, SNOEIJ P, et al. Sentinel-1 system capabilities and applications[C]. 2014 IEEE Geoscience and Remote Sensing Symposium, Quebec City, Canada, 2014: 1457–1460. [11] 王玉莹, 张志敏, 李宁, 等. 高分宽幅SAR系统下的方位多通道运动目标成像算法研究[J]. 电子与信息学报, 2020, 42(3): 541–546. doi: 10.11999/JEIT190211WANG Yuying, ZHANG Zhimin, LI Ning, et al. A moving target imaging approach for the multichannel in azimuth high resolution wide swath SAR system[J]. Journal of Electronics &Information Technology, 2020, 42(3): 541–546. doi: 10.11999/JEIT190211 [12] 潘洁, 王帅, 李道京, 等. 基于分布式压缩感知的高分宽幅SAR动目标成像技术[J]. 雷达学报, 2020, 9(1): 166–173. doi: 10.12000/JR19060PAN Jie, WANG Shuai, LI Daojing, et al. High-resolution wide-swath SAR moving target imaging technology based on distributed compressed sensing[J]. Journal of Radars, 2020, 9(1): 166–173. doi: 10.12000/JR19060 [13] 邓云凯, 禹卫东, 张衡, 等. 未来星载SAR技术发展趋势[J]. 雷达学报, 2020, 9(1): 1–33. doi: 10.12000/JR20008DENG Yunkai, YU Weidong, ZHANG Heng, et al. Forthcoming spaceborne SAR development[J]. Journal of Radars, 2020, 9(1): 1–33. doi: 10.12000/JR20008 [14] LI Jianwei, QU Changwen, and SHAO Jiaqi. Ship detection in SAR images based on an improved faster R-CNN[C]. 2017 SAR in Big Data Era: Models, Methods and Applications (BIGSARDATA), Beijing, China, 2017: 1–6. [15] WANG Yuanyuan, WANG Chao, ZHANG Hong, et al. A SAR dataset of ship detection for deep learning under complex backgrounds[J]. Remote Sensing, 2019, 11(7): 765. doi: 10.3390/rs11070765 [16] 孙显, 王智睿, 孙元睿, 等. AIR-SARShip-1.0: 高分辨率SAR舰船检测数据集[J]. 雷达学报, 2019, 8(6): 852–862. doi: 10.12000/JR19097SUN Xian, WANG Zhirui, SUN Yuanrui, et al. AIR-SARShip-1.0: High-resolution SAR ship detection dataset[J]. Journal of Radars, 2019, 8(6): 852–862. doi: 10.12000/JR19097 [17] 包萌, 张杰, 孟俊敏, 等. 高分辨率SAR船只样本集构建与特征分析[J]. 电波科学学报, 2019, 34(6): 789–797. doi: 10.13443/j.cjors.2019043008BAO Meng, ZHANG Jie, MENG Junmin, et al. Construction and feature analysis of high resolution SAR ship sample set[J]. Chinese Journal of Radio Science, 2019, 34(6): 789–797. doi: 10.13443/j.cjors.2019043008 [18] HOU Xiyue, AO Wei, SONG Qian, et al. FUSAR-ship: Building a high-resolution SAR-AIS matchup dataset of Gaofen-3 for ship detection and recognition[J]. Science China Information Sciences, 2020, 63(4): 140303. doi: 10.1007/s11432-019-2772-5 [19] HUANG Lanqing, LIU Bin, LI Boying, et al. OpenSARShip: A dataset dedicated to Sentinel-1 ship interpretation[J]. IEEE Journal of Selected Topics in Applied Earth Observations and Remote Sensing, 2018, 11(1): 195–208. doi: 10.1109/JSTARS.2017.2755672 [20] LI Boying, LIU Bin, HUANG Lanqing, et al. OpenSARShip 2.0: A large-volume dataset for deeper interpretation of ship targets in Sentinel-1 imagery[C]. 2017 SAR in Big Data Era: Models, Methods and Applications (BIGSARDATA), Beijing, China, 2017: 1–5. [21] ZÜHLKE M, FOMFERRA N, BROCKMANN C, et al. SNAP (sentinel application platform) and the ESA sentinel 3 toolbox[C]. Proceedings of Sentinel-3 for Science Workshop, Venice, Italy, 2015: 21. [22] LENG Xiangguang, JI Kefeng, ZHOU Shilin, et al. Fast shape parameter estimation of the complex generalized Gaussian distribution in SAR images[J]. IEEE Geoscience and Remote Sensing Letters, 2020, 17(11): 1933–1937. doi: 10.1109/LGRS.2019.2960095 [23] 张绪锦, 朱兆达, 邓海涛, 等. 一种适用于双通道星载SAR的动目标检测技术[J]. 电子学报, 2007, 35(9): 1794–1798. doi: 10.3321/j.issn:0372-2112.2007.09.037ZHANG Xujin, ZHU Zhaoda, DENG Haitao, et al. A moving target detection method for dual-aperture spaceborne SAR[J]. Acta Electronica Sinica, 2007, 35(9): 1794–1798. doi: 10.3321/j.issn:0372-2112.2007.09.037 [24] 闫贺, 王珏, 黄佳, 等. 基于二维速度搜索的星载SAR运动目标聚焦算法研究[J]. 电子与信息学报, 2019, 41(6): 1287–1293. doi: 10.11999/JEIT180663YAN He, WANG Jue, HUANG Jia, et al. A moving-targets detection algorithm for spaceborne SAR system based on two-dimensional velocity search method[J]. Journal of Electronics &Information Technology, 2019, 41(6): 1287–1293. doi: 10.11999/JEIT180663 [25] 张道成, 张正成. 运动目标对SAR成像的影响[J]. 舰船电子对抗, 2014, 37(1): 49–52, 67. doi: 10.3969/j.issn.1673-9167.2014.01.012ZHANG Daocheng and ZHANG Zhengcheng. Influence of moving targets on SAR imaging[J]. Shipboard Electronic Countermeasure, 2014, 37(1): 49–52, 67. doi: 10.3969/j.issn.1673-9167.2014.01.012 [26] 马琳, 潘宗序, 黄钟泠, 等. 基于子孔径与全孔径特征学习的SAR多通道虚假目标鉴别[J]. 雷达学报, 2021, 10(1): 159–172. doi: 10.12000/JR20106MA Lin, PAN Zongxu, HUANG Zhongling, et al. Multichannel false-target discrimination in SAR images based on sub-aperture and full-aperture feature learning[J]. Journal of Radars, 2021, 10(1): 159–172. doi: 10.12000/JR20106 [27] 温雪娇, 仇晓兰, 尤红建, 等. 高分辨率星载SAR起伏运动目标精细聚焦与参数估计方法[J]. 雷达学报, 2017, 6(2): 213–220. doi: 10.12000/JR17005WEN Xuejiao, QIU Xiaolan, YOU Hongjian, et al. Focusing and parameter estimation of fluctuating targets in high resolution spaceborne SAR[J]. Journal of Radars, 2017, 6(2): 213–220. doi: 10.12000/JR17005 [28] HARTIGAN J A and WONG M A. Algorithm AS 136: A k-means clustering algorithm[J]. Journal of the Royal Statistical Society. Series c (Applied Statistics) , 1979, 28(1): 100–108. doi: 10.2307/2346830 [29] THORNDIKE R L. Who belongs in the family?[J]. Psychometrika, 1953, 18(4): 267–276. doi: 10.1007/bf02289263 [30] BURGES C J C. A tutorial on support vector machines for pattern recognition[J]. Data Mining and Knowledge Discovery, 1998, 2(2): 121–167. doi: 10.1023/A:1009715923555 [31] SMOLA A J and SCHÖLKOPF B. A tutorial on support vector regression[J]. Statistics and Computing, 2004, 14(3): 199–222. doi: 10.1023/B:STCO.0000035301.49549.88 [32] SIMONYAN K and ZISSERMAN A. Very deep convolutional networks for large-scale image recognition[C]. 3rd International Conference on Learning Representations, San Diego, USA, 2014. [33] SZEGEDY C, LIU Wei, JIA Yangqing, et al. Going deeper with convolutions[C]. The 2015 IEEE Conference on Computer Vision and Pattern Recognition, Boston, USA, 2015: 1–9. [34] HE Kaiming, ZHANG Xiangyu, REN Shaoqing, et al. Deep residual learning for image recognition[C]. The 2016 IEEE Conference on Computer Vision and Pattern Recognition, Las Vegas, USA, 2016: 770–778. [35] 雷禹, 冷祥光, 周晓艳, 等. 基于改进Res Net网络的复数SAR图像舰船目标识别方法[J/OL]. 系统工程与电子技术: 1–11. http://kns.cnki.net/kcms/detail/11.2422.TN.20220225.0948.018.html, 2022.LEI Yu, LENG Xiangguang, ZHOU Xiaoyan, et al. Recognition method of ship target in complex SAR image based on improved Res Net network[J/OL]. Systems Engineering and Electronics: 1–11. http://kns.cnki.net/kcms/detail/11.2422.TN.20220225.0948.018.html, 2022. [36] VAN DER MAATEN L and HINTON G. Visualizing data using t-SNE[J]. Journal of Machine Learning Research, 2008, 9(86): 2579–2605. -

作者中心

作者中心 专家审稿

专家审稿 责编办公

责编办公 编辑办公

编辑办公

下载:

下载: