Preliminary Research on the Effectiveness of Gestalt Perceptual Principles in SAR Images

-

摘要: 合成孔径雷达(SAR)图像是当前微波视觉研究领域的重要数据源。计算机视觉以光学视觉规律为理论基础,无法有效解译SAR图像。因此,借鉴人类视觉感知规律和计算机视觉技术,并融合电磁物理规律的微波视觉成为当前微波遥感领域的一个重要研究方向。探索微波视觉的认知基础对于完善微波视觉理论体系至关重要。该文旨在探讨光学感知规律在微波视觉中的有效性,作为完善微波视觉理论的基础尝试。格式塔感知规律是一类经典的视觉理论,常用于描述人类视觉系统对外部光学世界的感知规律,是计算机视觉的认知理论基础之一。在此背景下,该文以SAR图像为研究对象,借鉴认知心理学实验的设计流程,对格式塔感知规律中的感知组合律和感知不变律在SAR图像中的有效性进行初步研究,探索微波视觉的认知基础。实验结果表明,格式塔感知规律不能够直接应用到SAR图像的算法设计中,人类视觉系统从光学世界中总结出的知识概念、视觉规律在SAR图像中表现不佳,未来需要针对SAR图像等微波图像的特点总结相应的微波视觉认知规律。

-

关键词:

- 合成孔径雷达(SAR) /

- 微波视觉 /

- 认知科学 /

- 视觉感知 /

- 格式塔感知规律

Abstract: Synthetic Aperture Radar (SAR) images are an important data source in microwave vision research; however, computer vision cannot interpret these images effectively based on optical perceptual principles. Therefore, microwave vision, which draws inspiration from human visual perception principles and combines computer vision techniques with electromagnetic physical principles, has become an important research direction in microwave remote sensing. Exploring the cognitive basis for microwave vision is crucial for improving the theoretical system of microwave vision. Therefore, as a preliminary attempt to enhance the theoretical understanding of microwave vision, this paper examines the effectiveness of optical perceptual principles for microwave vision. As a classical visual theory, Gestalt perceptual principles are commonly used for describing the perceptual principles of the human visual system for the external optical world and are a cognitive theoretical foundation of computer vision. In this context, this paper uses SAR images as the research object, focuses on the design process of cognitive psychology experiments, and preliminarily studies the effectiveness of Gestalt perceptual principles for SAR images, including the principles of perceptual grouping and perceptual invariance, exploring the cognitive basis of microwave vision. The experimental results indicate that the Gestalt perceptual principles cannot be directly applied to the algorithm design for SAR images, and the knowledge concepts and visual principles derived from the optical world using the human visual system do not perform well in SAR images. In the future, it will be necessary to summarize the corresponding visual cognitive principles based on the characteristics of microwave images, such as SAR images. -

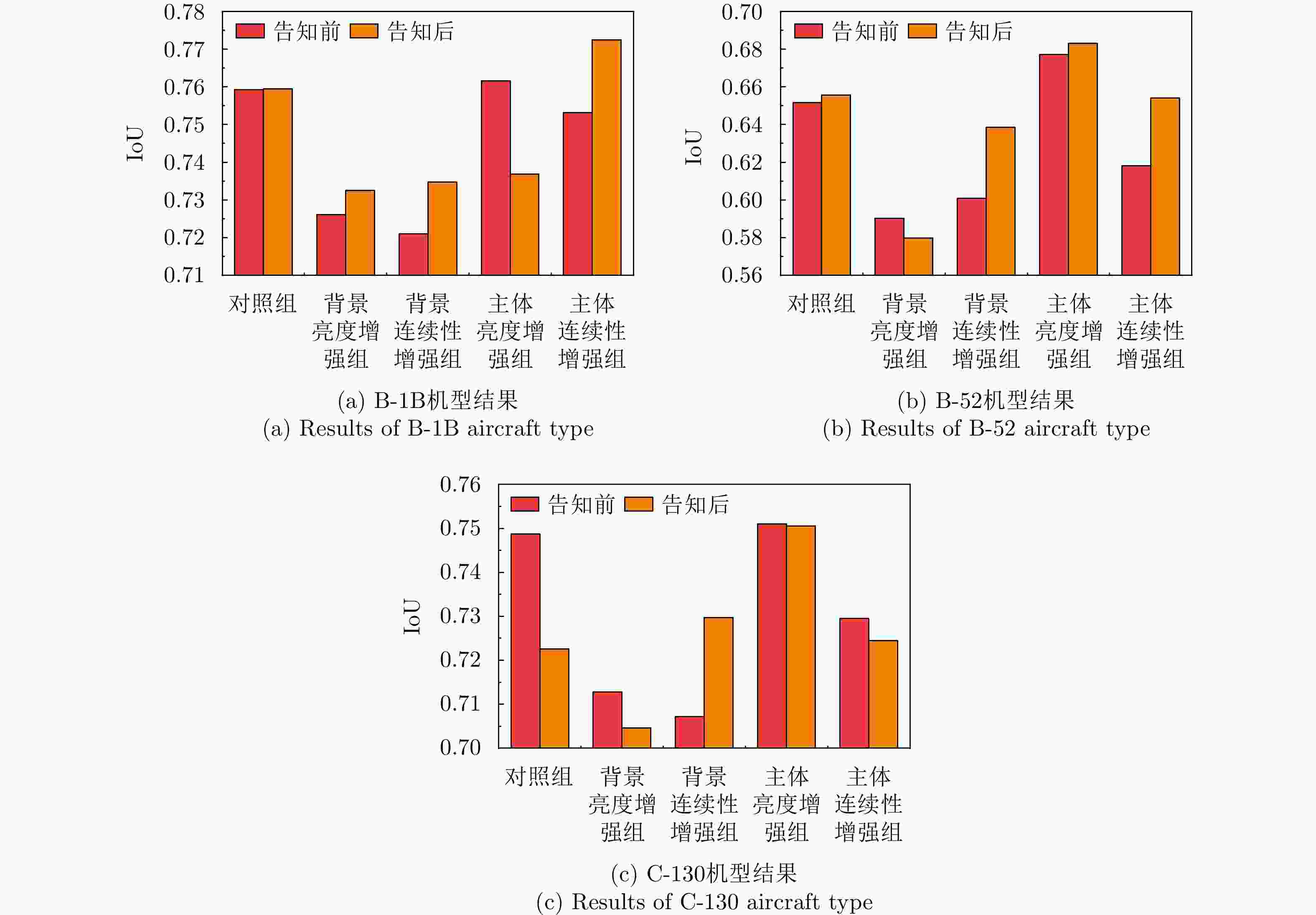

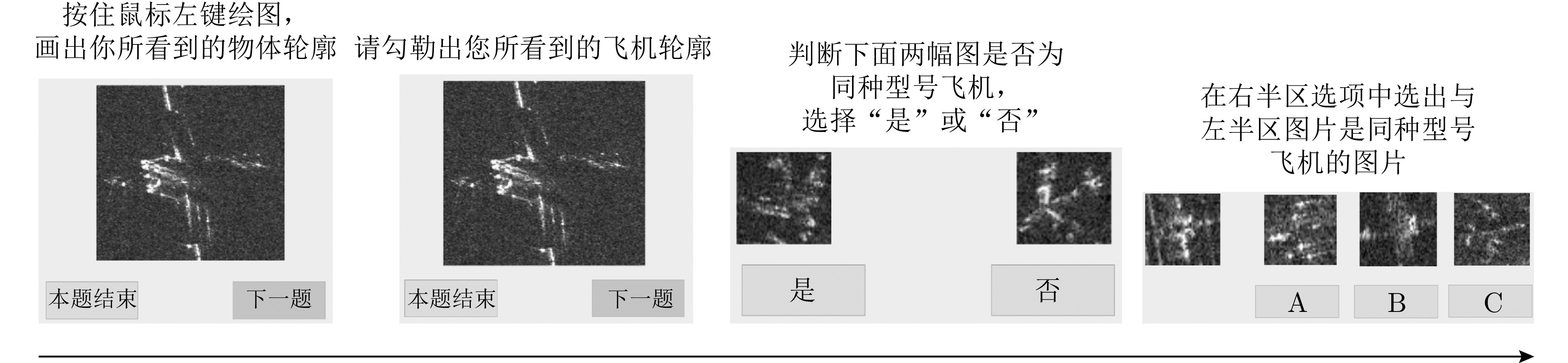

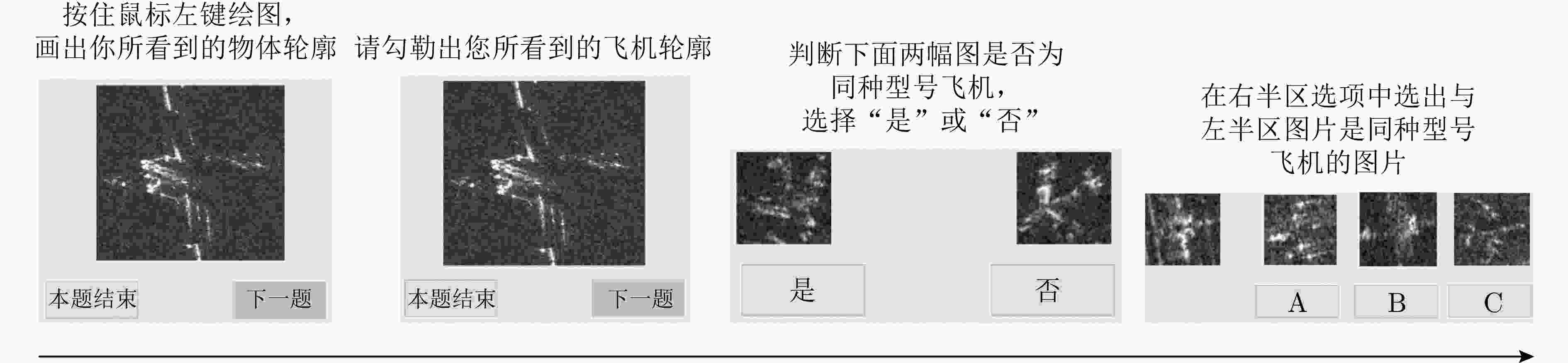

表 1 实验1题目设计及要求

Table 1. Question design and requirements in experiment 1

题型 序号 要求 画图题 A1—A3 不告知图像内容,拖动鼠标勾勒出目标轮廓 B1—B3 告知图像内容,拖动鼠标勾勒出目标轮廓 选择题 C1—C7 判断两张飞机切片图是否为相同机型飞机 D1—D8 选择与题干图片相同机型的飞机切片图 表 2 画图题被试人数

Table 2. Numbers of participants in the drawing questions

组别 人数 对照组 12 背景亮度增强组 12 背景连续性增强组 12 主体亮度增强组 11 主体连续性增强组 11 表 3 画图题有效样本数量

Table 3. Numbers of valid samples in drawing questions

组别 有效样本数 B-1B B-52 C-130 对照组 12 12 12 背景亮度增强组 11 11 11 背景连续性增强组 11 12 11 主体亮度增强组 9 11 8 主体连续性增强组 9 9 11 表 4 选择题被试人数

Table 4. Numbers of participants in the choosing questions

组别 人数 小尺度组 20 正常尺度组 19 大尺度组 19 表 5 实验1中D组选择题中各组别题干条件的设定细节

Table 5. Setting details of each stem condition in the choosing questions of experiment 1 group D

题干序号 题干条件 B-1B B-52 1 SAR×1 SAR×1 2 光学×1 光学×1 3 光学×1+SAR×1 光学×2 4 光学×1+SAR×2 光学×2+SAR×1 表 6 C组选择题答题结果

Table 6. Results of choosing questions of group C

组别 正确率 C1 C2 C3 C4 C5 C6 C7 平均 小尺度组 0.550 0.350 0.900 0.900 0.700 0.950 0.600 0.707 正常尺度组 0.578 0.317 0.744 0.894 0.728 0.944 0.739 0.706 大尺度组 0.540 0.295 0.801 0.909 0.676 1.000 0.830 0.722 平均 0.556 0.321 0.815 0.901 0.701 0.965 0.723 0.712 表 7 D组选择题答题结果

Table 7. Results of choosing questions of group D

组别 正确率 D1 D2 D3 D4 D5 D6 D7 D8 平均 小尺度组 0.625 0.800 0.750 0.600 0.450 0.500 0.500 0.750 0.622 正常尺度组 0.598 0.739 0.744 0.578 0.522 0.522 0.528 0.875 0.638 大尺度组 0.625 0.659 0.830 0.659 0.676 0.648 0.335 0.688 0.640 平均 0.616 0.733 0.775 0.612 0.549 0.557 0.454 0.771 0.633 表 8 不同题干条件下D组选择题答题结果

Table 8. Results of choosing questions of group D under different stem conditions

题干序号 正确率 D1 D2 D3 D4 D1—D4平均 D5 D6 D7 D8 D5—D8平均 1 1.000 0.250 0.633 0.733 0.654 0.306 0.292 0.367 0.917 0.471 2 0.167 0.798 1.000 0.708 0.668 0.706 0.750 0.393 0.833 0.671 3 0.817 0.875 0.487 0.741 0.730 0.792 0.357 0.521 0.417 0.522 4 0.333 0.854 1.000 0.370 0.639 0.369 0.688 0.500 0.889 0.611 平均 0.579 0.694 0.780 0.638 0.673 0.543 0.522 0.445 0.764 0.569 表 9 建模过程所涉及的数学符号及其含义

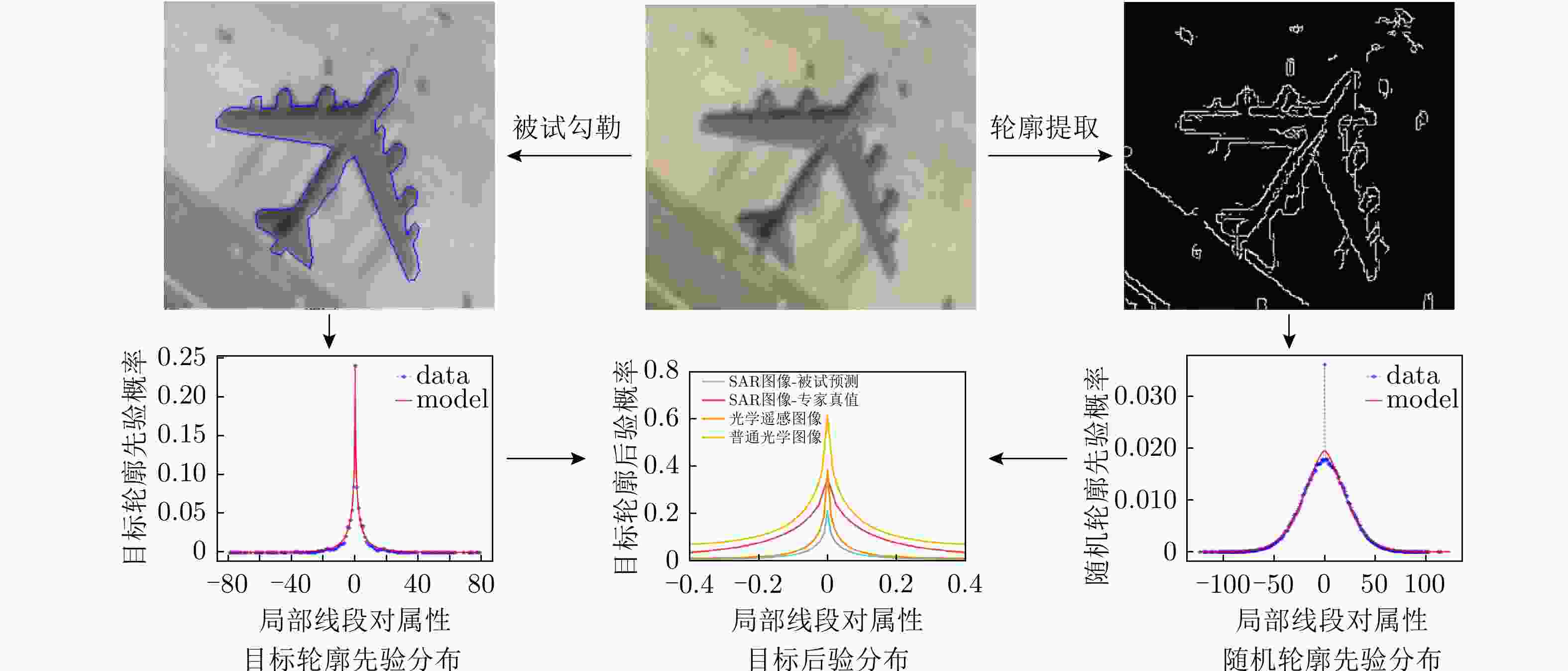

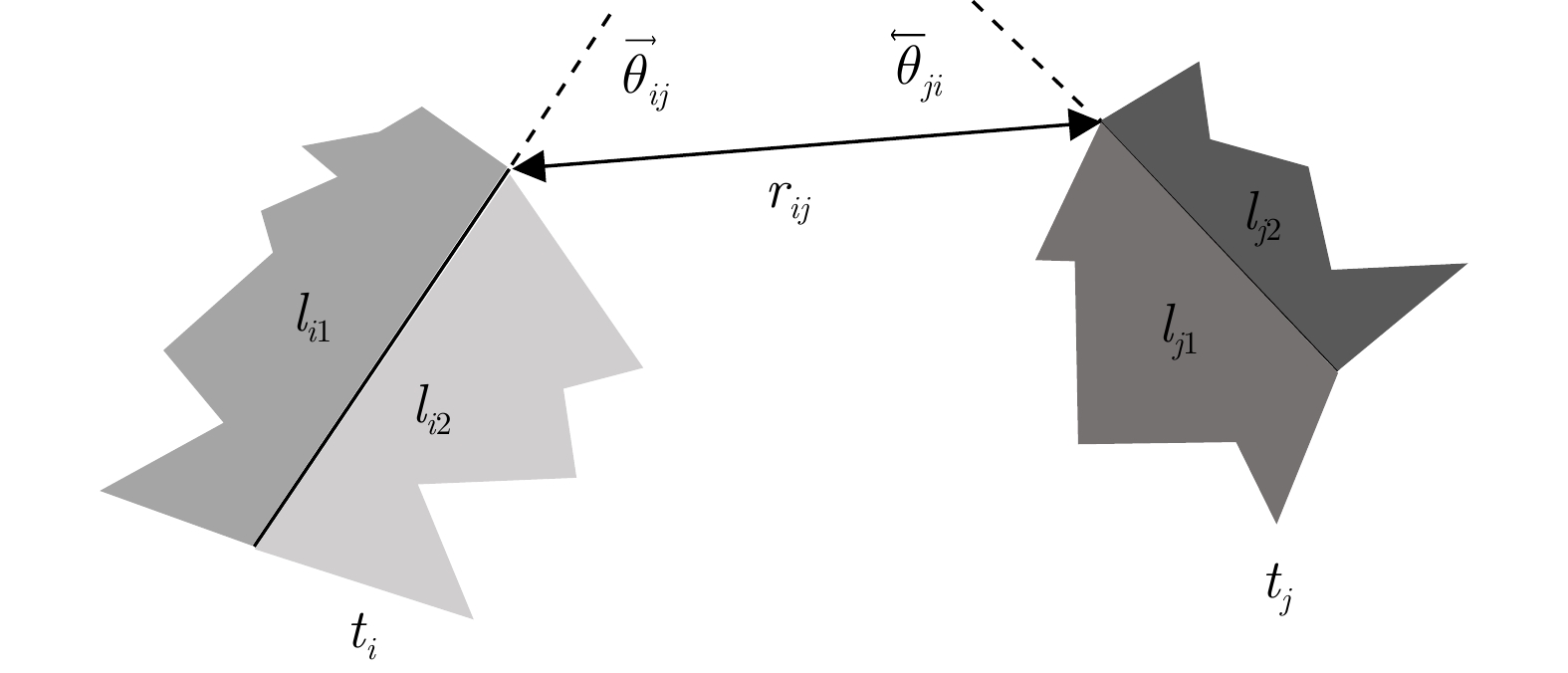

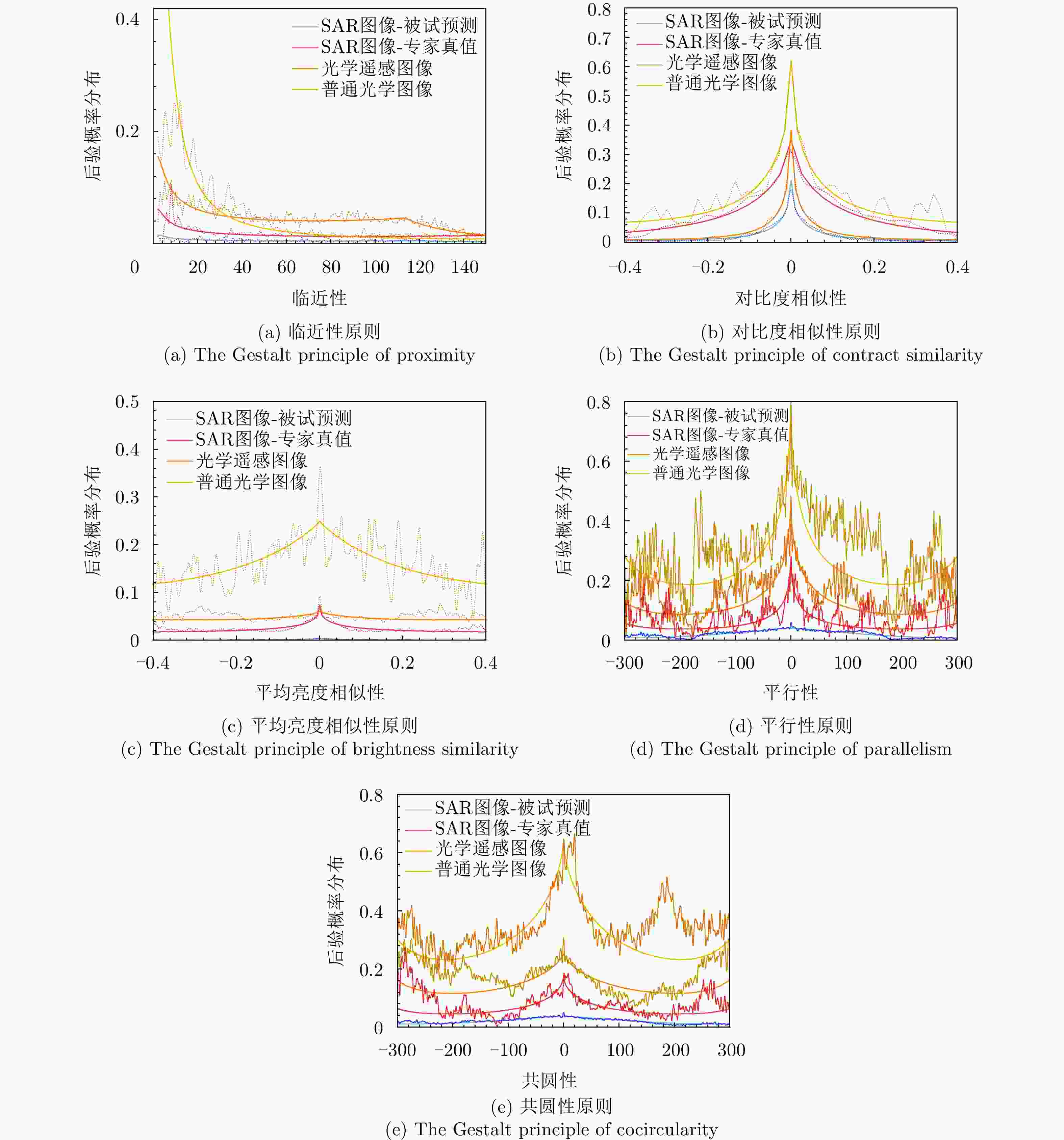

Table 9. The mathematical symbols involved in the modeling process and their meanings

符号 含义 $ {t}_{i} $ 局部线段i C 目标C $ \{{t}_{i},{t}_{j}\} $ 局部线段对$ \{i,j\} $ $ {d}_{ij}^{k} $ 局部线段对$ \{i,j\} $第k个属性上的表现 $ {d}_{ij} $ 局部线段对$ \left\{i,j\right\} $所有属性整体表现 $ {\{t}_{i},{t}_{j}\}\in C $ 局部线段对$ \{i,j\} $属于同一个目标C $ {\{t}_{i},{t}_{j}\}\notin C $ 局部线段对$ \{i,j\} $不属于同一个目标C 表 10 建模分析过程中各实验组基本信息

Table 10. Information of different treatment groups in modeling analysis

类别 图片数量 人数 SAR遥感图像(被试) 3 48 SAR遥感图像(专家) 3 1 光学遥感图像 3 3 一般光学图像 1 3 -

[1] 魏钟铨. 合成孔径雷达卫星[M]. 北京: 科学出版社, 2001.WEI Zhongquan. Synthetic Aperture Radar Satellite[M]. Beijing: Science Press, 2001. [2] 保铮, 邢孟道, 王彤. 雷达成像技术[M]. 北京: 电子工业出版社, 2005.BAO Zheng, XING Mengdao, and WANG Tong. Radar Imaging Technology[M]. Beijing: Publishing House of Electronics Industry, 2005. [3] 王磊. 深度学习框架下的极化SAR影像信息表达与分类研究[D]. [博士论文], 武汉大学, 2020.WANG Lei. Polarimetric SAR image information representation and classification based on deep learning[D]. [Ph.D. dissertation], Wuhan University, 2020. [4] 徐丰, 金亚秋. 从物理智能到微波视觉[J]. 科技导报, 2018, 36(10): 30–44. doi: 10.3981/j.issn.1000-7857.2018.10.004.XU Feng and JIN Yaqiu. From the emergence of intelligent science to the research of microwave vision[J]. Science & Technology Review, 2018, 36(10): 30–44. doi: 10.3981/j.issn.1000-7857.2018.10.004. [5] 金亚秋. 多模式遥感智能信息与目标识别: 微波视觉的物理智能[J]. 雷达学报, 2019, 8(6): 710–716. doi: 10.12000/JR19083.JIN Yaqiu. Multimode remote sensing intelligent information and target recognition: Physical intelligence of microwave vision[J]. Journal of Radars, 2019, 8(6): 710–716. doi: 10.12000/JR19083. [6] 丁赤飚, 仇晓兰, 徐丰等. 合成孔径雷达三维成像—从层析、阵列到微波视觉[J]. 雷达学报, 2019, 8(6): 693–709. doi: 10.12000/JR19090.DING Chibiao, QIU Xiaolan, XU Feng, et al. Synthetic aperture radar three-dimensional imaging—from TomoSAR and array InSAR to microwave vision[J]. Journal of Radars, 2019, 8(6): 693–709. doi: 10.12000/JR19090. [7] 金亚秋, 徐丰. 面向未来空间电磁信息技术的综合分析[J]. 中国科学基金, 2021, 35(5): 688–693. doi: 10.16262/j.cnki.1000-8217.2021.05.003.JIN Yaqiu and XU Feng. General analysis for future spatial electromagnetic information technologies[J]. Bulletin of National Natural Science Foundation of China, 2021, 35(5): 688–693. doi: 10.16262/j.cnki.1000-8217.2021.05.003. [8] CHEN Sizhe, WANG Haipeng, XU Feng, et al. Target classification using the deep convolutional networks for SAR images[J]. IEEE Transactions on Geoscience and Remote Sensing, 2016, 54(8): 4806–4817. doi: 10.1109/TGRS.2016.2551720. [9] 仇晓兰, 焦泽坤, 杨振礼, 等. 微波视觉三维SAR关键技术及实验系统初步进展[J]. 雷达学报, 2022, 11(1): 1–19. doi: 10.12000/JR22027.QIU Xiaolan, JIAO Zekun, YANG Zhenli, et al. Key technology and preliminary progress of microwave vision 3D SAR experimental system[J]. Journal of Radars, 2022, 11(1): 1–19. doi: 10.12000/JR22027. [10] COLE S and BALCETIS E. Motivated perception for self-regulation: How visual experience serves and is served by goals[J]. Advances in Experimental Social Psychology, 2021, 64: 129–186. doi: 10.1016/bs.aesp.2021.04.003. [11] 乐国安, 韩振华. 认知心理学[M]. 天津: 南开大学出版社, 2011: 36–37.LE Guoan and HAN Zhenhua. Cognitive Psychology[M]. Tianjin: Nankai University Press, 2011: 36–37. [12] WAGEMANS J, ELDER J H, KUBOVY M, et al. A century of Gestalt psychology in visual perception: I. Perceptual grouping and figure–ground organization[J]. Psychological Bulletin, 2012, 138(6): 1172–1217. doi: 10.1037/a0029333. [13] WAGEMANS J, FELDMAN J, GEPSHTEIN S, et al. A century of Gestalt psychology in visual perception: II. Conceptual and theoretical foundations[J]. Psychological Bulletin, 2012, 138(6): 1218–1252. doi: 10.1037/a0029334. [14] STERNBERG R J. Cognitive Psychology[M]. Fort Worth, USA: Harcourt Brace College Publishers, 1996. [15] MARR D. Vision: A Computational Investigation into the Human Representation and Processing of Visual Information[M]. Cambridge, USA: MIT Press, 2010. [16] CHANG D, NESBITT K V, and WILKINS K. The Gestalt principles of similarity and proximity apply to both the haptic and visual grouping of elements[C]. The Eight Australasian Conference on User Interface, Ballarat, Australia, 2007: 79–86. [17] WERTHEIMER M. Untersuchungen zur Lehre von der Gestalt[J]. Gestalt Theory, 2017, 39(1): 79–89. doi: 10.1515/gth-2017-0007. [18] ELLIS W D. A Source Book of Gestalt Psychology[M]. London, UK: Kegan Paul, Trench, Trubner & Company, 1938: 71–88. [19] KOFFKA K. Principles of Gestalt Psychology[M]. New York: Harcourt, Brace, 1935. [20] ATTNEAVE F. Some informational aspects of visual perception[J]. Psychological Review, 1954, 61(3): 183–193. doi: 10.1037/H0054663. [21] SIGMAN M, CECCHI G A, GILBERT C D, et al. On a common circle: Natural scenes and Gestalt rules[J]. Proceedings of the National Academy of Sciences, 2001, 98(4): 1935–1940. doi: 10.1073/pnas.98.4.1935. [22] BLAIS C, ARGUIN M, and MARLEAU I. Orientation invariance in visual shape perception[J]. Journal of Vision, 2009, 9(2): 14. doi: 10.1167/9.2.14. [23] BUCCELLA A. The problem of perceptual invariance[J]. Synthese, 2021, 199(5/6): 13883–13905. doi: 10.1007/s11229-021-03402-2. [24] MAN K, KAPLAN J T, DAMASIO A, et al. Sight and sound converge to form modality-invariant representations in temporoparietal cortex[J]. The Journal of Neuroscience, 2012, 32(47): 16629–16636. doi: 10.1523/JNEUROSCI.2342-12.2012. [25] ELDER J H and GOLDBERG R M. Ecological statistics of Gestalt laws for the perceptual organization of contours[J]. Journal of Vision, 2002, 2(4): 5. doi: 10.1167/2.4.5. [26] DESOLNEUX A, MOISAN L, and MOREL J M. Gestalt Theory and Computer Vision[M]. CARSETTI A. Seeing, Thinking and Knowing. Dordrecht: Springer, 2004: 71–101. doi: 10.1007/1-4020-2081-3_4. [27] QI Yonggang, SONG Yizhe, XIANG Tao, et al. Making better use of edges via perceptual grouping[C]. 2015 IEEE Conference on Computer Vision and Pattern Recognition, Boston, USA, 2015: 1856–1865. doi: 10.1109/CVPR.2015.7298795. [28] YAN Yijun, REN Jinchang, SUN Genyun, et al. Unsupervised image saliency detection with Gestalt-laws guided optimization and visual attention based refinement[J]. Pattern Recognition, 2018, 79: 65–78. doi: 10.1016/J.PATCOG.2018.02.004. [29] FANG Yuming, ZHANG Xiaoqiang, YUAN Feiniu, et al. Video saliency detection by gestalt theory[J]. Pattern Recognition, 2019, 96: 106987. doi: 10.1016/J.PATCOG.2019.106987. [30] ZHU Shanshan and YUNG N H C. Sub-scene segmentation using constraints based on Gestalt principles[J]. Journal of Visual Communication and Image Representation, 2014, 25(5): 994–1005. doi: 10.1016/j.jvcir.2014.02.017. [31] YU Hang, ZHANG Xiangrong, WANG Shuang, et al. Context-based hierarchical unequal merging for SAR image segmentation[J]. IEEE Transactions on Geoscience and Remote Sensing, 2013, 51(2): 995–1009. doi: 10.1109/TGRS.2012.2203604. [32] SOERGEL U, MICHAELSEN E, THIELE A, et al. Stereo analysis of high-resolution SAR images for building height estimation in cases of orthogonal aspect directions[J]. ISPRS Journal of Photogrammetry and Remote Sensing, 2009, 64(5): 490–500. doi: 10.1016/J.ISPRSJPRS.2008.10.007. [33] MICHAELSEN E, SOERGEL U, and THOENNESSEN U. Perceptual grouping for automatic detection of man-made structures in high-resolution SAR data[J]. Pattern Recognition Letters, 2006, 27(4): 218–225. doi: 10.1016/j.patrec.2005.08.002. [34] MICHAELSEN E, STILLA U, SOERGEL U, et al. Extraction of building polygons from SAR images: Grouping and decision-level in the GESTALT system[J]. Pattern Recognition Letters, 2010, 31(10): 1071–1076. doi: 10.1016/j.patrec.2009.10.004. [35] FAUL F, ERDFELDER E, BUCHNER A, et al. Statistical power analyses using G*Power 3.1: Tests for correlation and regression analyses[J]. Behavior Research Methods, 2009, 41(4): 1149–1160. doi: 10.3758/BRM.41.4.1149. [36] PALMER S E and BROOKS J L. Edge-region grouping in figure-ground organization and depth perception[J]. Journal of Experimental Psychology : Human Perception and Performance , 2008, 34(6): 1353–1371. doi: 10.1037/a0012729. [37] SAWYER S F. Analysis of variance: The fundamental concepts[J]. Journal of Manual & Manipulative Therapy, 2009, 17(2): 27E–38E. doi: 10.1179/jmt.2009.17.2.27E. [38] DRIVER J and BAYLIS G C. Edge-assignment and figure-ground segmentation in short-term visual matching[J]. Cognitive Psychology, 1996, 31(3): 248–306. doi: 10.1006/cogp.1996.0018. -

作者中心

作者中心 专家审稿

专家审稿 责编办公

责编办公 编辑办公

编辑办公

下载:

下载: