Change Detection in SAR CCD Based on the Likelihood Change Statistics

-

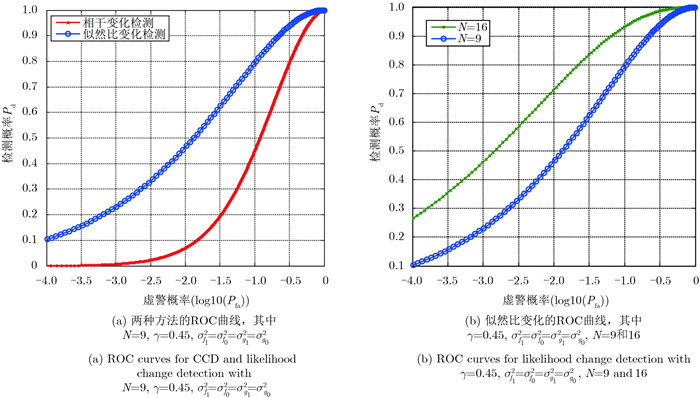

摘要: 相干变化检测利用相位差异可以检测出场景中的微小变化。该文针对相干变化检测中的两个问题:虚警高和阈值难选择,在原有似然比检测算法的基础上做了两点改进:运用最大似然估计优化似然比统计量中的参数,并采用邻域滑动窗口使得参数估计结果更加准确稳健;根据差异图像直方图提出了一种基于邻域直方图差的自动阈值选取方法。实测数据处理结果验证了算法的有效性。Abstract: The Coherent Change Detection (CCD) measures the phase difference in repeat passes in SAR images and is a powerful technique for detecting minute changes between two synthetic aperture radar images taken at different times. Nevertheless, the CCD has two problems. These are the high false-alarm rates and threshold selection. To deal with these problems using the likelihood change, this study makes two improvements. First, the model parameters are optimized by the maximum likelihood method and more accurate and robust parameters are obtained by using the sliding window in the neighborhood operations. Second, the automatic change in the threshold method is proposed based on the histogram characteristics of different data. The processing of real data suggests that the proposed method is effective in detecting minute changes.

-

表 1 LLR_CCD方法和CCD方法的性能指标

Table 1. Results of change detection by CCD and LLR_CCD

性能评估参数 LLR_CCD CCD 本文阈值选取方法 OSTU 手动最佳阈值 本文阈值选取方法 OSTU 手动最佳阈值 阈值 –104.83 72.06 –125 0.77 0.71 0.32 检测率PTP 0.7281 1 0.6641 1 0.9984 0.5703 负检率PTN 0.9965 0.3811 0.9989 0.8737 0.9134 0.9933 虚警率PFP 0.0035 0.6189 0.0011 0.1263 0.0866 0.0067 漏检率PFN 0.2719 0 0.3359 0 0.0016 0.4297 Kappa 0.7454 0.0193 0.7626 0.1811 0.2517 0.5684 -

[1] Corr D G. Coherent change detection for urban development monitoring[C]. IEE Colloquium on Radar Interferometry, 1997: 1-6. doi: 10.1049/ic:19970856. [2] Corr D G and Rodrigues A. Coherent change detection of vehicle movements[C]. 1998 IEEE International Geoscience and Remote Sensing Symposium Proceedings, Seattle, WA, 1998, 5: 2451-2453. [3] Preiss M and Stacy N J S. Coherent change detection: theoretical description and experimental results[R]. Defence Science and Technology Organisation, 2006. [4] Johnsen T. Coherent change detection in SAR images of harbors with emphasis on findings from container backscattering[C]. IEEE National Radar Conference, Kansas City, MO, 2011: 118-123. [5] Milisavljević N, Closson D, and Bloch I. Detecting potential human activities using coherent change detection[C]. International Conference on Image Processing Theory Tools and Applications (IPTA), Paris, 2010: 482-485. [6] 曾晓燕. 极化SAR图像配准与相干变化检测方法研究[D]. [硕士论文], 电子科技大学, 2010.Zeng Xiao-yan. Study of registration and coherent change detection in polarization SAR images[D]. [Master dissertation], University of Electronic Science and Technology of China, 2010. [7] 宣延艳. 极化SAR相干信息配准与变化检测算法研究[D]. [硕士论文], 电子科技大学, 2011. http://cdmd.cnki.com.cn/Article/CDMD-10614-1011191892.htmXuan Yan-yan. Coherent information registration and change detection in polarization SAR[D]. [Master dissertation], University of Electronic Science and Technology of China, 2011. http://cdmd.cnki.com.cn/Article/CDMD-10614-1011191892.htm [8] Liao M, Jiang L, Lin H, et al.. Urban change detection based on coherence and intensity characteristics of SAR imagery[J]. Photogrammetric Engineering & Remote Sensing, 2008, 74(8): 999-1006. https://www.researchgate.net/publication/273663116_Urban_Change_Detection_Based_on_Coherence_and_Intensity_Characteristics_of_SAR_Imagery [9] 杨祥立, 徐德伟, 黄平平, 等.融合相干/非相干信息的高分辨率SAR图像变化检测[J].雷达学报, 2015, 4(5): 582-590. http://radars.ie.ac.cn/CN/abstract/abstract298.shtmlYang Xiang-li, Xu De-wei, Huang Ping-ping, et al.. Change detection of high resolution SAR images by the fusion of coherent/incoherent information[J]. Journal of Radars, 2015, 4(5): 582-590. http://radars.ie.ac.cn/CN/abstract/abstract298.shtml [10] Preiss M, Gray D A, and Stacy N J S. Detecting scene changes using synthetic aperture radar interferometry[J]. IEEE Transactions on Geoscience & Remote Sensing, 2006, 44(8): 2041-2054. https://www.researchgate.net/publication/3204158_Detecting_scene_changes_using_synthetic_aperture_Radar_interferometry [11] Wright P, Macklin T, Willis C, et al.. Coherent change detection with SAR[C]. Radar Conference, Paris, 2005: 17-20. [12] Phillips R D. Clean: a false alarm reduction method for SAR CCD[C]. IEEE International Conference on Acoustics, Prague, 2011: 1365-1368. [13] Yu B and Phillips R D. Multispectral vegetation detection for improved SAR CCD[C]. IEEE Conference Record of the Forty Sixty Asilomar, Pacific Grove, CA, 2012: 1664-1668. [14] Yu B and Phillips R D. Using contextual information to improve SAR CCD: Bayesian contextual coherent change detection (BC CCD)[C]. IEEE International Geoscience & Remote Sensing Symposium (IGARSS), Quebec City, 2014: 1277-1280. [15] 谢凤英, 赵丹培. Visual C++数字图像处理[M].北京:电子工业出版社, 2008: 279-290.Xie Feng-ying and Zhao Dan-pei. Visual C++ Digital Image Processing[M]. Beijing: Publishing House of Electronics Industry, 2008: 279-290. [16] 熊博莅. SAR图像配准及变化检测技术研究[D]. [博士论文], 国防科学技术大学, 2012. http://cdmd.cnki.com.cn/Article/CDMD-90002-1013047531.htmXiong Bo-li. Study of registration and change detection in SAR images[D]. [Ph.D. dissertation], Graduate School of National University of Defense Technology, 2012. http://cdmd.cnki.com.cn/Article/CDMD-90002-1013047531.htm -

作者中心

作者中心 专家审稿

专家审稿 责编办公

责编办公 编辑办公

编辑办公

下载:

下载: