-

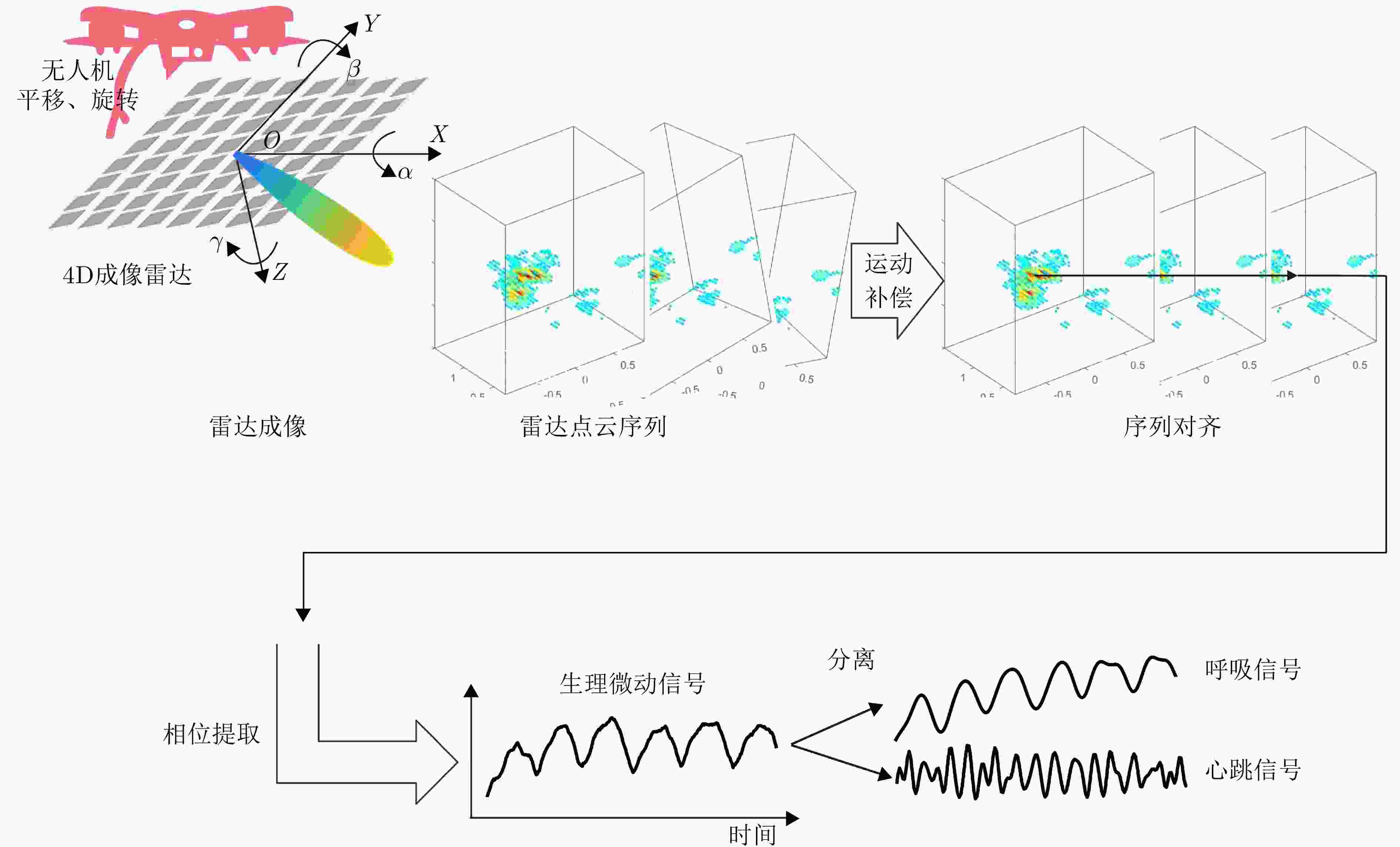

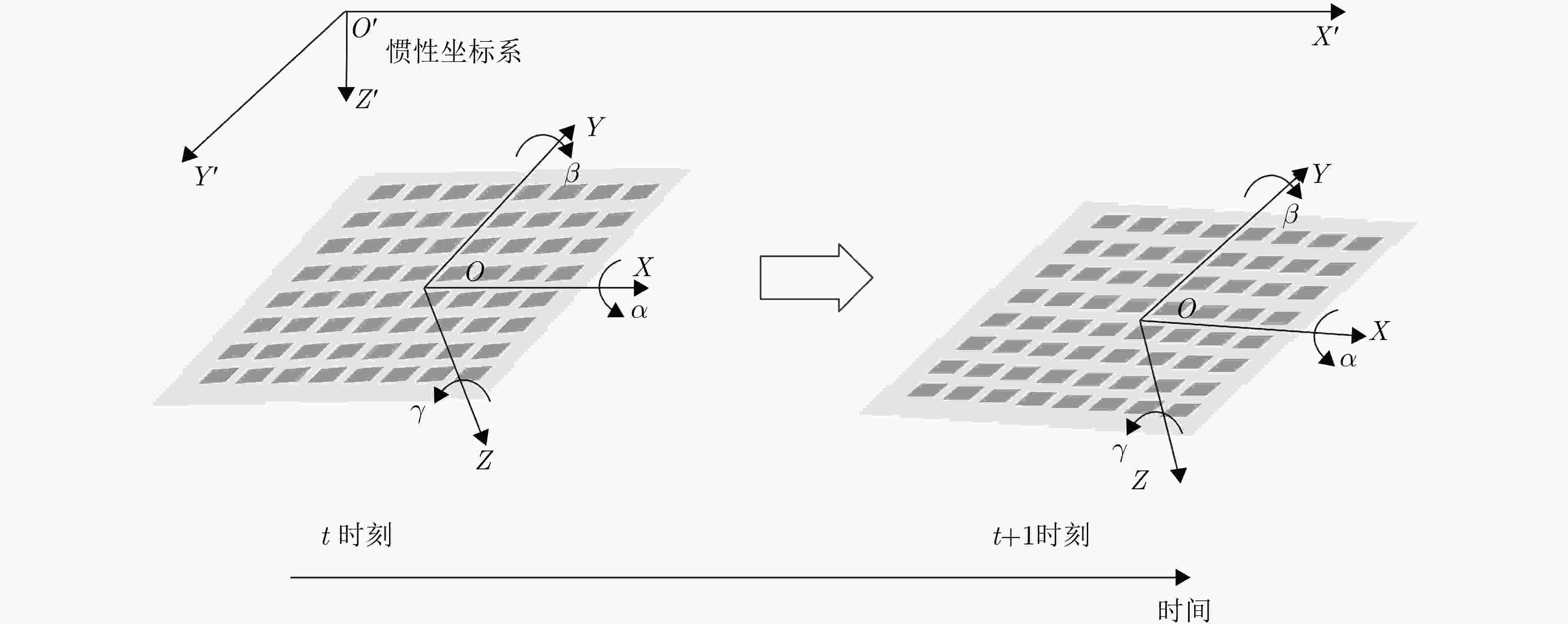

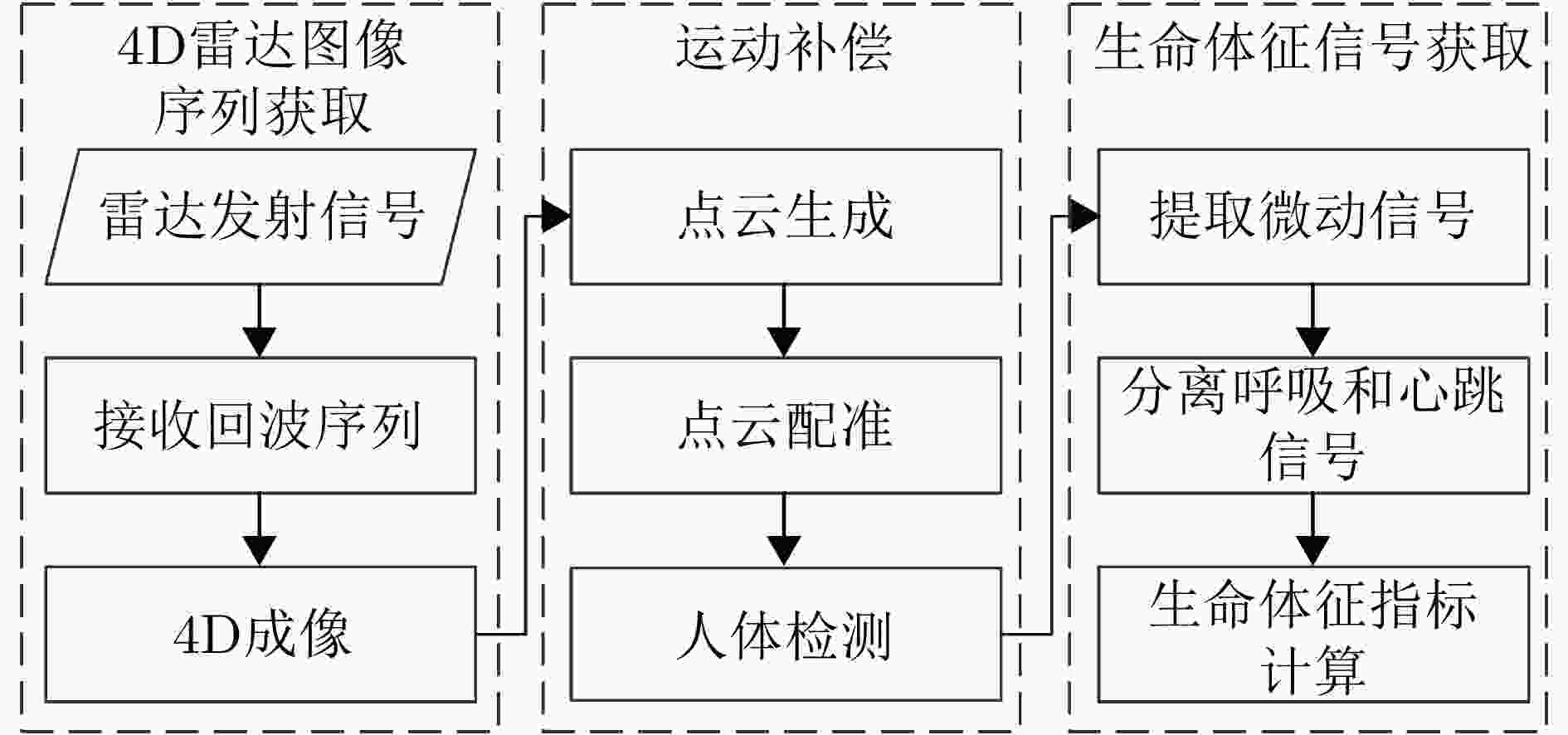

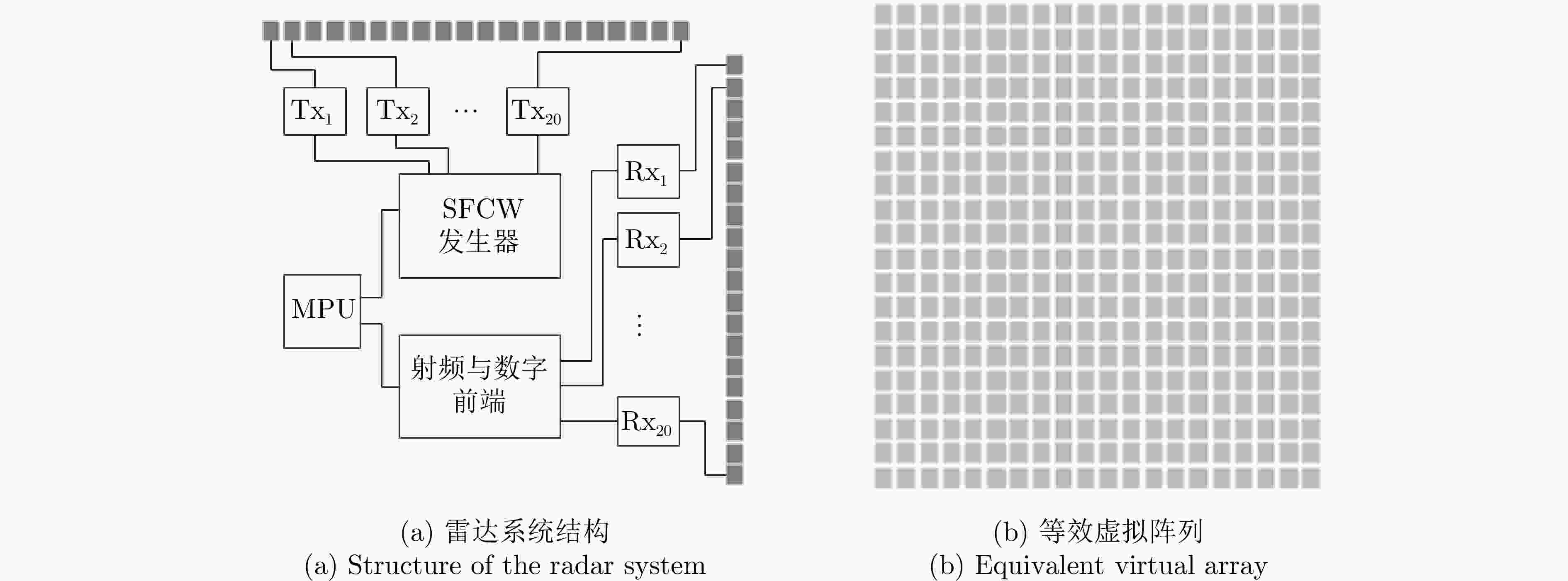

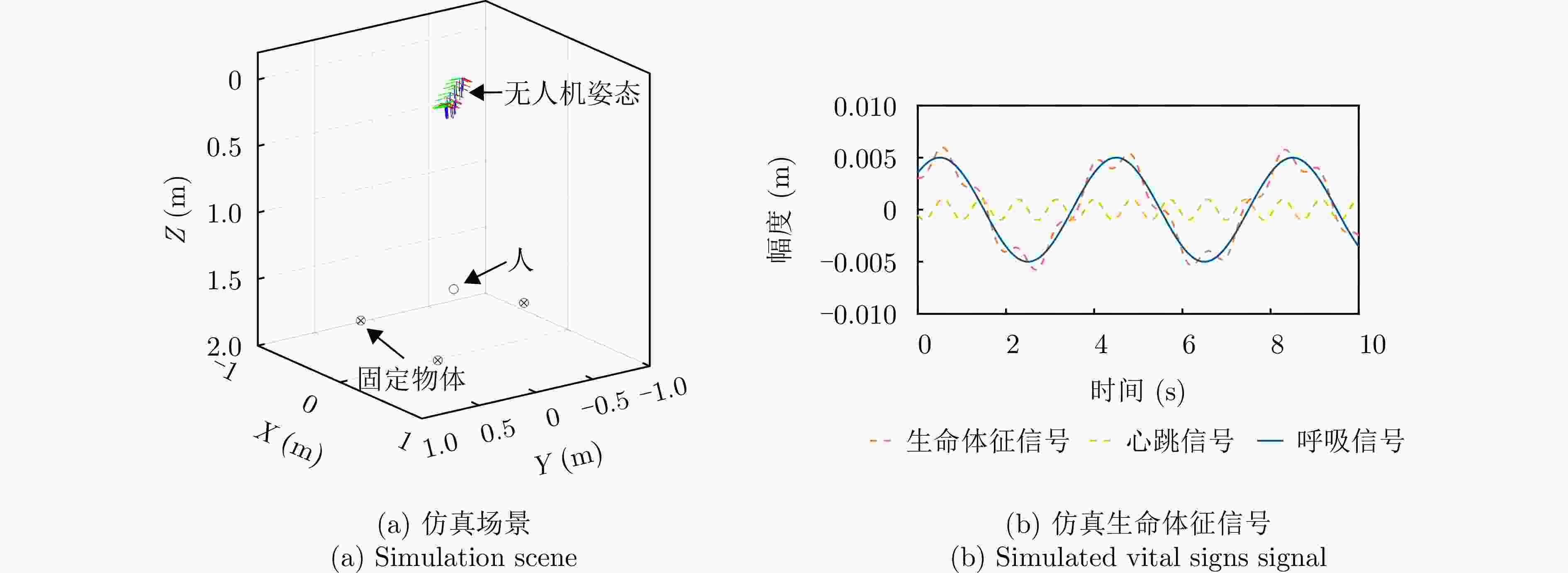

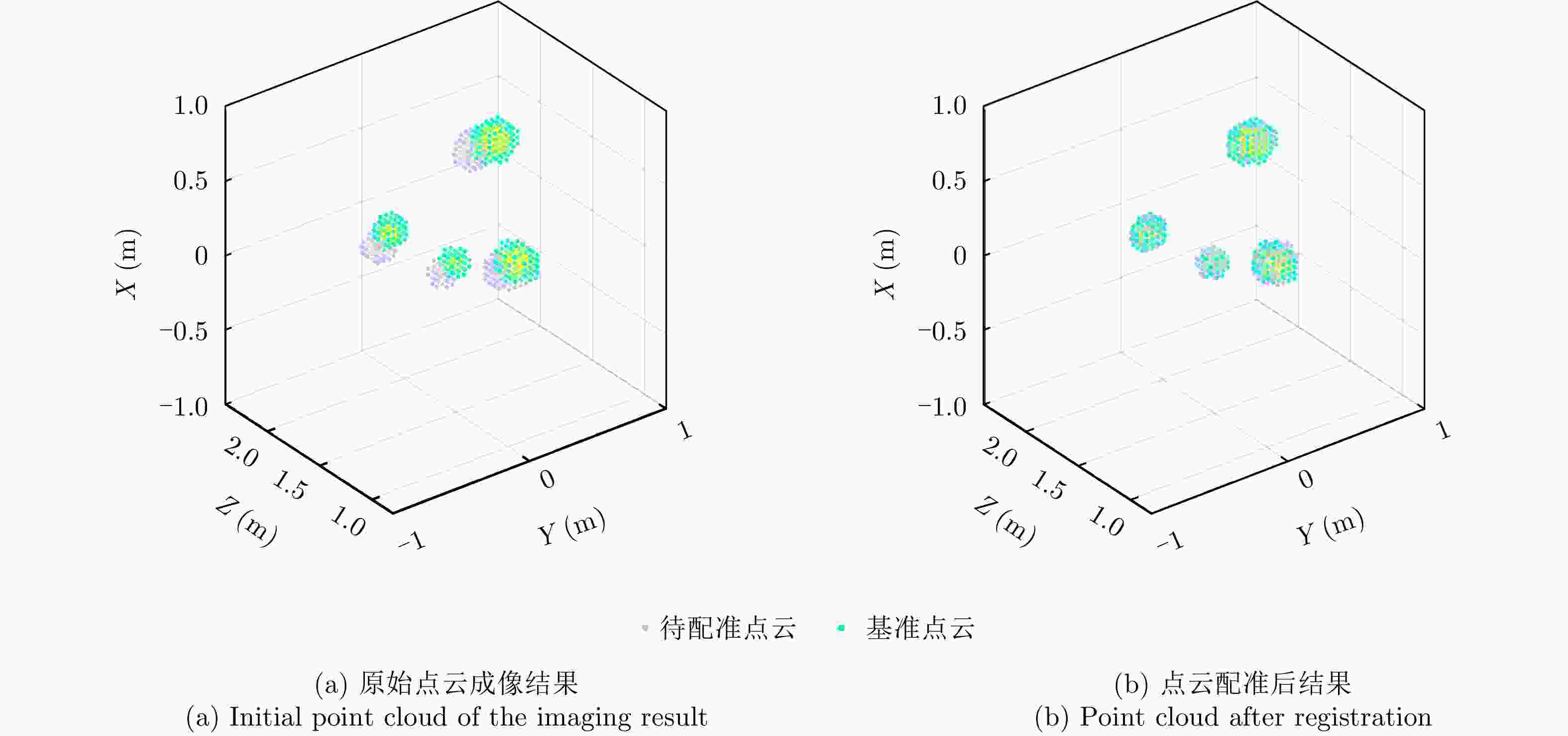

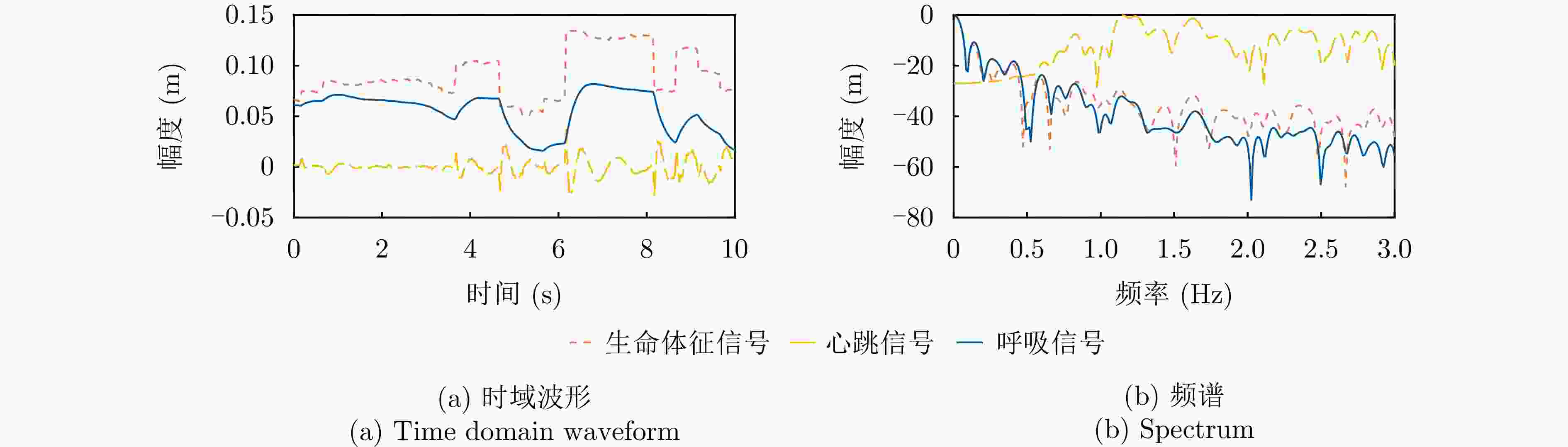

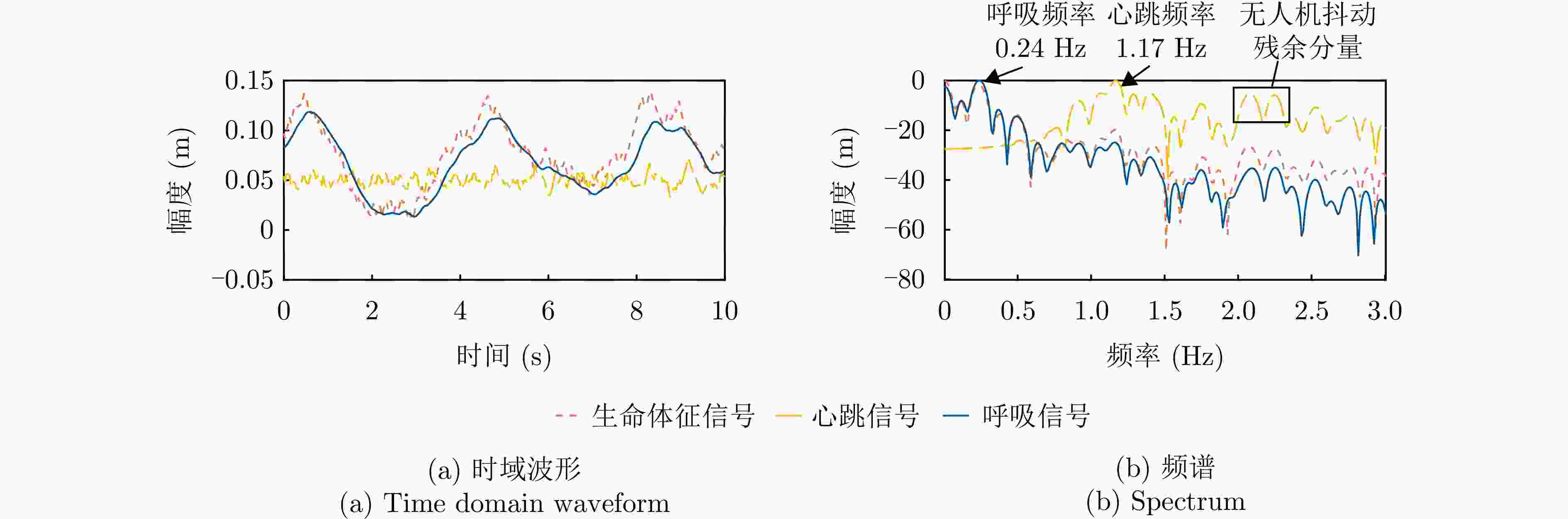

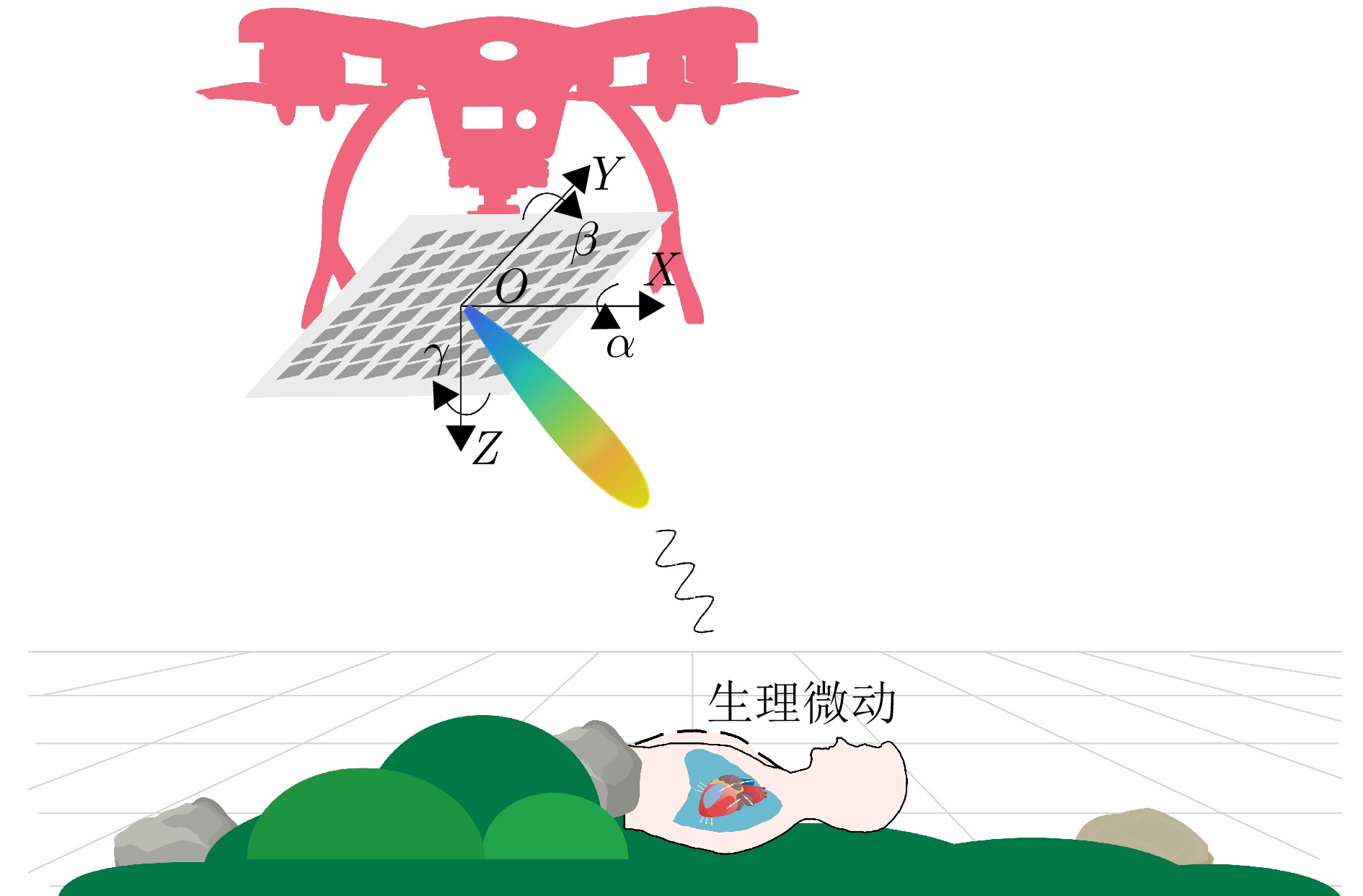

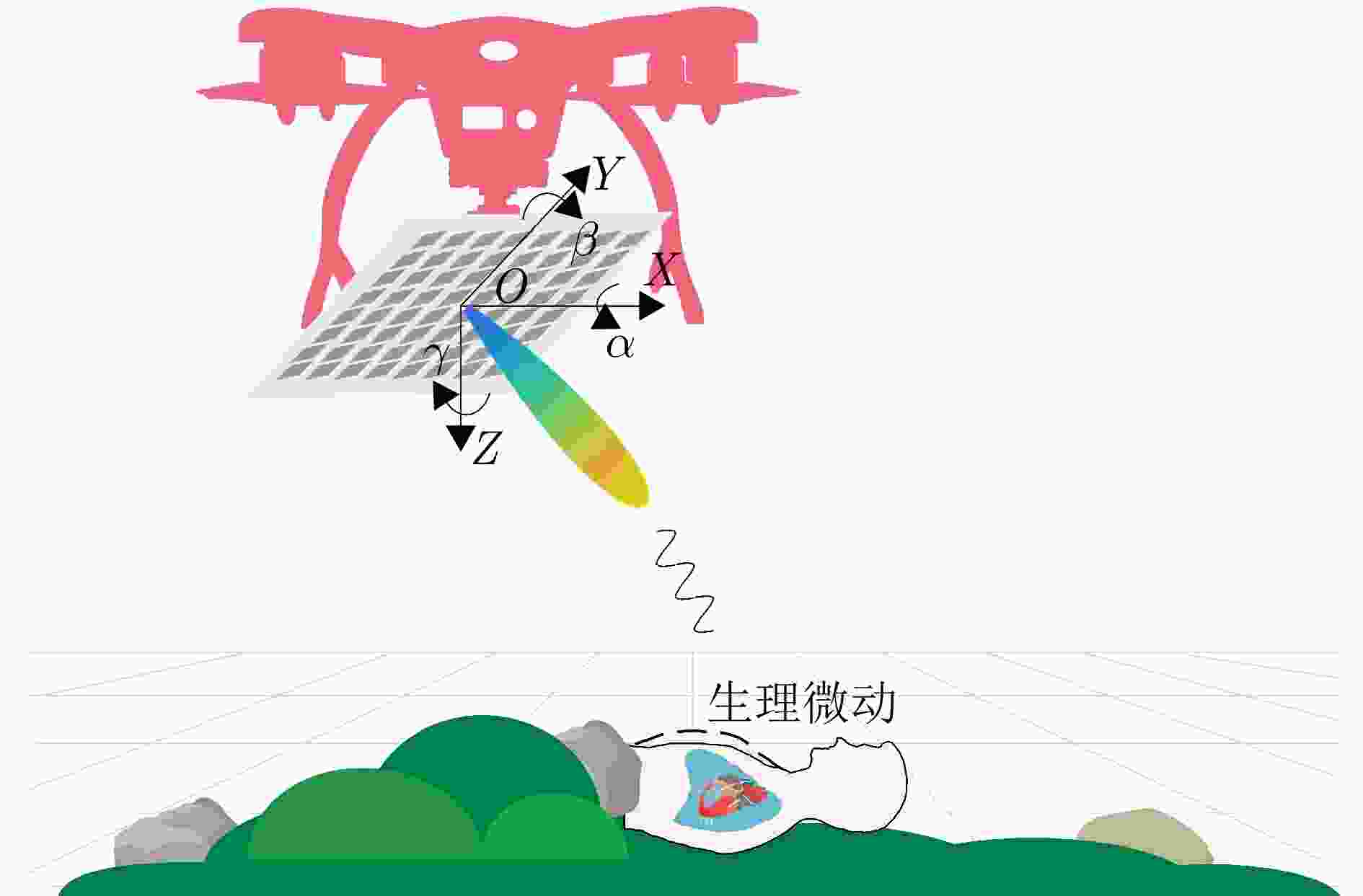

摘要: 无人机载雷达具有高机动灵活的特点,可解决传统非接触式生命体征感知中存在的探测范围小和探测场景受限等问题。该项研究工作将4D成像雷达搭载于多旋翼无人机上,提出一种基于点云配准的无人机载4D雷达生命体征感知方法。该方法通过对雷达点云进行配准和运动补偿,消除无人机在悬停状态时的运动误差干扰,进而对齐人体目标后实现生命体征信号的获取。仿真实验结果表明该方法能够对齐4D成像雷达点云序列,有效抑制无人机的运动干扰,从而准确提取人体目标的呼吸和心跳信号,为无人机载非接触式生命体征感知提供了一种新的技术途径。Abstract: Unmanned Aerial Vehicle (UAV)-borne radar technology can solve the problems associated with noncontact vital sign sensing, such as limited detection range, slow moving speed, and difficult access to certain areas. In this study, we mount a 4D imaging radar on a multirotor UAV and propose a UAV-borne radar-based method for sensing vital signs through point cloud registration. Through registration and motion compensation of the radar point cloud, the motion error interference of UAV hovering is eliminated; vital sign signals are then obtained after aligning the human target. Simulation results show that the proposed method can effectively align the 4D radar point cloud sequence and accurately extract the respiration and heartbeat signals of human targets, thereby providing a way to realize UAV-borne vital sign sensing.

-

Key words:

- Vital signs /

- 4D imaging radar /

- Unmanned Aerial Vehicle (UAV) /

- Point cloud /

- Registration

-

表 1 无人机载4D成像雷达主要参数

Table 1. Key parameters of the UAV-borne 4D radar prototype

参数 参数值 中心频率 67 GHz 信号带宽 1 GHz 发射功率 –10 dBm 帧率 30 Hz 阵元数量 20 Tx, 20 Rx 阵列尺寸 6 cm × 6 cm 表 2 六自由度估计误差统计

Table 2. Estimation error statistics of the 6DOF

指标 MEAN RMSE 垂直偏移(m) 0.0031 0.0140 水平偏移X (m) 0.0069 0.0261 水平偏移Y (m) 0.0071 0.0249 俯仰角(°) 0.0372 0.1108 偏航角(°) 0.0515 0.1932 翻滚角(°) 0.0355 0.1099 -

[1] LI Changzhi. Vital-sign monitoring on the go[J]. Nature Electronics, 2019, 2(6): 219–220. doi: 10.1038/s41928-019-0260-z. [2] RONG Yu, GUTIERREZ R, MISHRA K V, et al. Noncontact vital sign detection with UAV-borne radars: An overview of recent advances[J]. IEEE Vehicular Technology Magazine, 2021, 16(3): 118–128. doi: 10.1109/MVT.2021.3086442. [3] ISLAM S M M, OBA L, LUBECKE L, et al. Contactless vital sign monitoring with unmanned aerial vehicle-borne radar[J]. IEEE Potentials, 2023, 42(1): 27–34. doi: 10.1109/MPOT.2021.3138726. [4] STOCKEL P, WALLRATH P, HERSCHEL R, et al. Motion compensation in six degrees of freedom for a MIMO radar mounted on a hovering UAV[J]. IEEE Transactions on Aerospace and Electronic Systems, 2023, 59(5): 5791–5801. doi: 10.1109/TAES.2023.3266181. [5] 李悦丽, 李泽森, 王建, 等. 多旋翼无人机载SAR的视线运动误差修正与补偿[J]. 雷达学报, 2022, 11(6): 1061–1080. doi: 10.12000/JR22082.LI Yueli, LI Zesen, WANG Jian, et al. Modification and compensation of the line-of-sight motion error for multirotor UAV SAR[J]. Journal of Radars, 2022, 11(6): 1061–1080. doi: 10.12000/JR22082. [6] CHEN Jianlai, XING Mengdao, YU Hanwen, et al. Motion compensation/autofocus in airborne synthetic aperture radar: A review[J]. IEEE Geoscience and Remote Sensing Magazine, 2022, 10(1): 185–206. doi: 10.1109/MGRS.2021.3113982. [7] NAKATA R H, HARUNA B, YAMAGUCHI T, et al. Motion compensation for an unmanned aerial vehicle remote radar life sensor[J]. IEEE Journal on Emerging and Selected Topics in Circuits and Systems, 2018, 8(2): 329–337. doi: 10.1109/JETCAS.2018.2821624. [8] ISLAM S M M, LUBECKE L C, GRADO C, et al. An adaptive filter technique for platform motion compensation in unmanned aerial vehicle based remote life sensing radar[C]. 2020 50th European Microwave Conference (EuMC), Utrecht, Netherlands, 2021: 937–940. doi: 10.23919/EuMC48046.2021.9338011. [9] RONG Yu, HERSCHFELT A, HOLTOM J, et al. Cardiac and respiratory sensing from a hovering UAV radar platform[C]. 2021 IEEE Statistical Signal Processing Workshop (SSP), Rio de Janeiro, Brazil, 2021: 541–545. doi: 10.1109/SSP49050.2021.9513771. [10] JING Yu, QI Fugui, YANG Fang, et al. Respiration detection of ground injured human target using UWB radar mounted on a hovering UAV[J]. Drones, 2022, 6(9): 235. doi: 10.3390/drones6090235. [11] MA Junqi, CHANG Zhaoxin, ZHANG Fusang, et al. Mobi2Sense: Enabling wireless sensing under device motions[C]. The 28th Annual International Conference on Mobile Computing and Networking, Sydney, Australia, 2022: 766–768. doi: 10.1145/3495243.3558748. [12] ZHANG Binbin, ZHANG Dongheng, SONG Ruiyuan, et al. RF-search: Searching unconscious victim in smoke scenes with RF-enabled drone[C]. The 29th Annual International Conference on Mobile Computing and Networking, Madrid, Spain, 2023: 91. doi: 10.1145/3570361.3613305. [13] LI Zhi, JIN Tian, HU Xikun, et al. Remote respiratory and cardiac motion patterns separation with 4D imaging radars[J]. IEEE Journal of Biomedical and Health Informatics, 2023, 27(6): 2717–2728. doi: 10.1109/JBHI.2022.3171554. [14] LI Zhi, JIN Tian, LI Lianlin, et al. Spatiotemporal processing for remote sensing of trapped victims using 4-D imaging radar[J]. IEEE Transactions on Geoscience and Remote Sensing, 2023, 61: 5103412. doi: 10.1109/TGRS.2023.3266039. [15] TOSTI F, GENNARELLI G, LANTINI L, et al. The use of GPR and microwave tomography for the assessment of the internal structure of hollow trees[J]. IEEE Transactions on Geoscience and Remote Sensing, 2022, 60: 2002314. doi: 10.1109/TGRS.2021.3115408. [16] DOERRY A W, BISHOP E E, and MILLER J A. Basics of backprojection algorithm for processing synthetic aperture radar images[R]. SAND2016-1682, 2016: 19–50. [17] LI Zhi, JIN Tian, DAI Yongpeng, et al. Through-wall multi-subject localization and vital signs monitoring using UWB MIMO imaging radar[J]. Remote Sensing, 2021, 13(15): 2905. doi: 10.3390/rs13152905. [18] WANG Jingyu, WANG Xiang, CHEN Lei, et al. Noncontact distance and amplitude-independent vibration measurement based on an extended DACM algorithm[J]. IEEE Transactions on Instrumentation and Measurement, 2014, 63(1): 145–153. doi: 10.1109/TIM.2013.2277530. [19] RAMACHANDRAN G and SINGH M. Three-dimensional reconstruction of cardiac displacement patterns on the chest wall during the P, QRS and T-segments of the ECG by laser speckle inteferometry[J]. Medical and Biological Engineering and Computing, 1989, 27(5): 525–530. doi: 10.1007/BF02441473. [20] ZHANG Juyong, YAO Yuxin, and DENG Bailin. Fast and robust iterative closest point[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2022, 44(7): 3450–3466. doi: 10.1109/TPAMI.2021.3054619. -

作者中心

作者中心 专家审稿

专家审稿 责编办公

责编办公 编辑办公

编辑办公

下载:

下载: