-

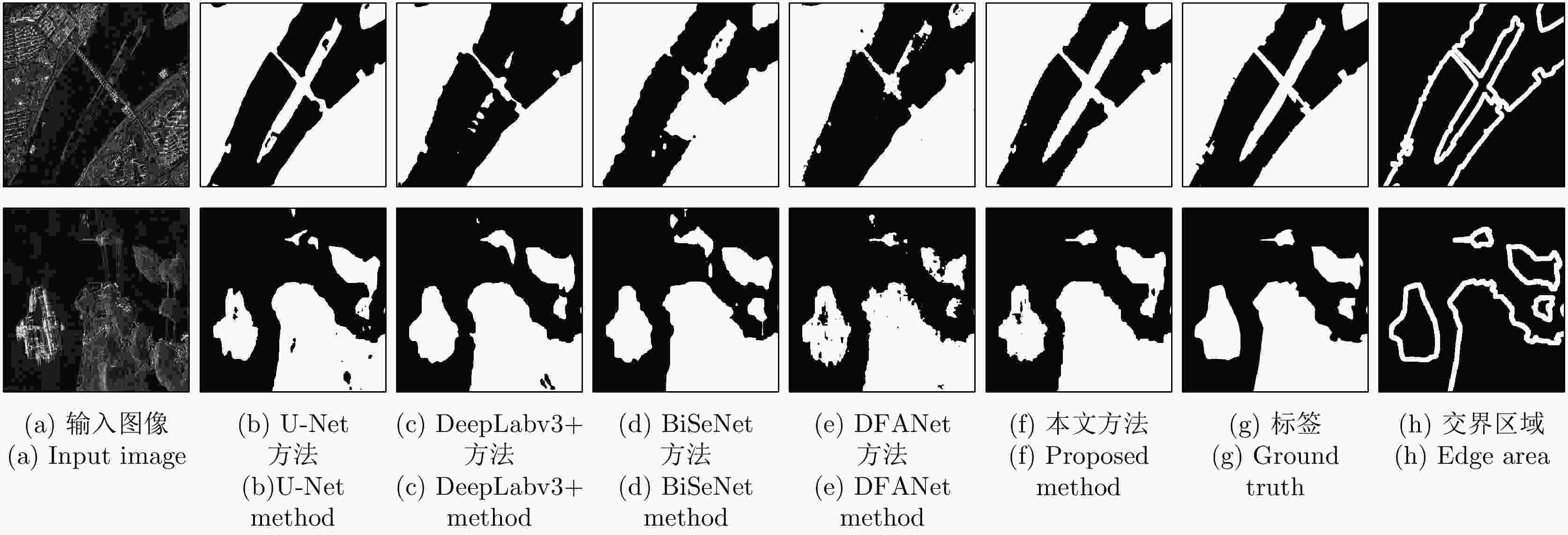

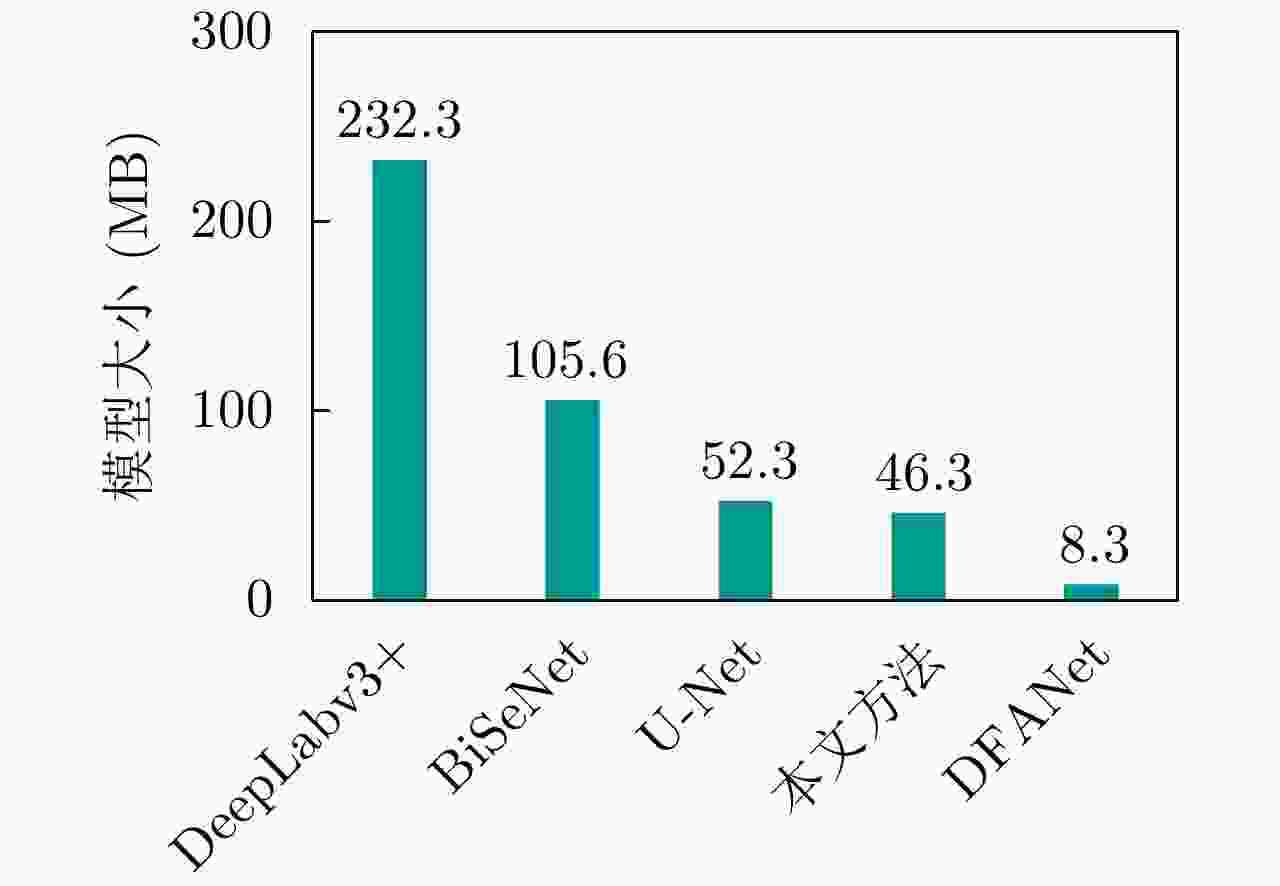

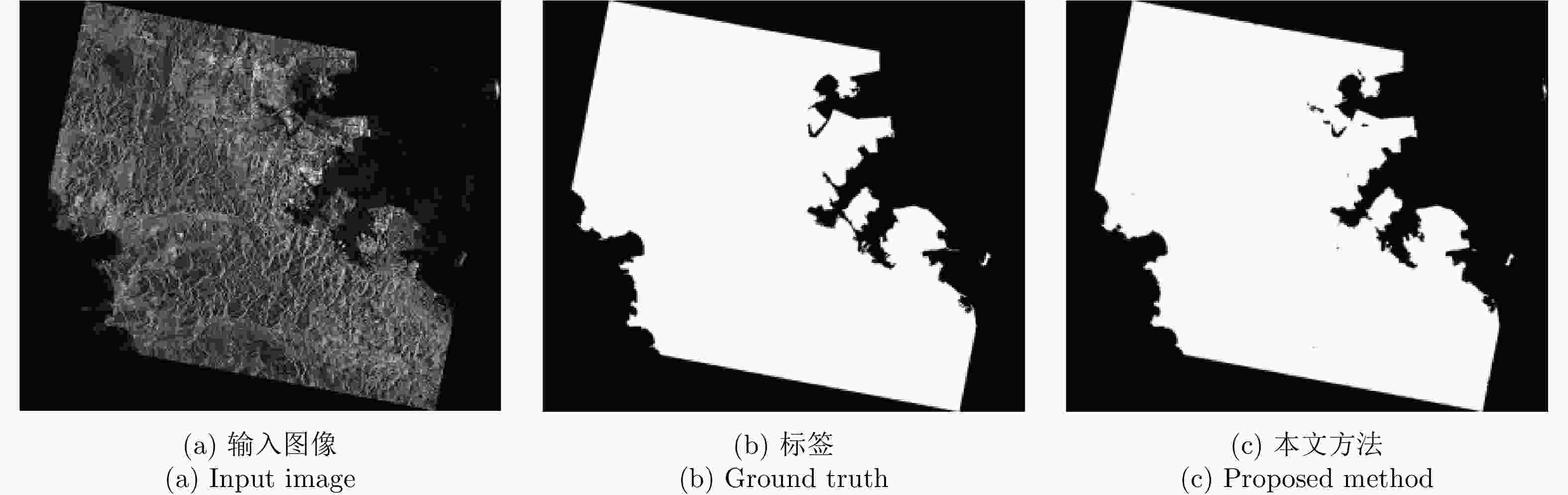

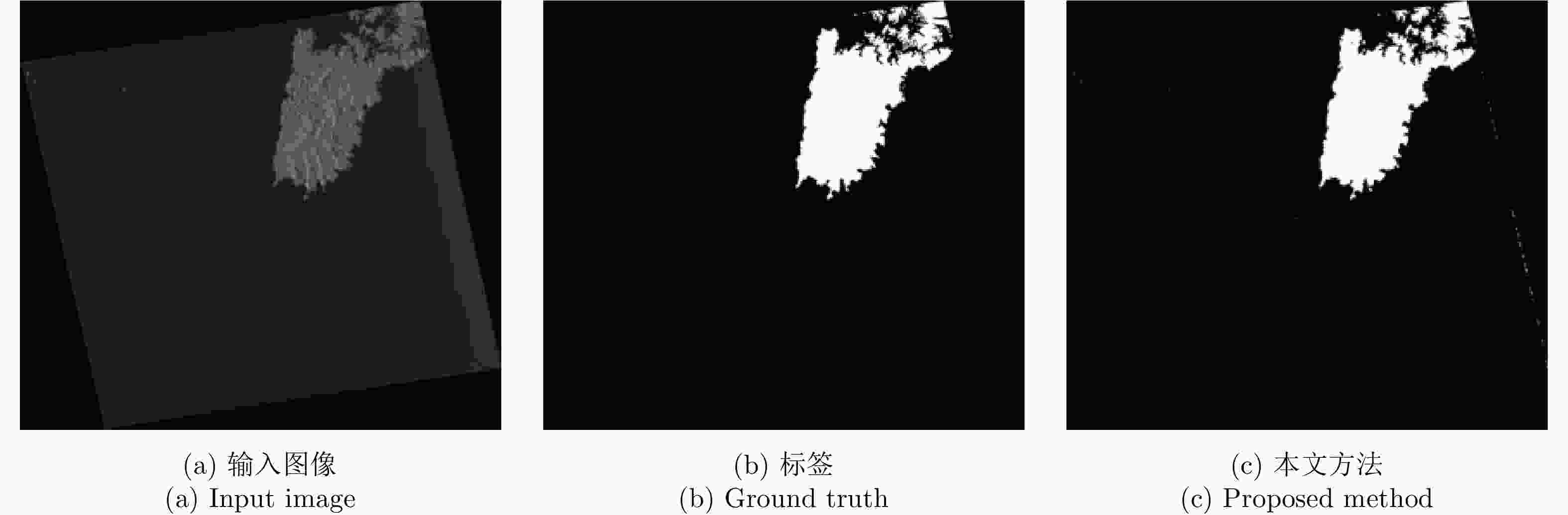

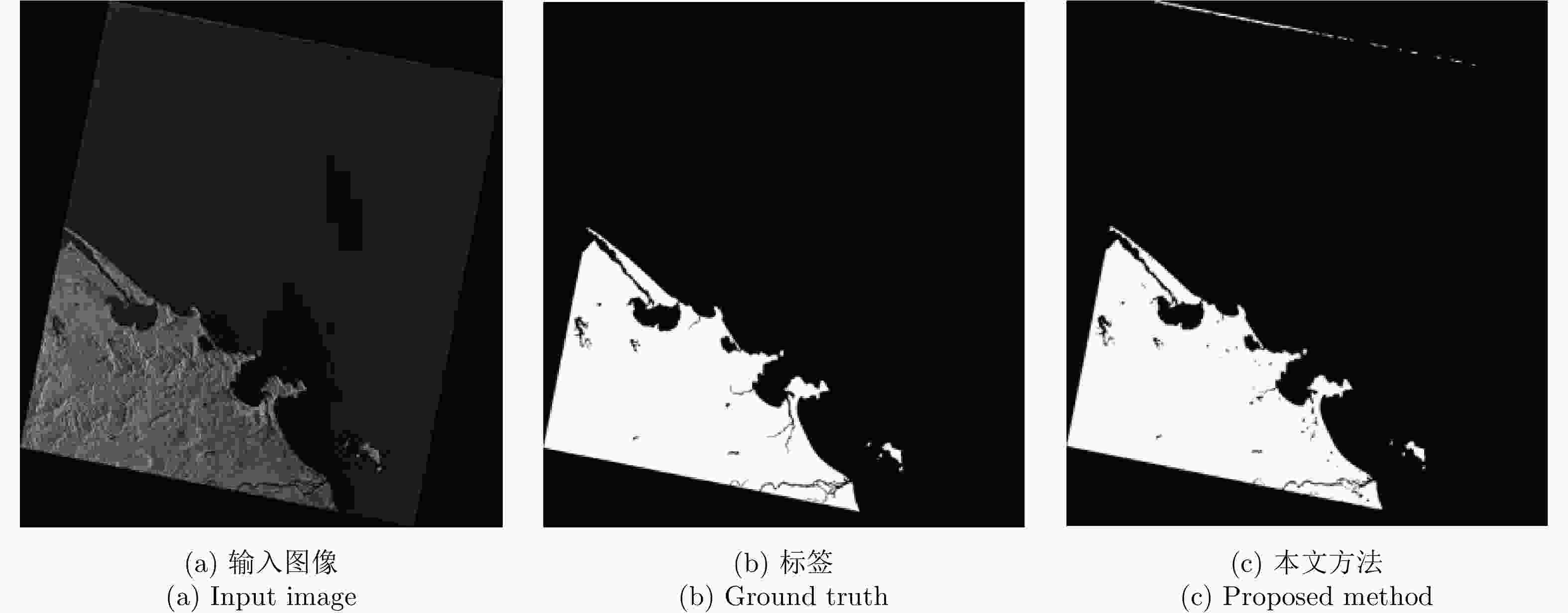

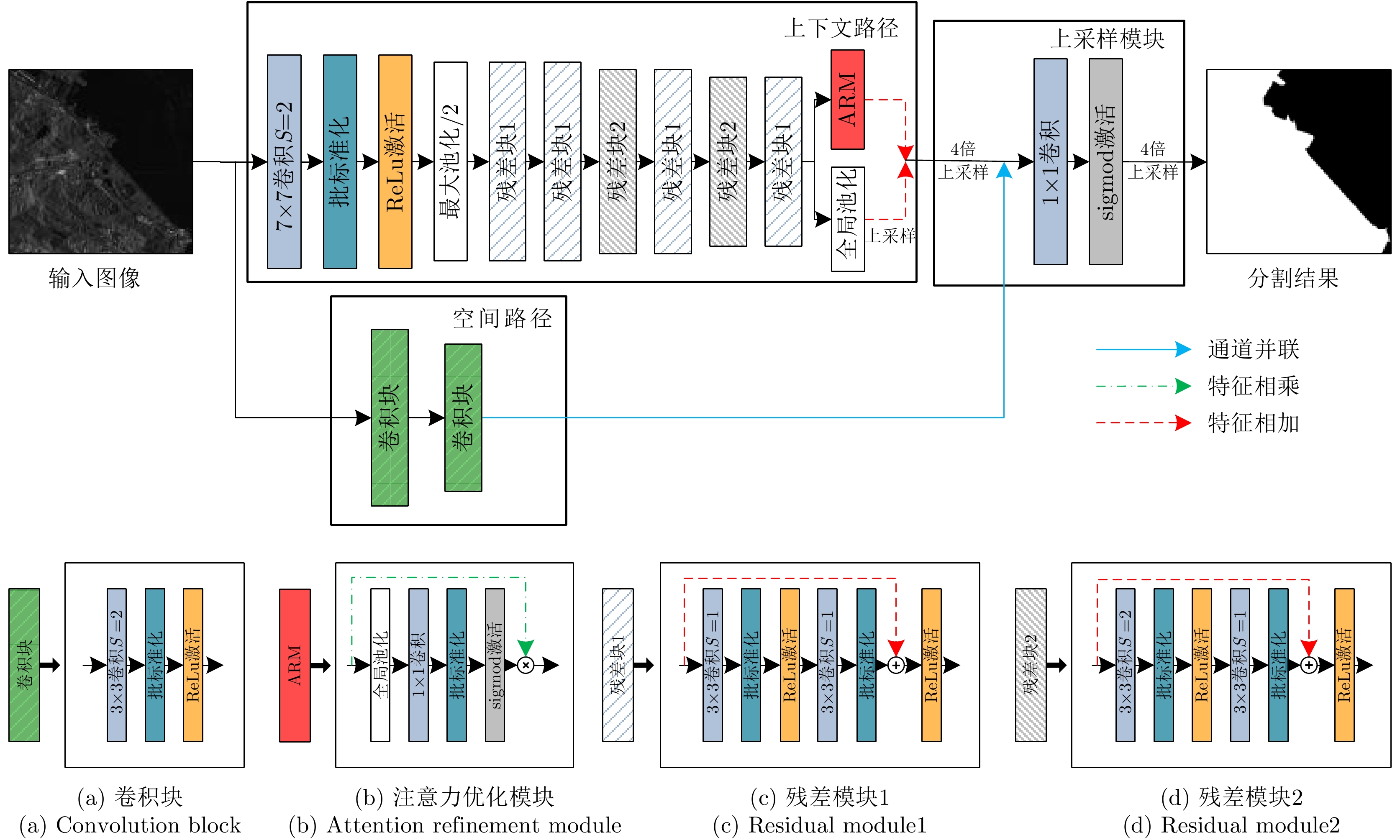

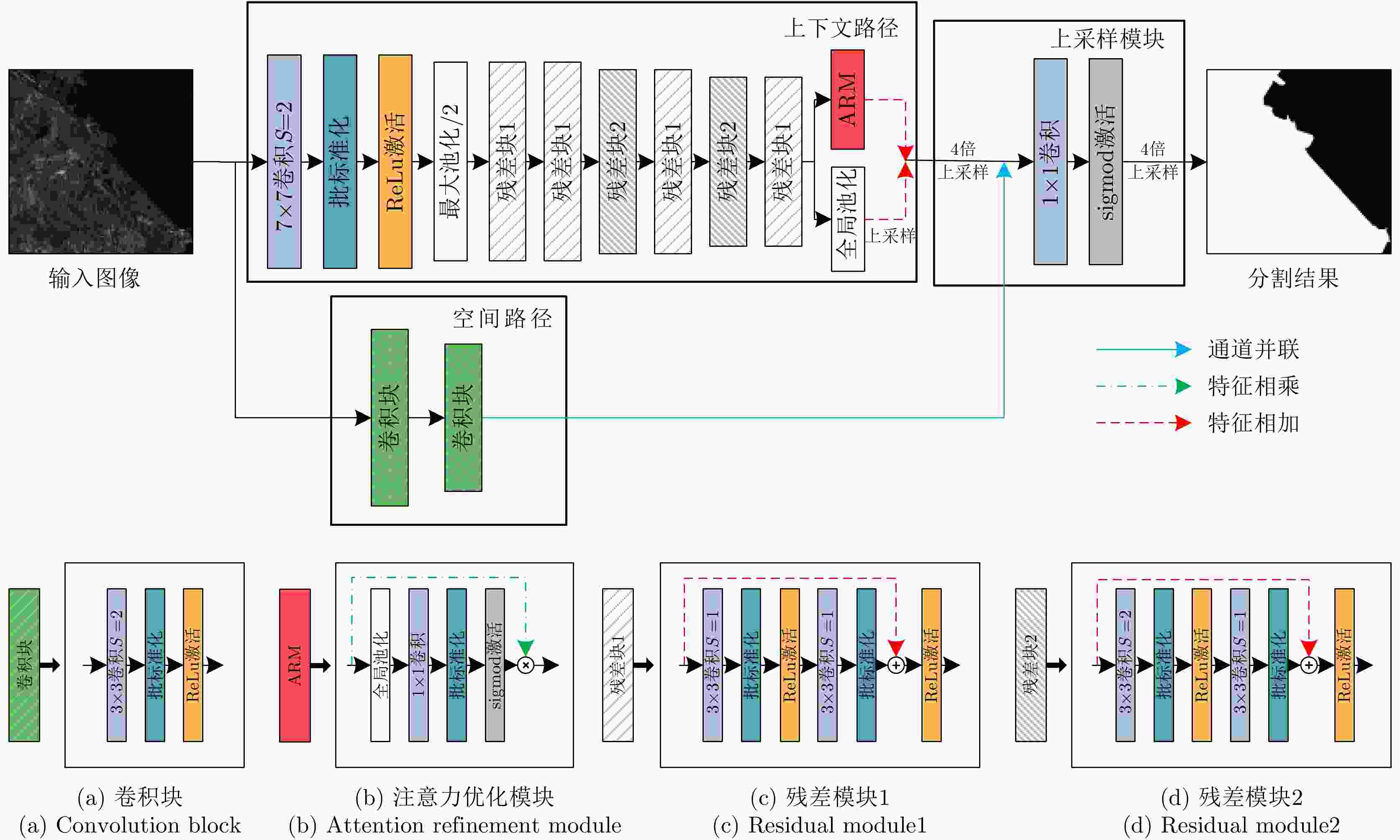

摘要: 海陆分割是海岸线提取、近岸目标检测的一个基本步骤。传统的海陆分割算法分割准确度差,参数调节繁琐,难以满足实际应用要求。卷积神经网络能够高效地提取图像多个层次特征,广泛应用于图像分类任务,可作为海陆分割新的技术途径。其中双边网络(BiSeNet)能有效平衡分割精度和速度,在自然场景图像语义分割任务上取得了较好的表现。但对于SAR图像海陆分割任务,双边网络难以有效提取SAR图像的上下文语义信息和空间信息,分割效果较差。针对上述问题,该文根据SAR图像特点减少双边网络中空间路径的卷积层数,从而降低空间信息的损失,并选用ResNet18轻量化模型作为上下文路径骨干网络,减少过拟合现象并提供较广阔的特征感受野,同时提出边缘增强损失函数策略,提升模型分割性能。基于高分三号SAR图像数据的实验表明,所提方法可有效提升网络的预测精度和分割速率,其分割准确度和F1分数分别达到了0.9889和0.9915,对尺寸大小为1024×1024的SAR图像切片处理速率为12.7 frames/s,均优于当前主流的分割网络框架。此外,所提网络的规模较BiSeNet减少50%以上,并小于轻量级的U-Net架构,同时网络有较强的泛化性能,具有较高的实际应用价值。Abstract: Sea–land segmentation is a basic step in coastline extraction and nearshore target detection. Because of poor segmentation accuracy and complicated parameter adjustment, the traditional sea–land segmentation algorithm is difficult to adapt in practical applications. Convolutional neural networks, which can extract multiple hierarchical features of images, can be used as an alternative technical approach for sea–land segmentation tasks. Among them, BiSeNet exhibits good performance in the semantic segmentation of natural scene images and effectively balances segmentation accuracy and speed. However, for the sea–land segmentation of SAR images, BiSeNet cannot extract the contextual semantic and spatial information of SAR images; thus, the segmentation effect is poor. To address the aforementioned problem, this study reduced the number of convolution layers in the spatial path to reduce the loss of spatial information and selected the ResNet18 lightweight model as the backbone network for the context path to reduce the overfitting phenomenon and provide a broad receptive field. At the same time, strategies for edge enhancement and loss function are proposed to improve the segmentation performance of the network in the land and sea boundary region. Experimental results based on GF3 data showed that the proposed method effectively improves the prediction accuracy and segmentation rate of the network. The segmentation accuracy and F1 score of the proposed method are 0.9889 and 0.9915, respectively, and the processing rate of SAR image slices with the resolution of 1024 × 1024 is 12.7 frames/s, which are better than those of other state-of-the-art approaches. Moreover, the size of the network is more than half of that of BiSeNet and smaller than that of U-Net. Thus, the network exhibits strong generalization performance.

-

表 1 选用数据的工作模式

Table 1. The imaging modes of data

工作模式 分辨率(m) 极化方式 成像幅宽(km) 聚束(SL) 1 单极化 10 超精细条带(UFS) 3 单极化 30 精细条带1(FSI) 5 双极化 50 精细条带2(FSII) 10 双极化 100 标准条带(SS) 25 双极化 130 表 2 两类方法在测试数据集上的分割结果对比

Table 2. Comparison of segmentation results of two methods on the test dataset

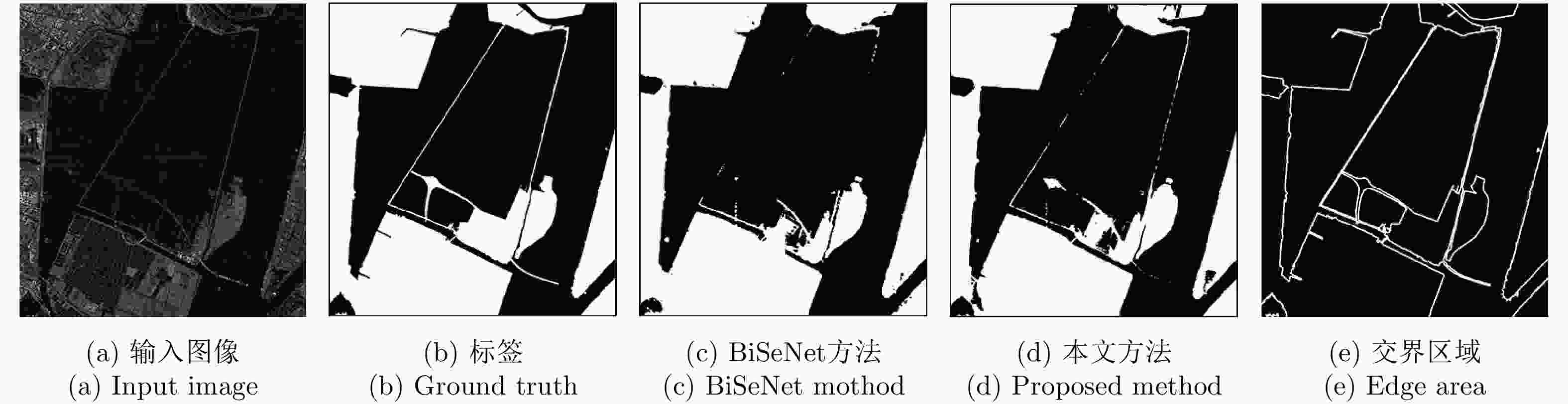

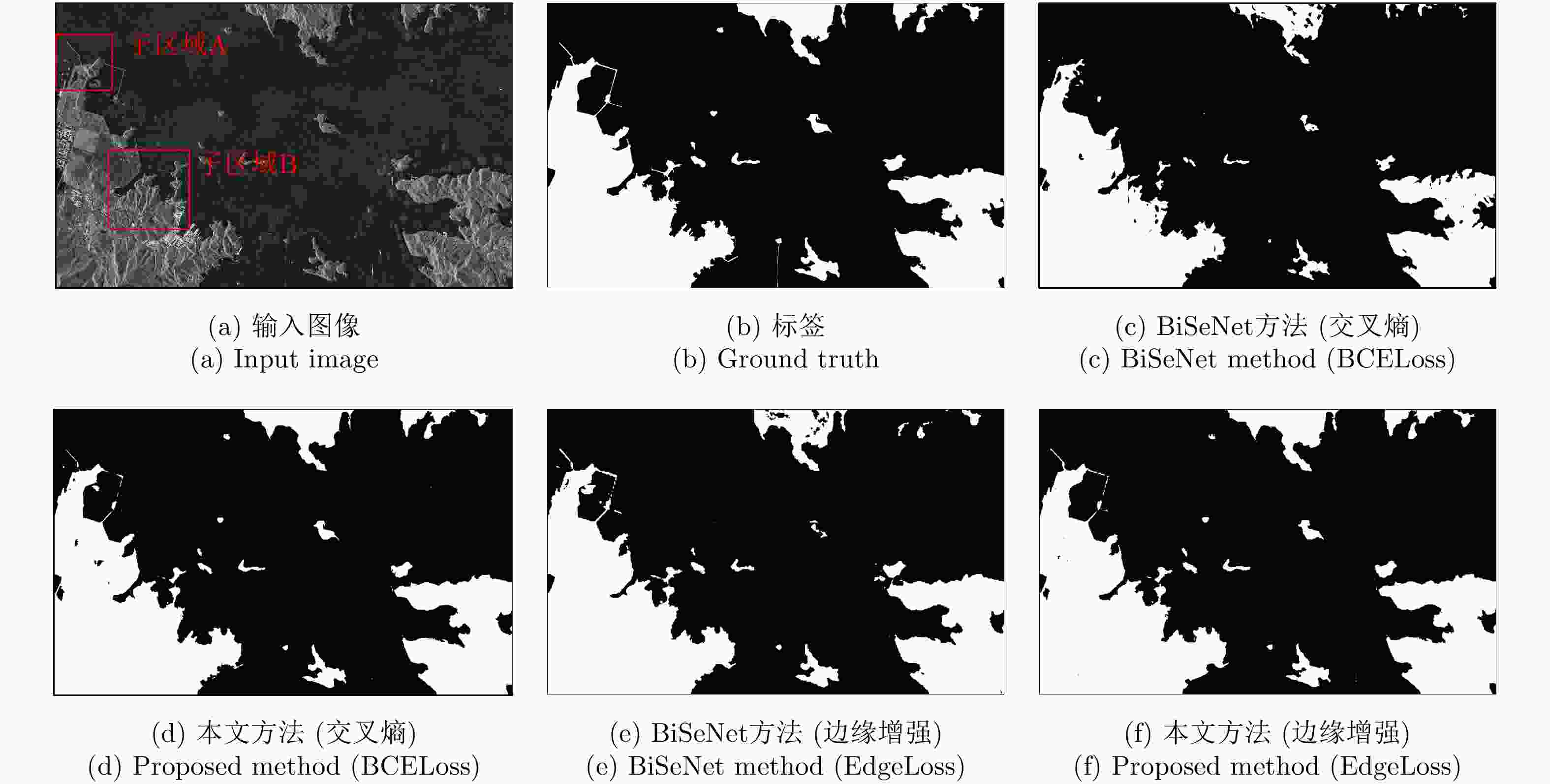

方法 LP(%) LR(%) SP(%) SR(%) EP(%) OP(%) ${ {{F} }_{\rm{1} } }$(%) 总分割时间(s) BiSeNet方法 98.27 99.10 98.27 96.68 66.12 98.27 98.68 54.32 本文方法 99.33 98.89 97.91 98.74 75.31 98.83 99.11 26.73 表 3 使用不同损失函数的两类方法在测试数据集上的分割结果对比

Table 3. Comparison of segmentation results of two methods using different loss function on the test dataset

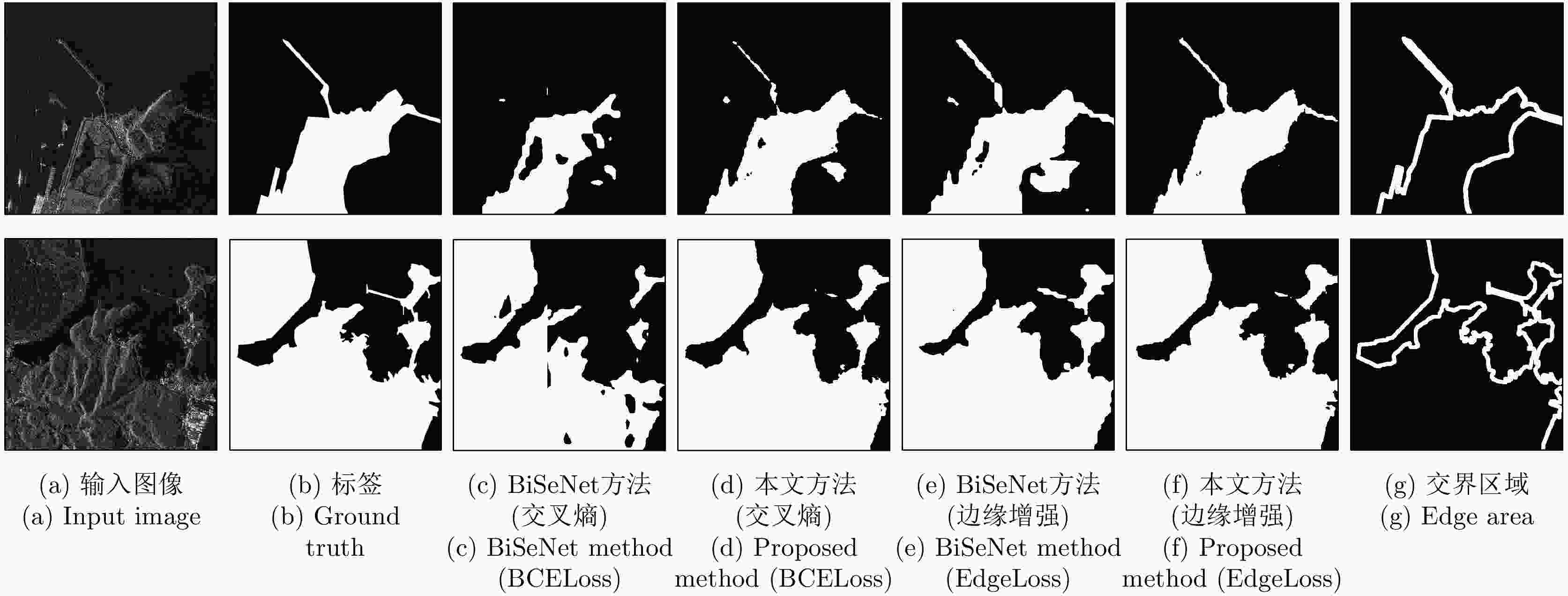

方法 LP(%) LR(%) SP(%) SR(%) EP(%) OP(%) ${ {{F} }_{\rm{1} } }$(%) 总分割时间(s) BiSeNet(交叉熵) 98.27 99.10 98.27 96.68 66.12 98.27 98.68 54.32 BiSeNet方法(边缘增强) 98.62 98.78 97.67 97.37 70.75 98.31 98.70 55.02 本文方法(交叉熵) 99.33 98.89 97.91 98.74 75.31 98.83 99.11 26.73 本文方法(边缘增强) 99.11 99.20 98.48 98.30 76.57 98.89 99.15 26.38 表 4 不同方法在测试数据集上的分割结果对比

Table 4. Comparison of segmentation results of different methods

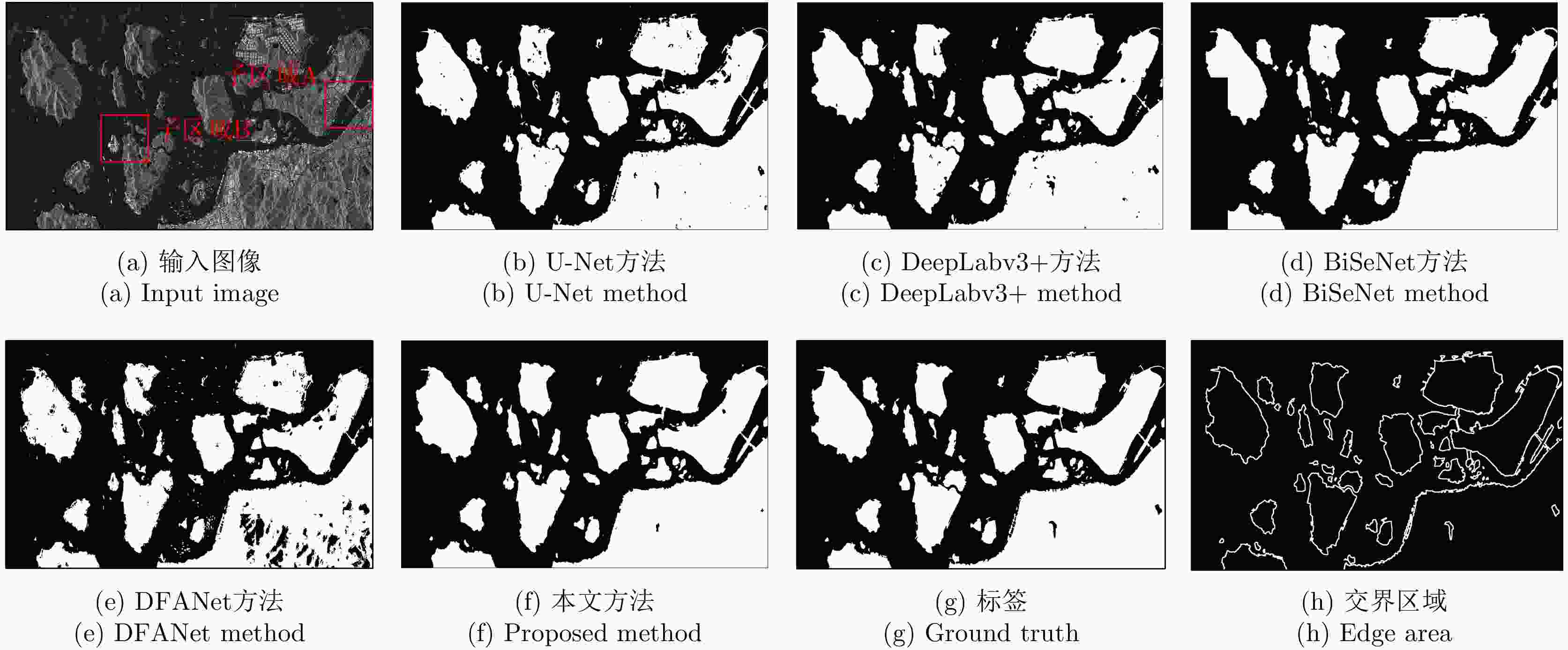

方法 LP(%) LR(%) SP(%) SR(%) EP(%) OP(%) ${ {{F} }_{\rm{1} } }$(%) 切片速度(s) 总分割时间(s) U-Net方法 99.45 98.28 96.82 98.96 77.45 98.52 98.86 0.240 80.25 DeepLabv3+方法 98.97 98.13 96.51 98.06 71.83 98.11 98.55 0.279 93.14 BiSeNet方法 98.62 98.78 97.67 97.37 70.75 98.31 98.70 0.165 55.02 DFANet方法 98.97 81.18 73.38 98.39 68.82 87.12 89.20 0.212 70.81 本文方法 99.11 99.20 98.48 98.30 76.57 98.89 99.15 0.079 26.38 表 5 本文方法对各工作模式图像数据的分割结果(%)

Table 5. Segmentation result under multi-mode by the proposed method (%)

工作模式 分辨率(m) LP LR SP SR OP ${ {{F} }_{\rm{1} } }$ SL 1 99.56 99.28 99.20 99.51 99.39 99.42 FSI 5 98.49 99.06 99.71 99.53 99.42 98.78 FSII 10 97.88 97.97 99.86 99.85 99.72 97.93 SS 25 98.59 99.24 99.85 99.73 99.65 98.91 -

[1] 邢相薇, 计科峰, 康利鸿, 等. HRWS SAR图像舰船目标监视技术研究综述[J]. 雷达学报, 2015, 4(1): 107–121. doi: 10.12000/JR14144XING Xiangwei, JI Kefeng, KANG Lihong, et al. Review of ship surveillance technologies based on high-resolution wide-swath synthetic aperture radar imaging[J]. Journal of Radars, 2015, 4(1): 107–121. doi: 10.12000/JR14144 [2] 周明, 马亮, 王宁, 等. 面向海面目标检测的陆海分离和海面分区算法研究[J]. 雷达学报, 2019, 8(3): 366–372. doi: 10.12000/JR19036ZHOU Ming, MA Liang, WANG Ning, et al. Land-sea separation and sea surface zoning algorithms for sea surface target[J]. Journal of Radars, 2019, 8(3): 366–372. doi: 10.12000/JR19036 [3] 李智, 曲长文, 周强, 等. 基于SLIC超像素分割的SAR图像海陆分割算法[J]. 雷达科学与技术, 2017, 15(4): 354–358. doi: 10.3969/j.issn.1672-2337.2017.04.003LI Zhi, QU Changwen, ZHOU Qiang, et al. A sea-land segmentation algorithm of SAR image based on the SLIC superpixel division[J]. Radar Science and Technology, 2017, 15(4): 354–358. doi: 10.3969/j.issn.1672-2337.2017.04.003 [4] 安成锦, 牛照东, 李志军, 等. 典型Otsu算法阈值比较及其SAR图像水域分割性能分析[J]. 电子与信息学报, 2010, 32(9): 2215–2219. doi: 10.3724/SP.J.1146.2009.01426AN Chengjin, NIU Zhaodong, LI Zhijun, et al. Otsu threshold comparison and SAR water segmentation result analysis[J]. Journal of Electronics &Information Technology, 2010, 32(9): 2215–2219. doi: 10.3724/SP.J.1146.2009.01426 [5] OTSU N. A threshold selection method from gray-level histograms[J]. IEEE Transactions on Systems, Man, and Cybernetics, 1979, 9(1): 62–66. doi: 10.1109/TSMC.1979.4310076 [6] LIU Chun, YANG Jian, YIN Junjun, et al. Coastline detection in SAR images using a hierarchical level set segmentation[J]. IEEE Journal of Selected Topics in Applied Earth Observations and Remote Sensing, 2016, 9(11): 4908–4920. doi: 10.1109/jstars.2016.2613279 [7] 侯彪, 胡育辉, 焦李成. SAR图像水域的改进Shearlet边缘检测[J]. 中国图象图形学报, 2010, 15(10): 1549–1554. doi: 10.11834/jig.20101019HOU Biao, HU Yuhui, and JIAO Licheng. Improved shearlet edge detection for waters of SAR images[J]. Journal of Image and Graphics, 2010, 15(10): 1549–1554. doi: 10.11834/jig.20101019 [8] LIU Zhongling, LI Fei, LI Ning, et al. A novel region-merging approach for coastline extraction from sentinel-1A IW mode SAR imagery[J]. IEEE Geoscience and Remote Sensing Letters, 2016, 13(3): 324–328. doi: 10.1109/LGRS.2015.2510745 [9] 黄祥李, 张杰, 计科峰, 等. 基于GSHHG数据库与改进CV模型的SAR图像海陆分割算法[C]. 第五届高分辨率对地观测学术年会论文集, 西安, 中国, 2018, 877–892.HUANG Xiangli, ZHANG Jie, JI Kefeng, et al. Sea-land segmentation algorithm of SAR image based on GSHHG database and improved CV model[C]. The 5th China High Resolution Earth Observation Conference, Xi’an, China, 2018, 877–892. [10] SHELHAMER E, LONG J, and DARRELL T. Fully convolutional networks for semantic segmentation[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2017, 39(4): 640–651. doi: 10.1109/TPAMI.2016.2572683 [11] RONNEBERGER O, FISCHER P, and BROX T. U-Net: Convolutional networks for biomedical image segmentation[C]. The 18th International Conference on Medical Image Computing and Computer-assisted Intervention, Munich, Germany, 2015: 234–241. doi: 10.1007/978-3-319-24574-4_28. [12] BADRINARAYANAN V, KENDALL A, and CIPOLLA R. SegNet: A deep convolutional encoder-decoder architecture for image segmentation[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2017, 39(12): 2481–2495. doi: 10.1109/TPAMI.2016.2644615 [13] CHEN L C, PAPANDREOU G, KOKKINOS I, et al. DeepLab: Semantic image segmentation with deep convolutional nets, atrous convolution, and fully connected CRFs[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2018, 40(4): 834–848. doi: 10.1109/TPAMI.2017.2699184 [14] ZHAO Hengshuang, SHI Jianping, QI Xiaojuan, et al. Pyramid scene parsing network[C]. 2017 IEEE Conference on Computer Vision and Pattern Recognition, Honolulu, USA, 2017: 6230–6239. doi: 10.1109/CVPR.2017.660. [15] 李宁, 牛世林. 基于局部超分辨重建的高精度SAR图像水域分割方法[J]. 雷达学报, 2020, 9(1): 174–184. doi: 10.12000/JR19096LI Ning and NIU Shilin. High-precision water segmentation from synthetic aperture radar images based on local super-resolution restoration technology[J]. Journal of Radars, 2020, 9(1): 174–184. doi: 10.12000/JR19096 [16] SHAMSOLMOALI P, ZAREAPOOR M, WANG Ruili, et al. A novel deep structure U-Net for sea-land segmentation in remote sensing images[J]. IEEE Journal of Selected Topics in Applied Earth Observations and Remote Sensing, 2019, 12(9): 3219–3232. doi: 10.1109/JSTARS.2019.2925841 [17] LI Ruirui, LIU Wenjie, YANG Lei, et al. DeepUNet: A deep fully convolutional network for pixel-level sea-land segmentation[J]. IEEE Journal of Selected Topics in Applied Earth Observations and Remote Sensing, 2018, 11(11): 3954–3962. doi: 10.1109/JSTARS.2018.2833382 [18] 张金松, 邢孟道, 孙光才. 一种基于密集深度分离卷积的SAR图像水域分割算法[J]. 雷达学报, 2019, 8(3): 400–412. doi: 10.12000/JR19008ZHANG Jinsong, XING Mengdao, and SUN Guangcai. A water segmentation algorithm for SAR image based on dense depthwise separable convolution[J]. Journal of Radars, 2019, 8(3): 400–412. doi: 10.12000/JR19008 [19] YU Changqian, WANG Jingbo, PENG Chao, et al. BiSeNet: Bilateral segmentation network for real-time semantic segmentation[C]. The 15th European Conference on Computer Vision, Munich, Germany, 2018: 334–349. doi: 10.1007/978-3-030-01261-8_20. [20] 张庆君. 高分三号卫星总体设计与关键技术[J]. 测绘学报, 2017, 46(3): 269–277. doi: 10.11947/j.AGCS.2017.20170049ZHANG Qingjun. System design and key technologies of the GF-3 satellite[J]. Acta Geodaetica et Cartographica Sinica, 2017, 46(3): 269–277. doi: 10.11947/j.AGCS.2017.20170049 [21] LI Hanchao, XIONG Pengfei, FAN Haoqiang, et et al. DFANet: Deep feature aggregation for real-time semantic segmentation[C]. 2019 IEEE/CVF Conference on Computer Vision and Pattern Recognition, Long Beach, USA, 2019: 9514–9523. doi: 10.1109/CVPR.2019.00975. [22] 张彤彤, 董军宇, 赵浩然, 等. 基于知识蒸馏的轻量型浮游植物检测网络[J]. 应用科学学报, 2020, 38(3): 367–376. doi: 10.3969/j.issn.0255-8297.2020.03.003ZHANG Tongtong, DONG Junyu, ZHAO Haoran, et al. Lightweight phytoplankton detection network based on knowledge distillation[J]. Journal of Applied Sciences, 2020, 38(3): 367–376. doi: 10.3969/j.issn.0255-8297.2020.03.003 -

作者中心

作者中心 专家审稿

专家审稿 责编办公

责编办公 编辑办公

编辑办公

下载:

下载: