-

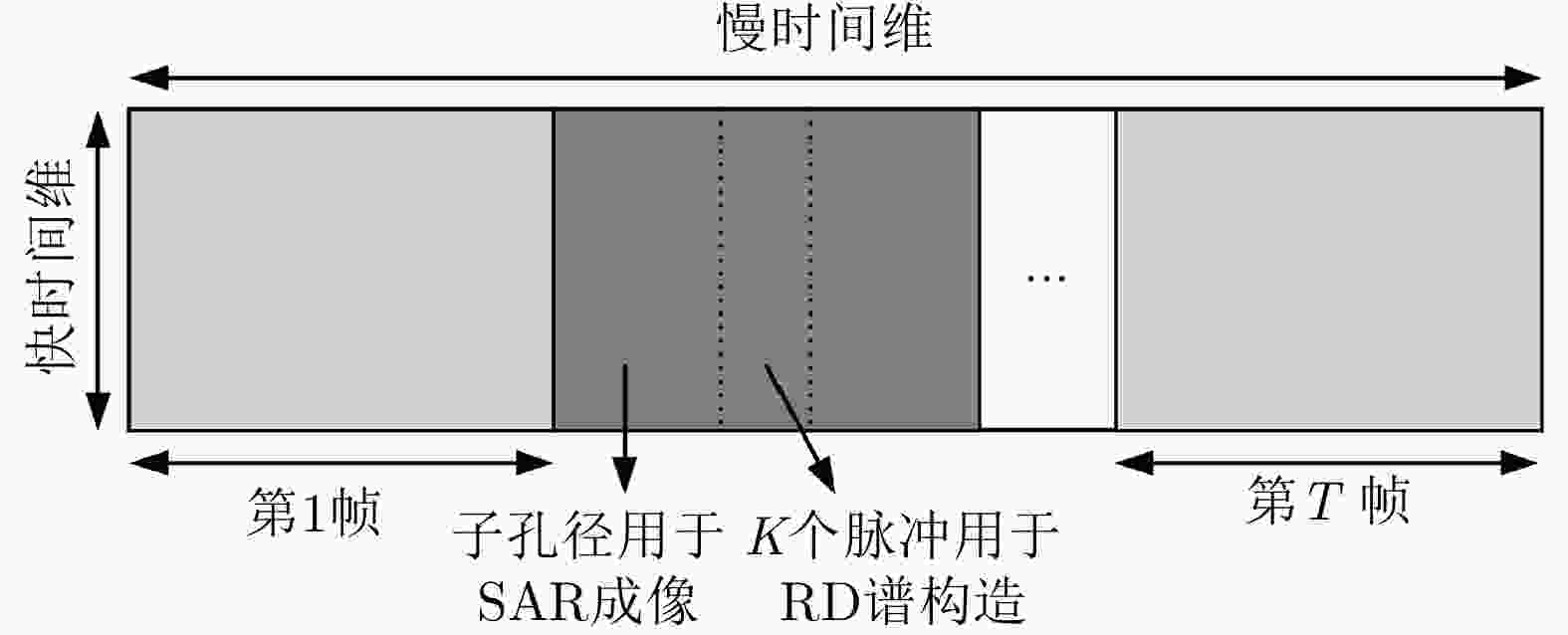

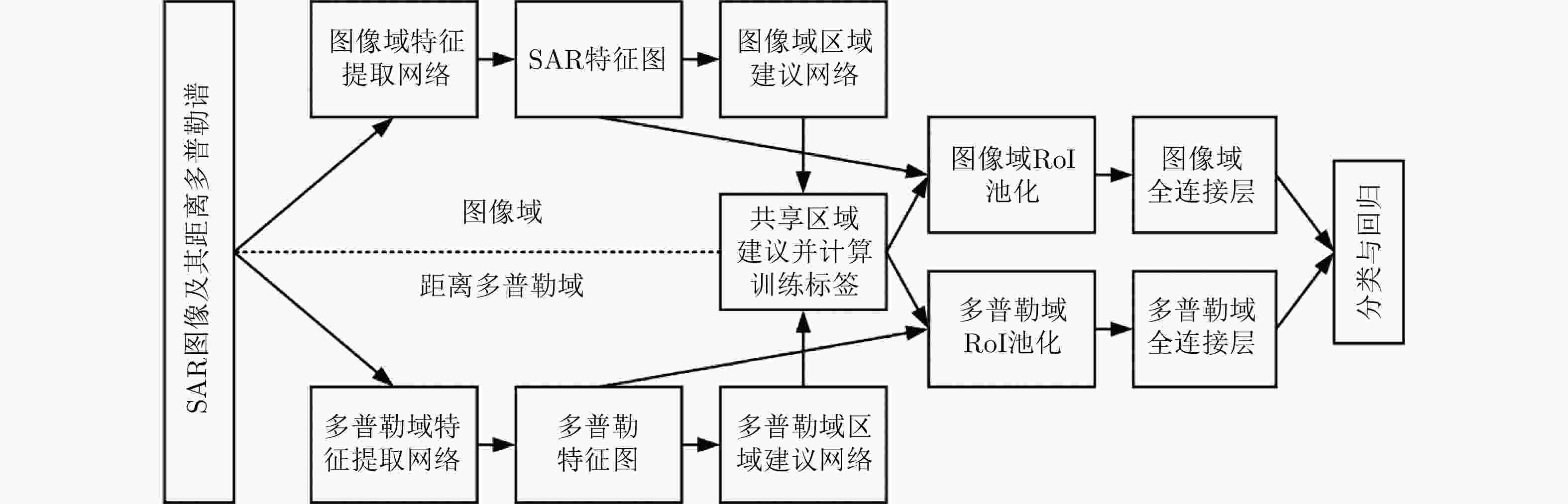

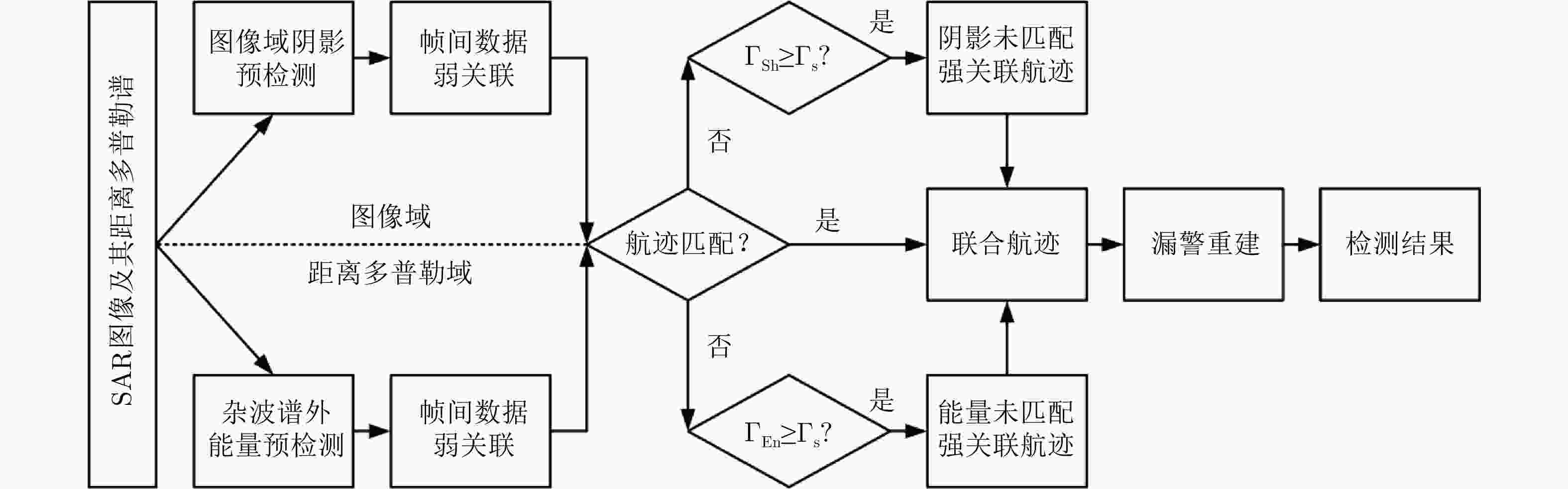

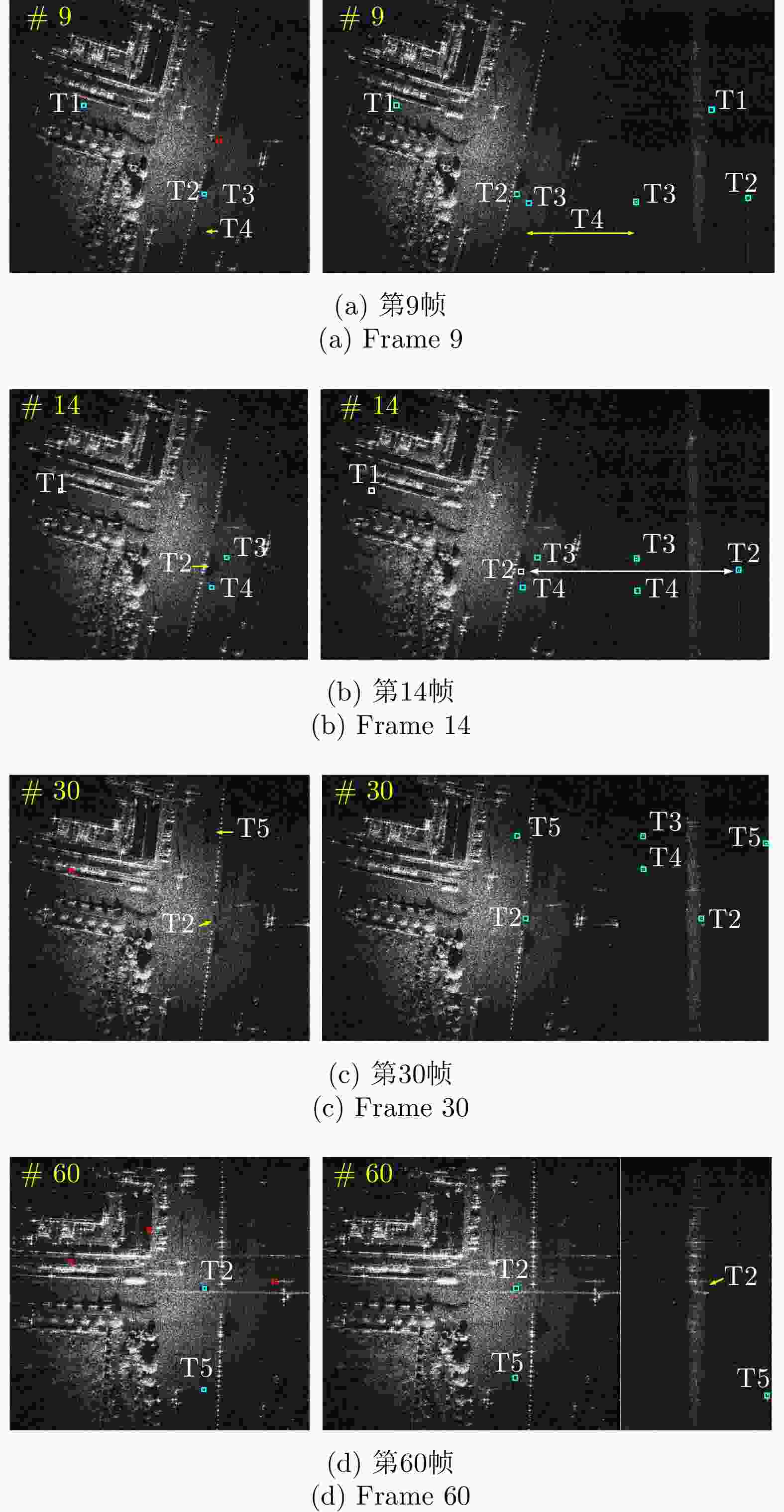

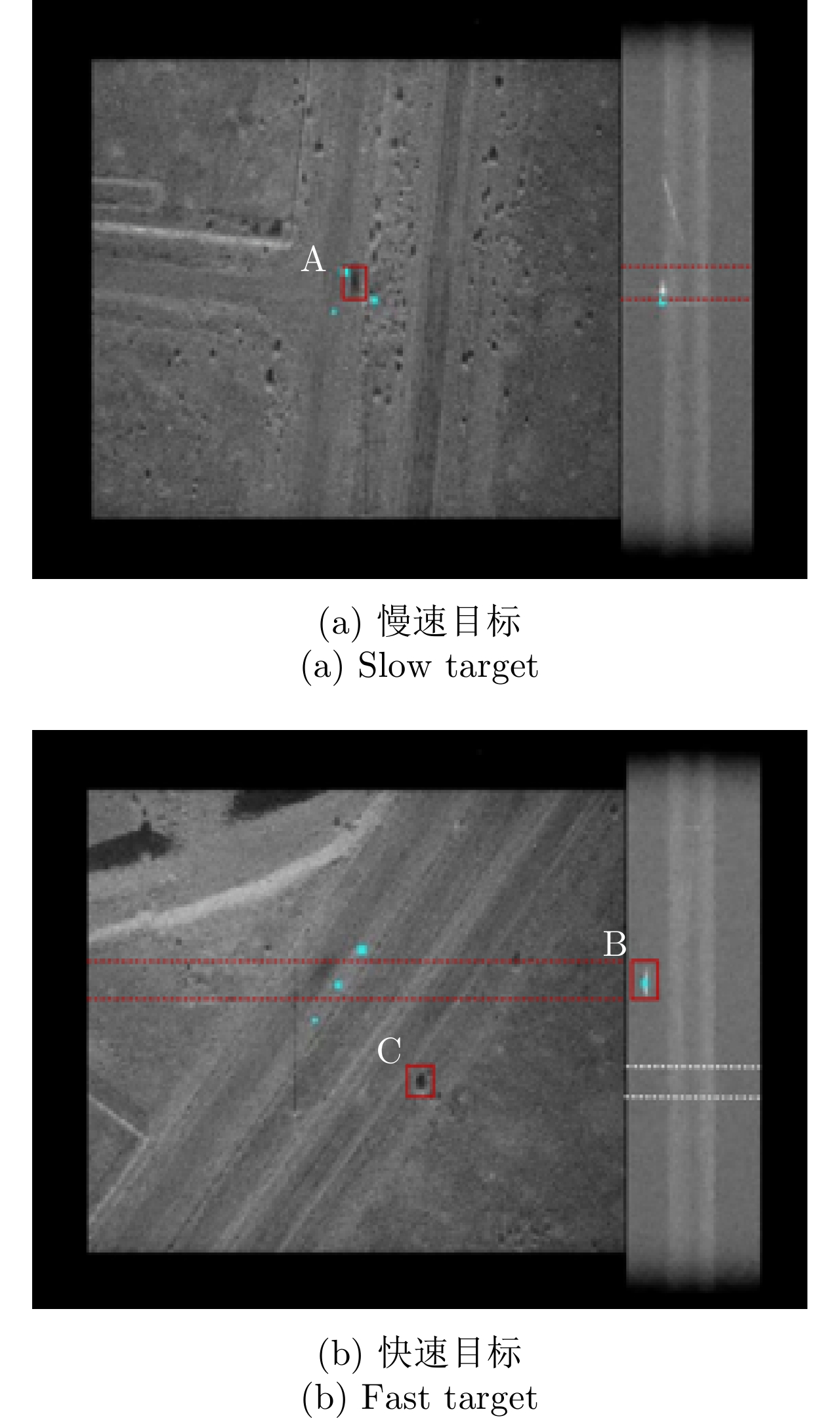

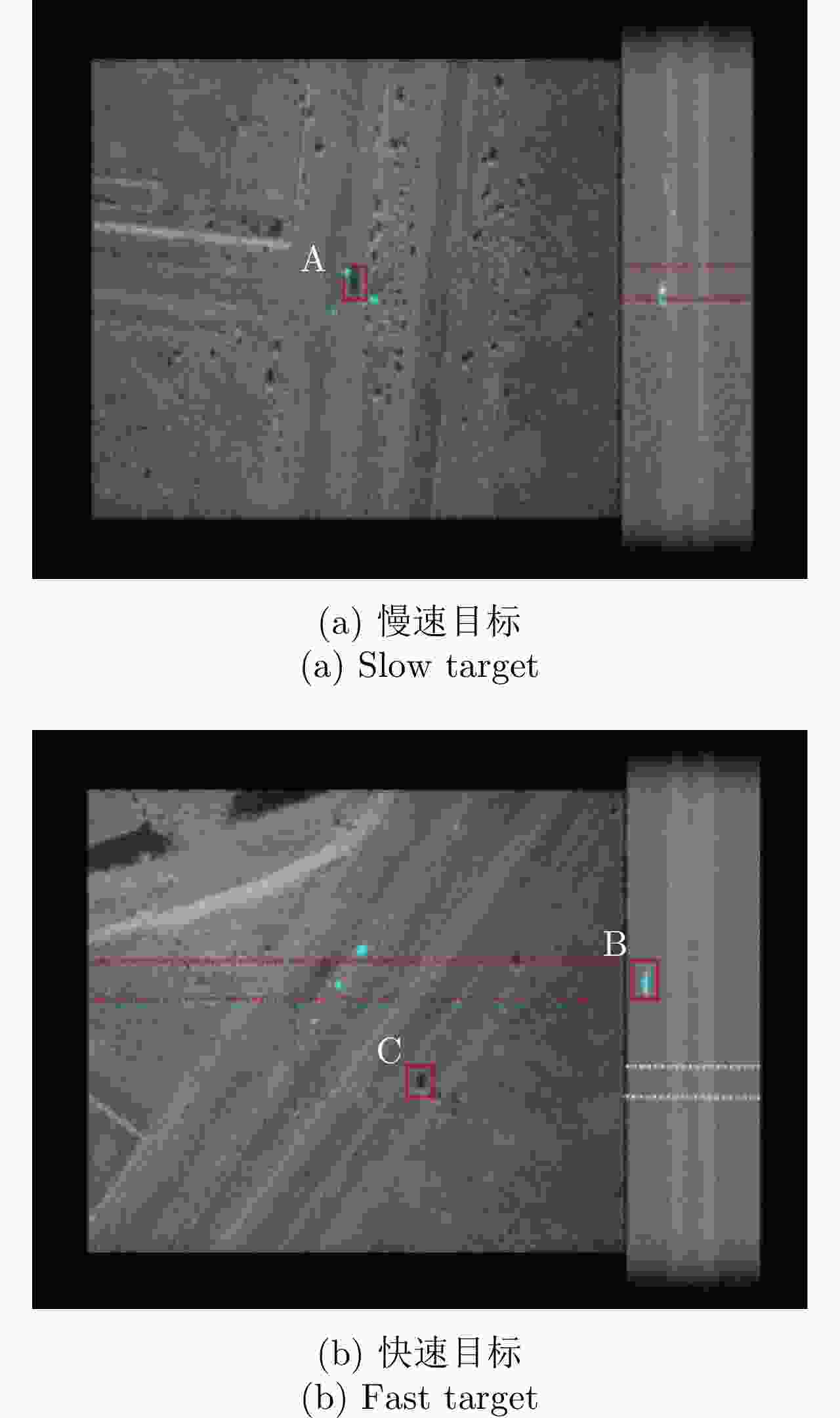

摘要: 视频合成孔径雷达(SAR)具有高帧率成像能力,可作为地面运动目标探测的重要技术手段。经典SAR地面动目标显示(SAR-GMTI)依靠目标回波能量来实现动目标检测,同时动目标阴影亦可作为视频SAR动目标检测的重要途径。然而,由于动目标能量和阴影的畸变或涂抹,依靠单一方式难以实现稳健的动目标检测。该文基于目标能量和阴影的双域联合检测思想,分别通过快速区域卷积神经网络和航迹关联两种技术途径实现了视频SAR动目标联合检测,给出了机载实测数据处理结果,并进行了详细分析。该文方法充分利用目标阴影与能量的特征及空时信息,提升了机动目标检测的稳健性。Abstract: Video Synthetic Aperture Radar (SAR) presents great potential in ground moving target detection and tracking through high frame rate and high-resolution imaging. Target Doppler energy is essential for traditional SAR Ground Moving Target Indication (SAR-GMTI), as the target shadow can also be used for detection in video SAR. However, neither of these detection methods can stand alone to achieve robust detection in video SAR, owing to the distortion or smearing of target energy and its shadow. This paper presents the processing results of airborne video SAR real data using the Faster Region-based Convolutional Neural Network (Faster R-CNN) and the traditional track association based on dual-domain joint detection as proposed in the literature. These two approaches successfully utilize the feature and space time information of target Doppler energy and shadow in the detection of a maneuvering target.

-

Key words:

- Video SAR /

- Moving target detection /

- Shadow detection /

- Radar imaging /

- Video radar

-

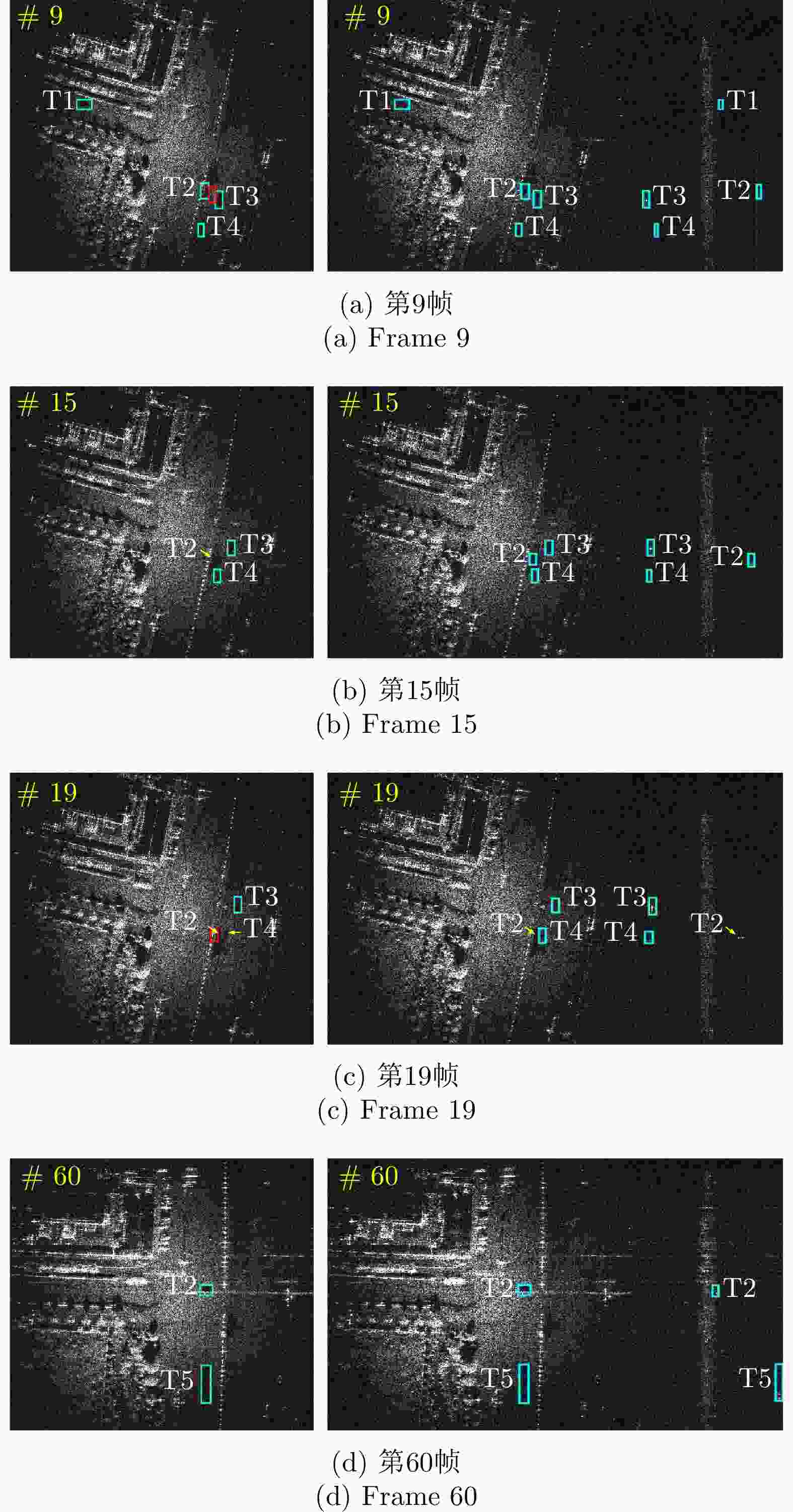

表 1 运动目标阴影及其能量所在帧

Table 1. Frame number of target shadow and energy

表 2 动目标检测性能统计结果

Table 2. Statistical results of moving target detection in SAR imagery

方法 虚警 漏警 图像域帧间关联 75 63 Faster R-CNN 7 16 Dual Faster R-CNN 0 17 联合域航迹关联(JTA) 1 15 表 3 处理耗时对比结果

Table 3. Comparison of processing times

方法 单帧平均耗时(s) 图像域帧间关联 1.58 Faster R-CNN 1.55 Dual Faster R-CNN 2.89 联合域航迹关联(JTA) 2.21 -

[1] DAMINI A, BALAJI B, PARRY C, et al. A videoSAR mode for the x-band wideband experimental airborne radar[C]. SPIE 7699, Algorithms for Synthetic Aperture Radar Imagery XVII, Orlando, USA, 2010: 76990E. [2] MILLER J, BISHOP E, and DOERRY A. An application of backprojection for video SAR image formation exploiting a subaperature circular shift register[C]. SPIE 8746, Algorithms for Synthetic Aperture Radar Imagery XX, Baltimore, USA, 2013: 874609. [3] WALLACE H B. Development of a video SAR for FMV through clouds[C]. SPIE 9479, Architecture/Open Business Model Net-Centric Systems and Defense Transformation 2015, Baltimore, USA, 2015: 94790L. [4] CHEN H C and MCGILLEM C D. Target motion compensation by spectrum shifting in synthetic aperture radar[J]. IEEE Transactions on Aerospace and Electronic Systems, 1992, 28(3): 895–901. doi: 10.1109/7.256313 [5] BARBAROSSA S and FARINA A. Detection and imaging of moving objects with synthetic aperture radar. Part 2: Joint time-frequency analysis by Wigner-Ville distribution[J]. Journals & Magazines, 1992, 139(1): 89–97. doi: 10.1049/ip-f-2.1992.0011 [6] HUANG Penghui, LIAO Guisheng, YANG Zhiwei, et al. A fast SAR imaging method for ground moving target using a second-order WVD transform[J]. IEEE Transactions on Geoscience and Remote Sensing, 2016, 54(4): 1940–1956. doi: 10.1109/TGRS.2015.2490582 [7] LIGHTSTONE L, FAUBERT D, and REMPEL G. Multiple phase centre DPCA for airborne radar[C]. 1991 IEEE National Radar Conference, Los Angeles, USA, 1991: 36–40. [8] ZHANG Yuhong. Along track interferometry synthetic aperture radar (ATI-SAR) techniques for ground moving target detection[R]. AFRL-SN-RS-TR-2005-410, 2006. [9] 丁金闪. 视频SAR成像与动目标阴影检测技术[J]. 雷达学报, 2020, 9(2): 321–334. doi: 10.12000/JR20018DING Jinshan. Focusing algorithms and moving target detection based on video SAR[J]. Journal of Radars, 2020, 9(2): 321–334. doi: 10.12000/JR20018 [10] JAHANGIR M. Moving target detection for synthetic aperture radar via shadow detection[C]. 2007 IET International Conference on Radar Systems, Edinburgh, UK, 2007: 1–5. [11] WANG Hui, CHEN Zhansheng, and ZHENG Shichao. Preliminary research of low-RCS moving target detection based on Ka-band video SAR[J]. IEEE Geoscience and Remote Sensing Letters, 2017, 14(6): 811–815. doi: 10.1109/LGRS.2017.2679755 [12] ZHANG Ying, MAO Xinhua, YAN He, et al. A novel approach to moving targets shadow detection in VideoSAR imagery sequence[C]. 2017 IEEE International Geoscience and Remote Sensing Symposium, Fort Worth, USA, 2017: 606–609. [13] TIAN Xiaoqing, LIU Jing, MALLICK M, et al. Simultaneous detection and tracking of moving-target shadows in ViSAR imagery[J]. IEEE Transactions on Geoscience and Remote Sensing, 2021, 59(2): 1182–1199. doi: 10.1109/TGRS.2020.2998782 [14] ZHAO Baojun, HAN Yuqi, WANG Hongshuo, et al. Robust shadow tracking for video SAR[J]. IEEE Geoscience and Remote Sensing Letters, 2021, 18(5): 821–825. doi: 10.1109/LGRS.2020.2988165 [15] DING Jinshan, WEN Liwu, ZHONG Chao, et al. Video SAR moving target indication using deep neural network[J]. IEEE Transactions on Geoscience and Remote Sensing, 2020, 58(10): 7194–7204. doi: 10.1109/TGRS.2020.2980419 [16] ZHANG Yun, YANG Shiyu, LI Hongbo, et al. Shadow tracking of moving target based on CNN for video SAR system[C]. 2018 IEEE International Geoscience and Remote Sensing Symposium, Valencia, Spain, 2018: 4399–4402. [17] ZHANG Hao and LIU Zhe. Moving target shadow detection based on deep learning in video SAR[C]. 2021 IEEE International Geoscience and Remote Sensing Symposium, Brussels, Belgium, 2021: 4155–4158. [18] WEN Liwu, DING Jinshan, and LOFFELD O. Video SAR moving target detection using dual faster R-CNN[J]. IEEE Journal of Selected Topics in Applied Earth Observations and Remote Sensing, 2021, 14: 2984–2994. doi: 10.1109/JSTARS.2021.3062176 [19] REN Shaoqing, HE Kaiming, GIRSHICK R, et al. Faster R-CNN: Towards real-time object detection with region proposal networks[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2017, 39(6): 1137–1149. doi: 10.1109/TPAMI.2016.2577031 [20] ZHONG Chao, DING Jinshan, and ZHANG Yuhong. Joint tracking of moving target in single-channel video SAR[J]. IEEE Transactions on Geoscience and Remote Sensing, 2022, 60: 5212718. doi: 10.1109/TGRS.2021.3115491 [21] BAR-SHALOM Y, FORTMANN T E, and CABLE P G. Tracking and data association[J]. The Journal of the Acoustical Society of America, 1990, 87(2): 918–919. doi: 10.1121/1.398863 [22] REID D. An algorithm for tracking multiple targets[J]. IEEE Transactions on Automatic Control, 1979, 24(6): 843–854. doi: 10.1109/TAC.1979.1102177 [23] ROHLING H. Radar CFAR thresholding in clutter and multiple target situations[J]. IEEE Transactions on Aerospace and Electronic Systems, 1983, AES-19(4): 608–621. doi: 10.1109/TAES.1983.309350 [24] SINGER R A and SEA R G. New results in optimizing surveillance system tracking and data correlation performance in dense multitarget environments[J]. IEEE Transactions on Automatic Control, 1973, 18(6): 571–582. doi: 10.1109/TAC.1973.1100421 [25] RAMACHANDRA K V and DIVISION R C. Optimum steady state position, velocity, and acceleration estimation using noisy sampled position data[J]. IEEE Transactions on Aerospace and Electronic Systems, 1987, AES-23(5): 705–708. doi: 10.1109/TAES.1987.310865 -

作者中心

作者中心 专家审稿

专家审稿 责编办公

责编办公 编辑办公

编辑办公

下载:

下载: