-

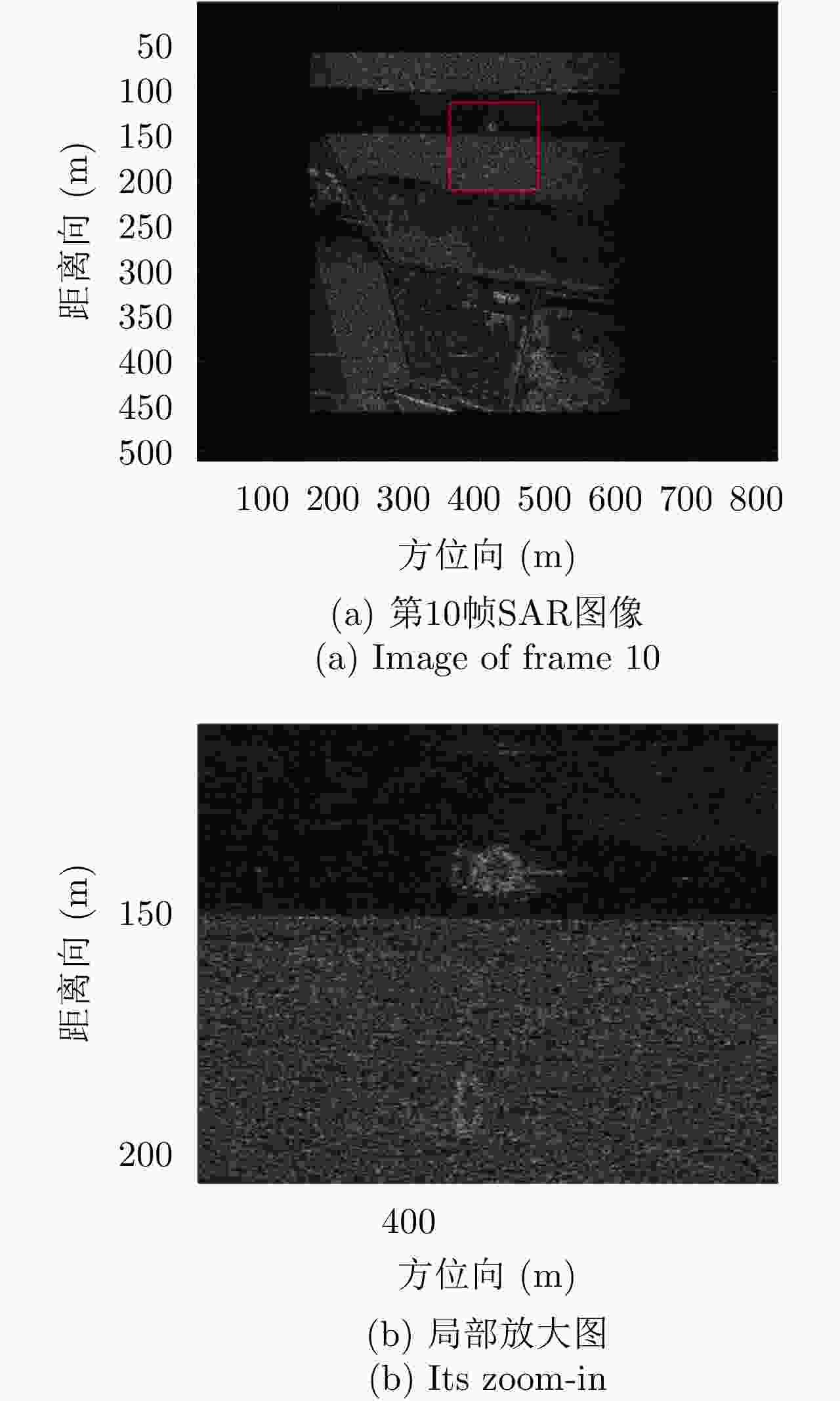

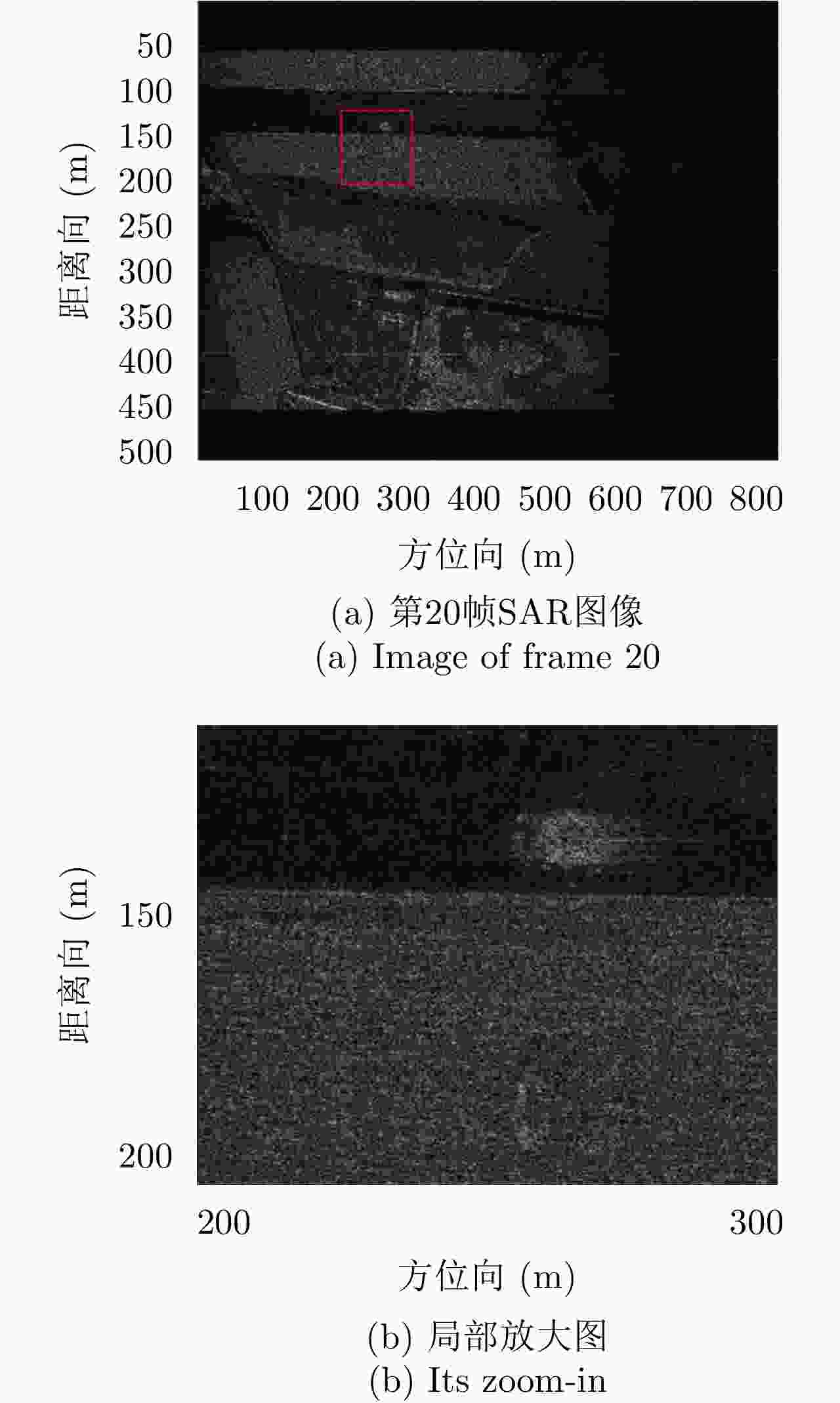

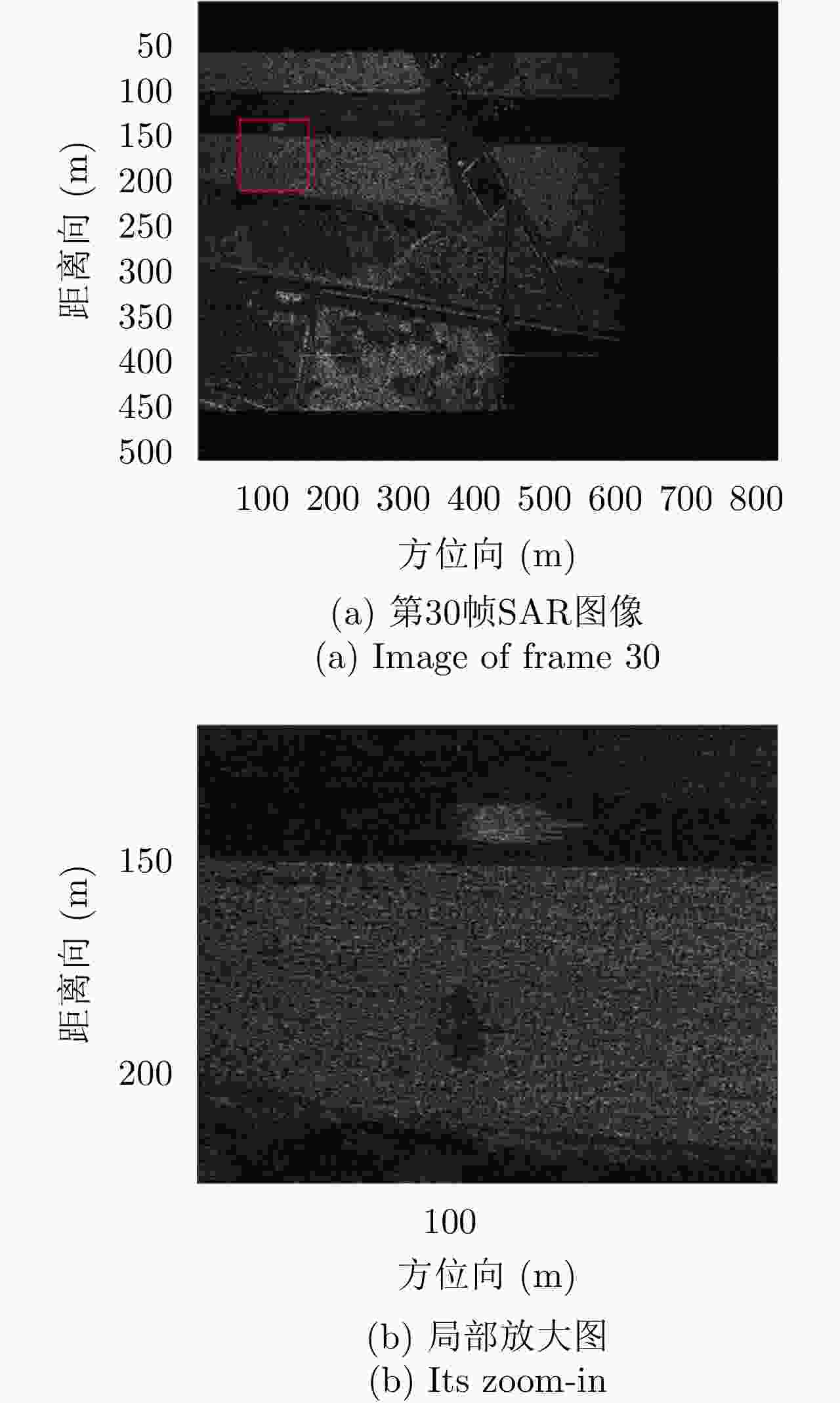

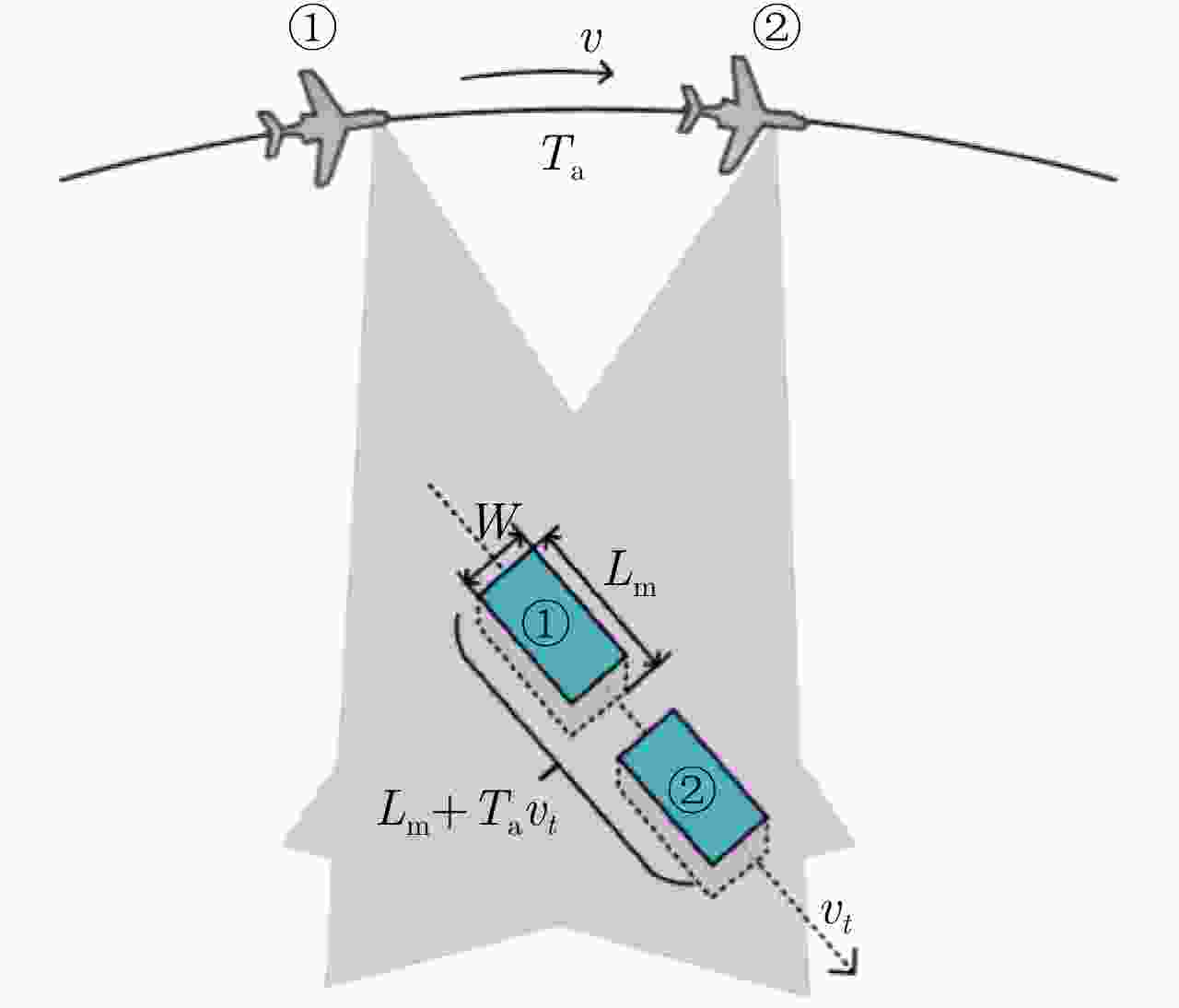

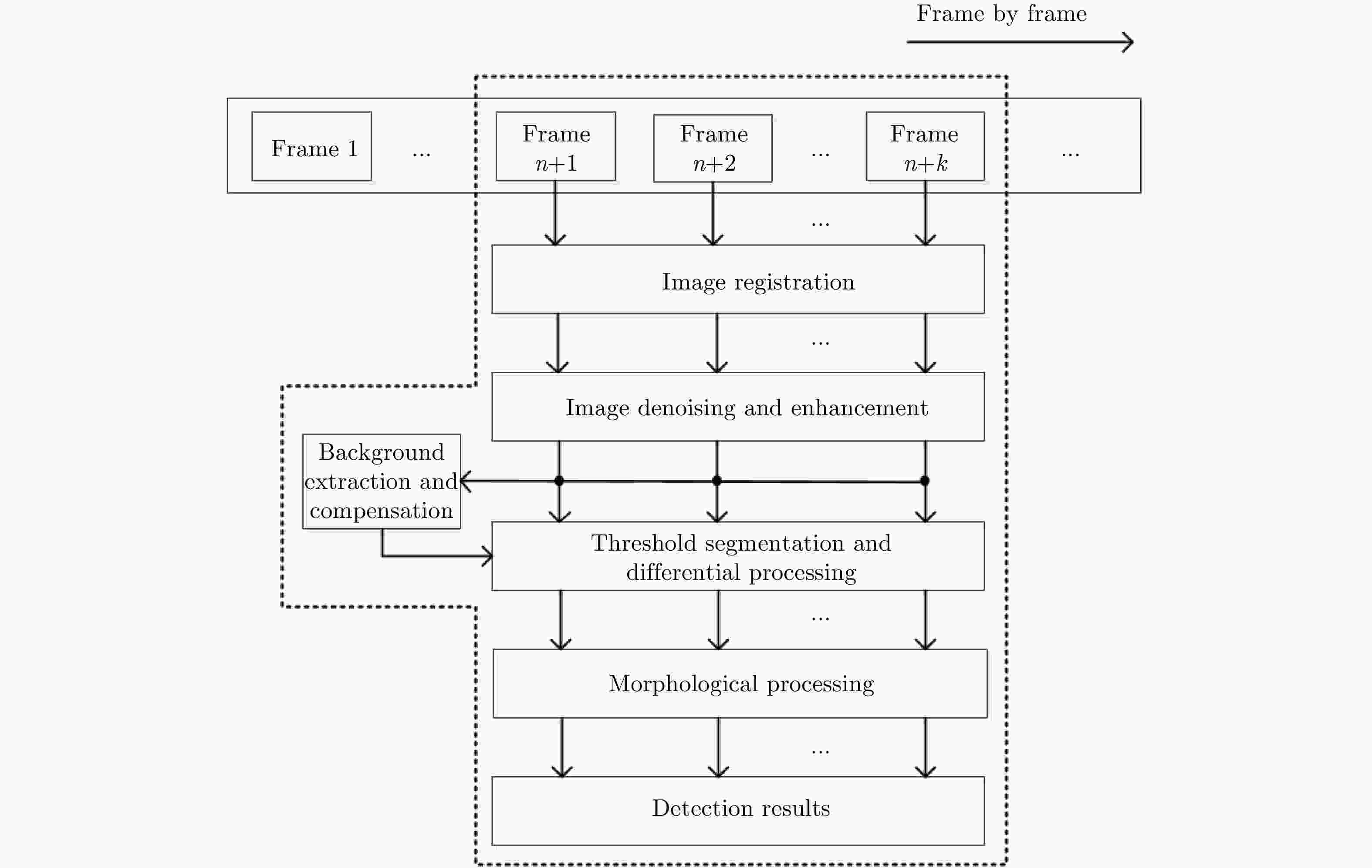

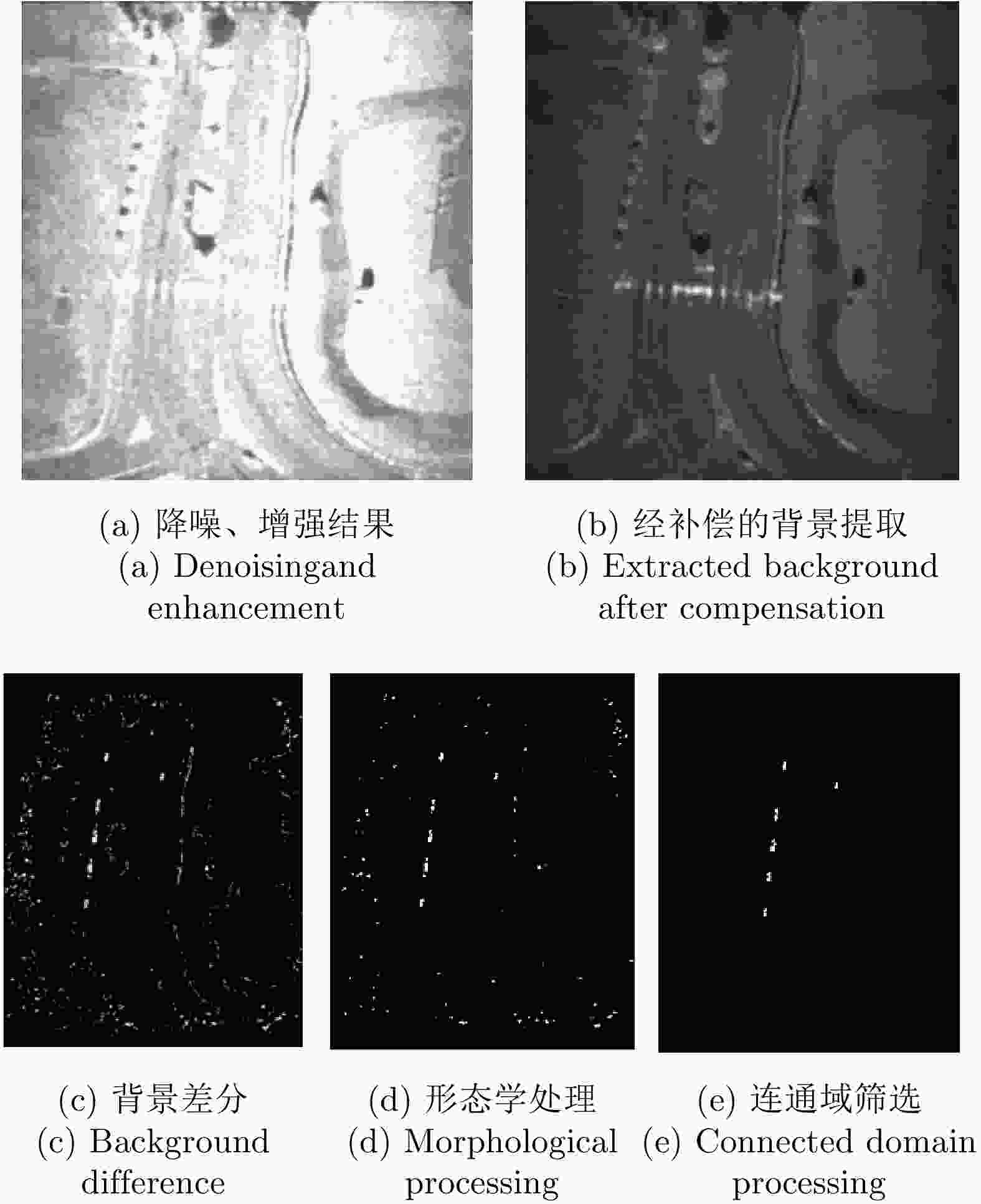

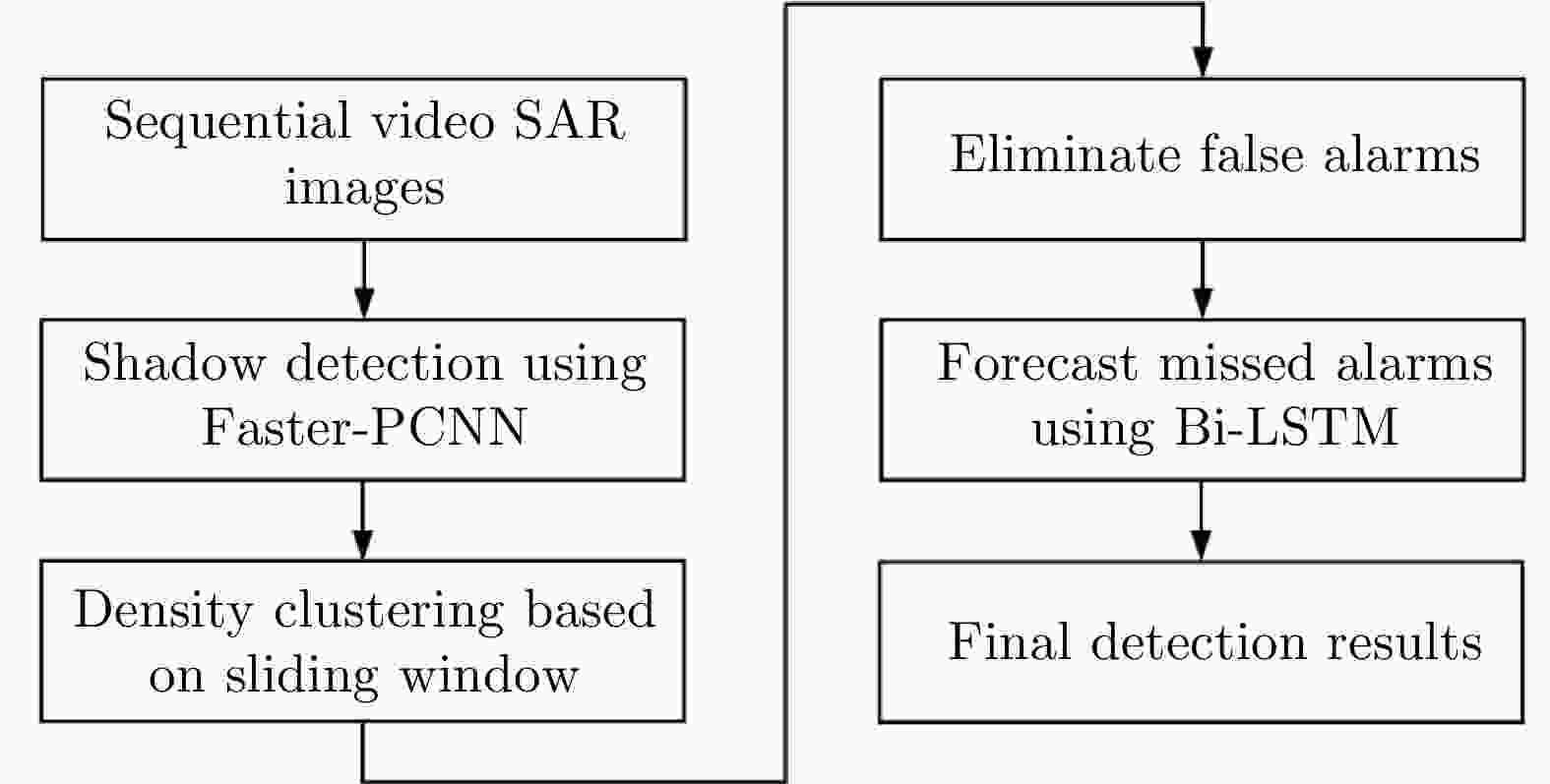

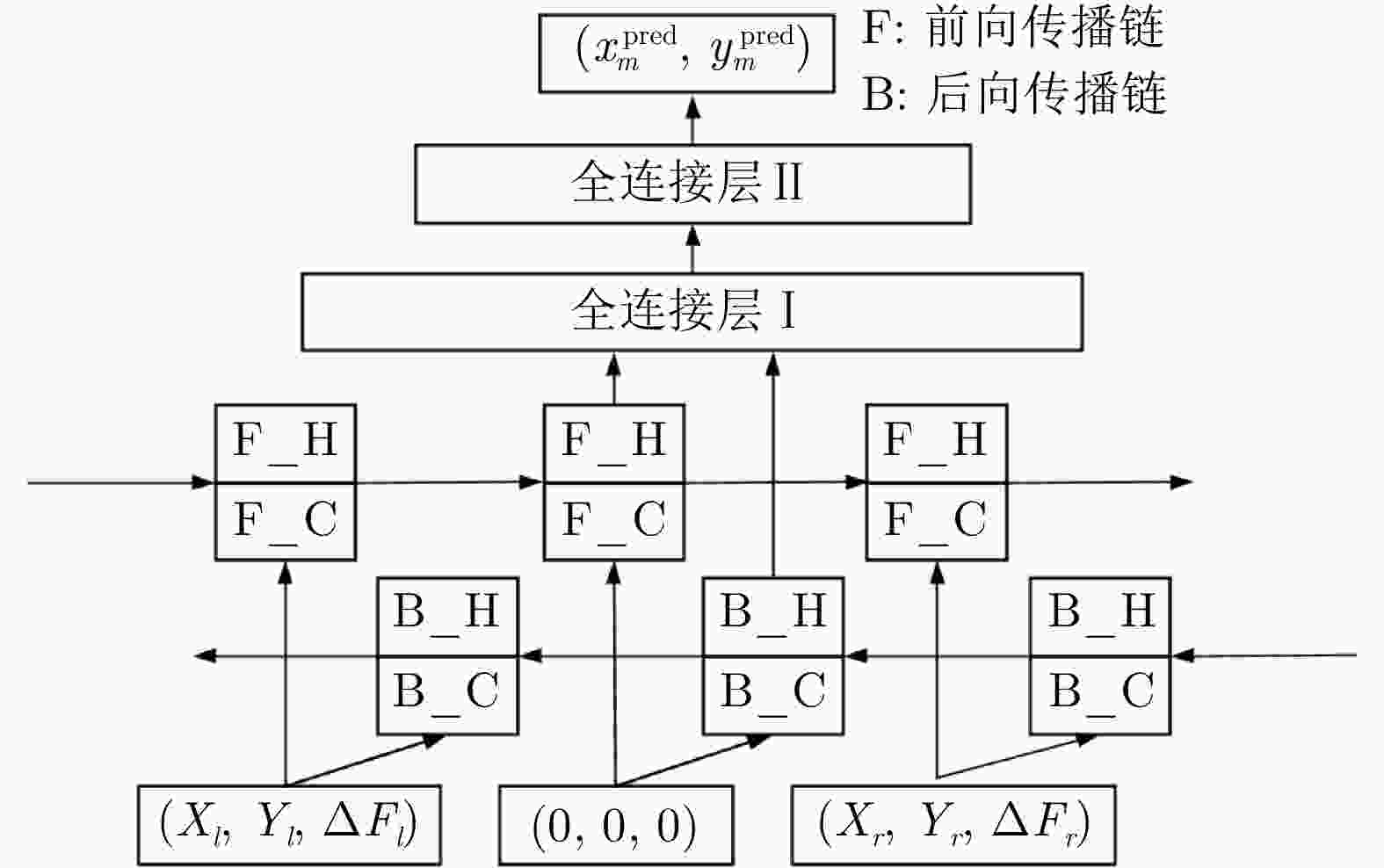

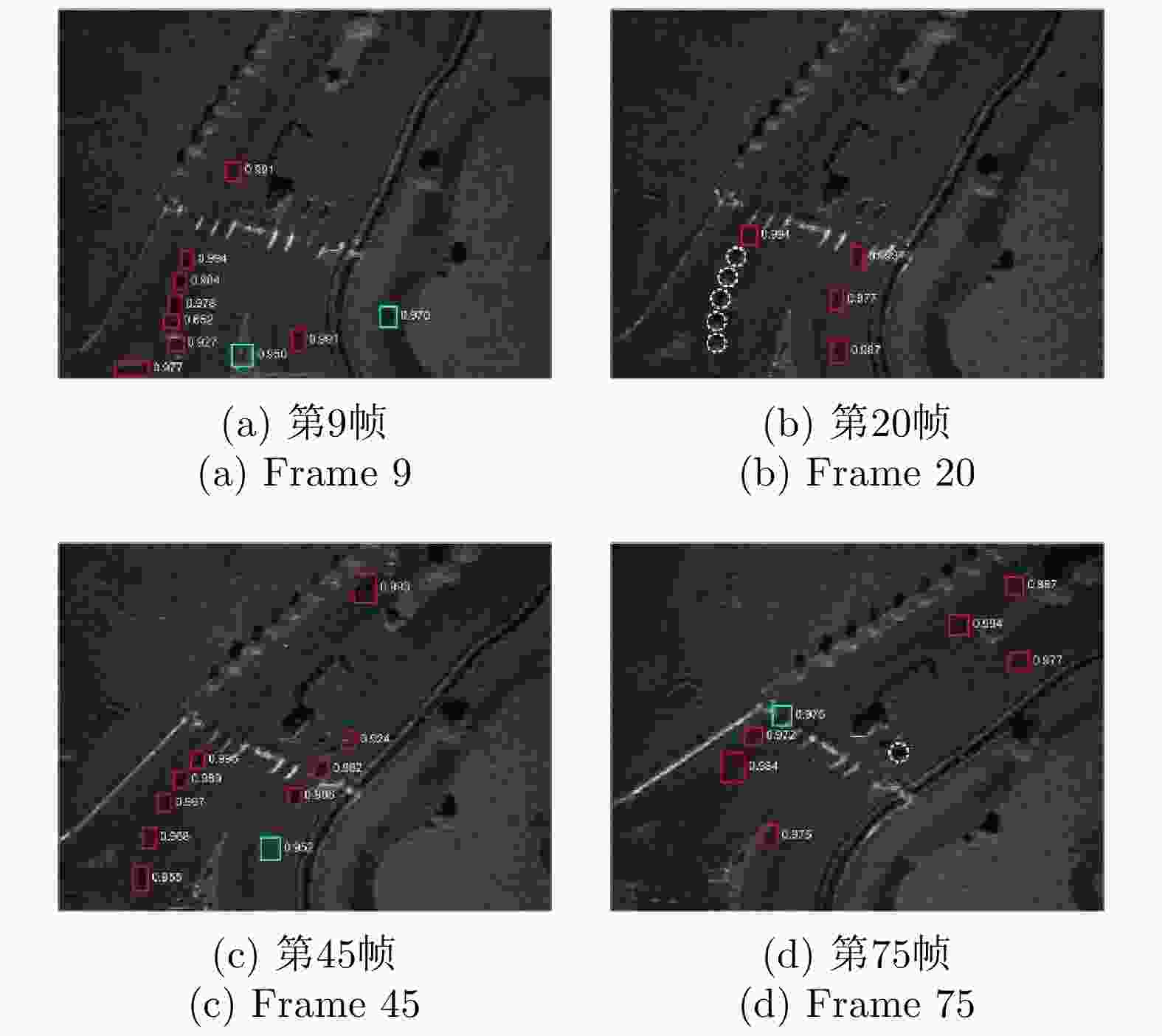

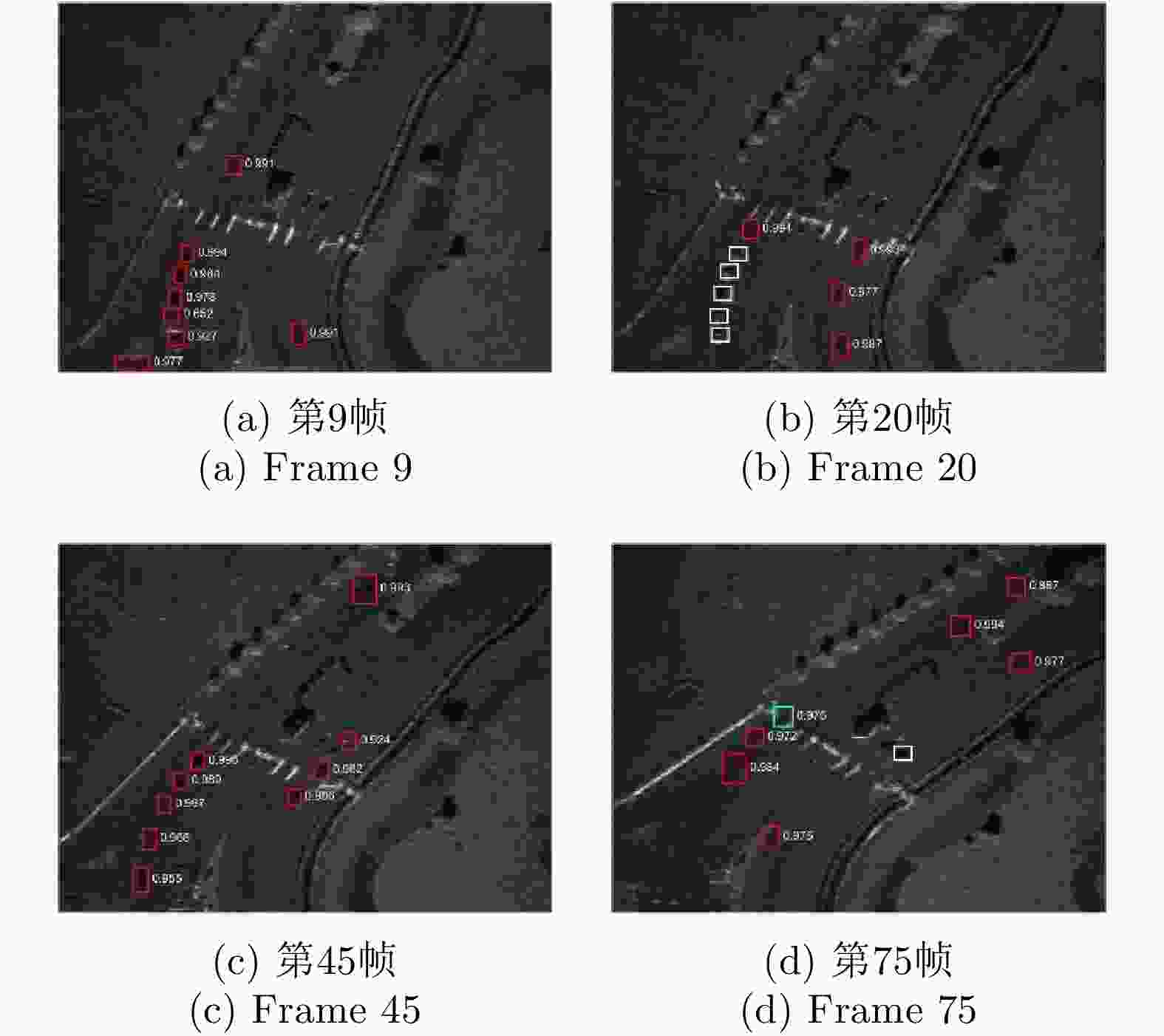

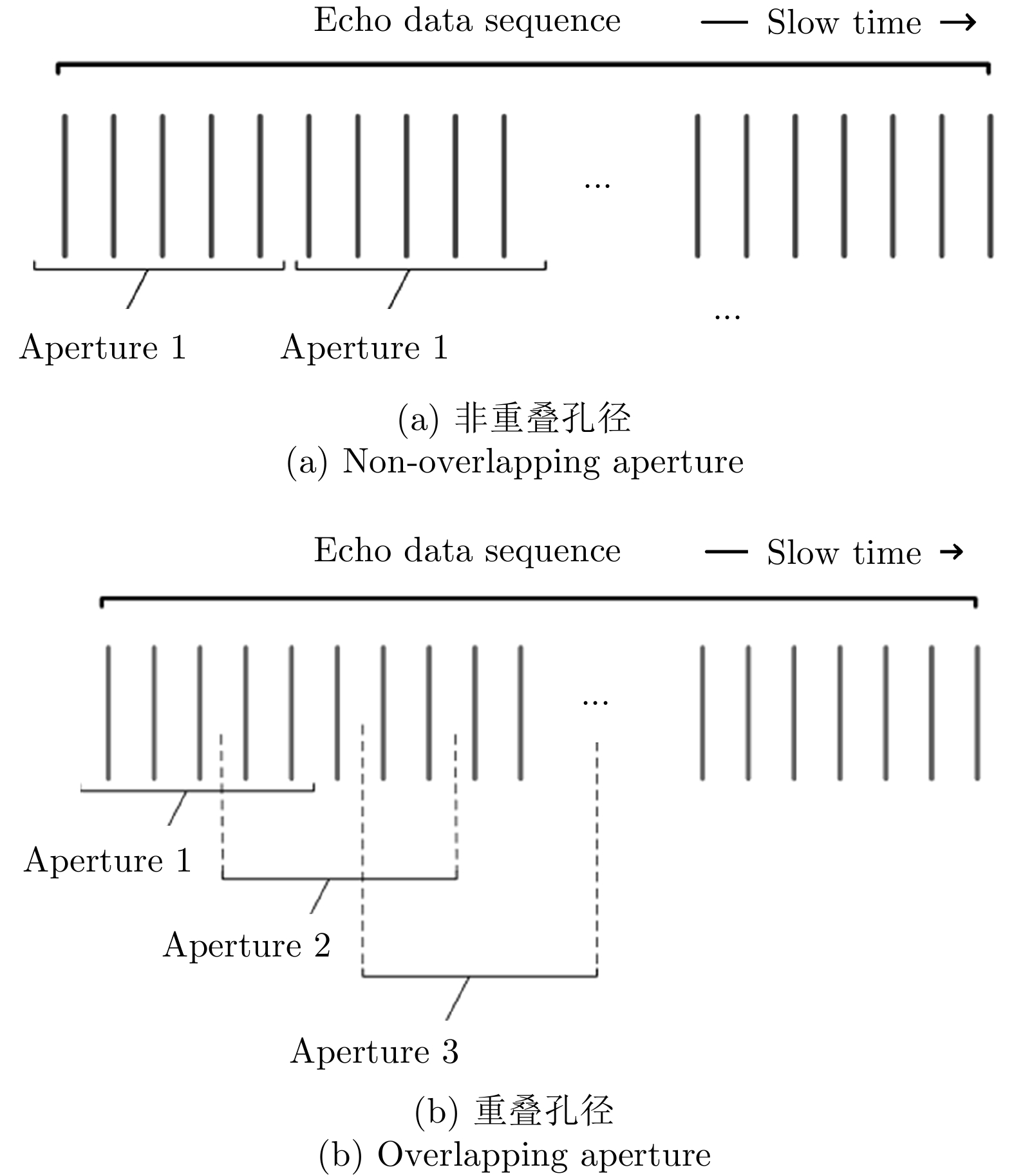

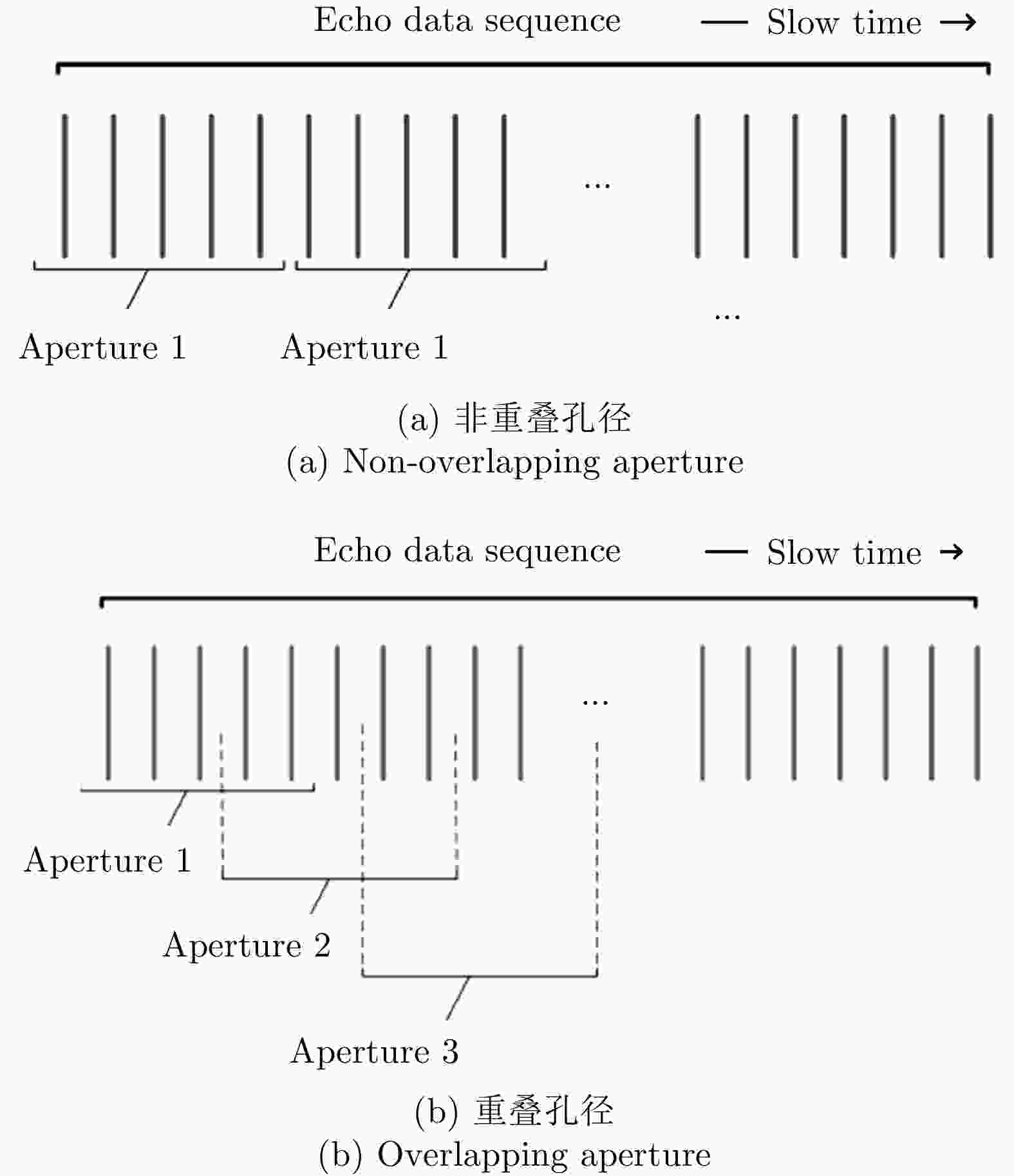

摘要: 视频合成孔径雷达(SAR)技术将观测场景的动态信息以视频方式呈现出来,其高帧率成像特性有利于实现对地面机动目标的实时探测。视频SAR信号处理关键技术主要包括高帧率成像处理算法和运动目标检测技术等。该文对视频SAR成像处理进行了探讨,给出了两种典型视频SAR成像处理仿真数据结果,详细分析了视频SAR阴影形成机理和对动目标检测性能的影响,并将基于机器学习的视频SAR阴影目标检测技术与经典处理方法在实际数据上进行了验证对比。Abstract: Video Synthetic Aperture Radar (SAR) provides dynamic information about an observation scene in a video to the human eye, which can be very useful for the real-time detection of the ground maneuvering targets. The focusing of video SAR data is demanding because of its high data rate. In this study, we discuss suitable focusing algorithms and presents the obtained simulation results. Further, the shadow formation mechanism is analyzed with respect to target detection. Finally, the machine learning algorithm used for detecting the shadows of the moving targets is compared with the classical image processing methods that use real datasets.

-

Key words:

- Video SAR /

- High frame rate imaging /

- Moving target detection /

- Radar imaging /

- Shadow detection

-

表 1 仿真参数

Table 1. Simulation parameters

参数名称 数值 单位 雷达载频 $17.6$ ${\rm{GHz}}$ 调频率 $1.5 \times {10^{13}}$ ${\rm{Hz/s}}$ 采样率 $5 \times {10^7}$ ${\rm{Hz}}$ 脉冲重复频率 $1000$ ${\rm{Hz}}$ 脉冲宽度 $4.096 \times {10^{ - 5}}$ ${\rm{s}}$ 载机速度 $180$ ${\rm{m/s}}$ 场景中心斜距 $10000$ ${\rm{m}}$ 载机高度 $6000$ ${\rm{m}}$ 成像擦地角 $36.8$ ° 天线电尺寸 $0.4$ ${\rm{m}}$ 成像帧率 $10$ ${\rm{Hz}}$ 表 2 基于背景差分的阴影检测性能统计

Table 2. Statistical results of shadow detection based on background difference

目标总数 正确检测的目标 虚警目标 漏警目标 730 658 77 72 表 3 基于实测视频SAR数据的检测性能对比(目标总数:730)

Table 3. Comparisons of detection performance on the real video sar data (Target number: 730)

方法 正确检测的目标 虚警目标 漏警目标 基于背景差分的阴影检测方法 658 77 72 Faster-RCNN 607 73 123 Faster-RCNN+滑窗密度聚类 606 9 124 Faster-RCNN+滑窗密度聚类+Bi-LSTM 723 9 7 -

[1] DAMINI A, BALAJI B, PARRY C, et al. A videoSAR mode for the x-band wideband experimental airborne radar[C]. The SPIE 7699, Algorithms for Synthetic Aperture Radar Imagery XVⅡ, Orlando, USA, 2010: 76990E. doi: 10.1117/12.855376. [2] WALLACE H B. Development of a video SAR for FMV through clouds[C]. The SPIE 9479, Open Architecture/Open Business Model Net-Centric Systems and Defense Transformation 2015, Baltimore, USA, 2015: 94790L. doi: 10.1117/12.2181420. [3] KIM S H, FAN R, and DOMINSKI F. Visar: A 235 Ghz radar for airborne applications[C]. 2018 IEEE Radar Conference, Oklahoma City, USA, 2018: 1549–1554. [4] PALM S, SOMMER R, JANSSEN D, et al. Airborne circular w-band SAR for multiple aspect urban site monitoring[J]. IEEE Transactions on Geoscience and Remote Sensing, 2019, 57(9): 6996–7016. doi: 10.1109/TGRS.2019.2909949 [5] ICEYE. ICEYE demonstrates SAR video capability from current SAR satellite constellation[EB/OL]. https://www.iceye.com/press/press-releases/iceye-demonstrates-sar-video-capability-from-current-sar-satellite-constellation, 2020. [6] BIELEK T P, THOMPSON D G, and WALKER B C. Synthetic aperture design for increased SAR image Rate[P]. US, 7498968, 2009. [7] WELLS L, SORENSEN K, DOERRY A, et al. Developments in SAR and IFSAR systems and technologies at Sandia National Laboratories[C]. 2003 IEEE Aerospace Conference Proceedings, Big Sky, USA, 2003: 2_1085–2_1095. doi: 10.1109/AERO.2003.1235522. [8] 赵雨露, 张群英, 李超, 等. 视频合成孔径雷达振动误差分析及补偿方案研究[J]. 雷达学报, 2015, 4(2): 230–239. doi: 10.12000/JR14153ZHAO Yulu, ZHANG Qunying, LI Chao, et al. Vibration error analysis and motion compensation of video synthetic aperture radar[J]. Journal of Radars, 2015, 4(2): 230–239. doi: 10.12000/JR14153 [9] 孙伟, 孙进平, 张远, 等. 大斜视直升机载太赫兹ViSAR振动补偿成像算法[J]. 北京航空航天大学学报, 2016, 42(12): 2755–2761. doi: 10.13700/j.bh.1001-5965.2015.0862SUN Wei, SUN Jinping, ZHANG Yuan, et al. High squint helicopter-borne terahertz ViSAR vibration compensation imaging algorithm[J]. Journal of Beijing University of Aeronautics and Astronautics, 2016, 42(12): 2755–2761. doi: 10.13700/j.bh.1001-5965.2015.0862 [10] LINNEHAN R, MILLER J, BISHOP E, et al. An autofocus technique for video-SAR[C]. The SPIE 8746, Algorithms for Synthetic Aperture Radar Imagery XX, Baltimore, USA, 2013: 874608. doi: 10.1117/12.2016430. [11] MARTIN G D, DOERRY A W, and HOLZRICHTER M W. A novel polar format algorithm for SAR images utilizing post azimuth transform interpolation[R]. SAND2005-5510, 2005. [12] ZHU Daiyin, YE Shaohua, and ZHU Zhaoda. Polar format agorithm using chirp scaling for spotlight SAR image formation[J]. IEEE Transactions on Aerospace and Electronic Systems, 2008, 44(4): 1433–1448. doi: 10.1109/TAES.2008.4667720 [13] HAWLEY R W and GARBER W L. Aperture weighting technique for video synthetic aperture radar[C]. The SPIE 8051, Algorithms for Synthetic Aperture Radar Imagery XVⅢ, Orlando, United States, 2011: 805107. doi: 10.1117/12.887648. [14] MOSES R L and ASH J N. Recursive SAR imaging[C]. The SPIE 6970, Algorithms for Synthetic Aperture Radar Imagery XV, Orlando, USA, 2008: 69700P. doi: 10.1117/12.786307. [15] MILLER J, BISHOP E, DOERRY A, et al. Impact of ground mover motion and windowing on stationary and moving shadows in synthetic aperture radar imagery[C]. The SPIE 9475, Algorithms for Synthetic Aperture Radar Imagery XXⅡ, Baltimore, USA, 2015: 94750C. doi: 10.1117/12.2179173. [16] RAYNAL A M, BICKEL D L, and DOERRY A W. Stationary and moving target shadow characteristics in synthetic aperture radar[C]. The SPIE 9077, Radar Sensor Technology XVⅢ, Baltimore, USA, 2014: 90771B. doi: 10.1117/12.2049729. [17] SKOLNIK M I. Radar Handbook[M]. 2nd ed. New York: McGraw-Hill, 1990. [18] 保铮, 邢孟道, 王彤. 雷达成像技术[M]. 电子工业出版社, 2005.BAO Zheng, XING Meng-dao, and WANG Tong. Radar Imaging Technique[M]. Publishing House of Electronics Industry, 2005. [19] OLIVER C and QUEGAN S. Understanding Synthetic Aperture Radar Images[M]. Raleigh: SciTech Publishing, 2004. [20] CARRARA W G, GOODMAN R S, and MAJEWSKI R M. Spotlight Synthetic Aperture Radar: Signal Processing Algorithms[M]. Boston, London: Artech House, 1995. [21] JAHANGIR M. Moving target detection for synthetic aperture radar via shadow detection[C]. 2017 IET International Conference on Radar Systems, Edinburgh, UK, 2007: 1–5. doi: 10.1049/cp:20070659. [22] WANG Hui, CHEN Zhansheng, and ZHENG Shichao. Preliminary research of low-RCS moving target detection based on Ka-band video SAR[J]. IEEE Geoscience and Remote Sensing Letters, 2017, 14(6): 811–815. doi: 10.1109/LGRS.2017.2679755 [23] ZHANG Ying, MAO Xinhua, YAN He, et al. A novel approach to moving targets shadow detection in videoSAR imagery sequence[C]. 2017 IEEE International Geoscience and Remote Sensing Symposium, Fort Worth, USA, 2017: 606–609. doi: 10.1109/IGARSS.2017.8127026. [24] XU Huajian, YANG Zhiwei, TIAN Min, et al. An extended moving target detection approach for high-resolution multichannel SAR-GMTI systems based on enhanced shadow-aided decision[J]. IEEE Transactions on Geoscience and Remote Sensing, 2018, 56(2): 715–729. doi: 10.1109/TGRS.2017.2754098 [25] RAYNAL A M, DOERRY A W, MILLER J A, et al. Shadow probability of detection and false alarm for median-filtered SAR imagery[R]. SAND2014-4877, 2014. [26] GIRSHICK R, DONAHUE J, DARRELL T, et al. Rich feature hierarchies for accurate object detection and semantic segmentation[C]. 2014 IEEE Conference on Computer Vision and Pattern Recognition, Columbus, USA, 2014: 580–587. doi: 10.1109/CVPR.2014.81. [27] REN Shaoqing, HE Kaiming, GIRSHICK R, et al. Faster R-CNN: Towards real-time object detection with region proposal networks[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2017, 39(6): 1137–1149. doi: 10.1109/TPAMI.2016.2577031 [28] LI Jianwei, QU Changwen, and SHAO Jiaqi. Ship detection in SAR images based on an improved faster R-CNN[C]. 2017 SAR in Big Data Era: Models, Methods and Applications, Beijing, China, 2017: 1–6. doi: 10.1109/BIGSARDATA.2017.8124934. [29] 胡炎, 单子力, 高峰. 基于Faster-RCNN和多分辨率SAR的海上舰船目标检测[J]. 无线电工程, 2018, 48(2): 96–100. doi: 10.3969/j.issn.1003-3106.2018.02.04HU Yan, SHAN Zili, and GAO Feng. Ship detection based on faster-RCNN and multiresolution SAR[J]. Radio Engineering, 2018, 48(2): 96–100. doi: 10.3969/j.issn.1003-3106.2018.02.04 [30] ESTER M, KRIEGEL H P, SANDER J, et al. A density-based algorithm for discovering clusters in large spatial databases with noise[C]. The Second International Conference on Knowledge Discovery and Data Mining, Portland, USA, 1996: 226–231. [31] GERS F A, SCHMIDHUBER J, and CUMMINS F. Learning to forget: Continual prediction with LSTM[C]. The 1999 Ninth International Conference on Artificial Neural Networks, Edinburgh, UK, 1999: 850–855. doi: 10.1049/cp:19991218. -

作者中心

作者中心 专家审稿

专家审稿 责编办公

责编办公 编辑办公

编辑办公

下载:

下载: