| [1] |

ROBINSON P N. Synthetic array radar[J]. IEEE Potentials, 1997, 16(1): 8–11. doi: 10.1109/45.565604. |

| [2] |

YANG Jianyu. Bistatic synthetic aperture radar technology[J]. Journal of University of Electronic Science and Technology of China, 2016, 45(4): 482–501. doi: 10.3969/j.issn.1001-0548.2016.04.001. |

| [3] |

WILDEN H and BRENNER A R. The SAR/GMTI airborne radar PAMIR: Technology and performance[C]. IEEE MTT-S International Microwave Symposium, Anaheim, USA, 2010: 534–537. doi: 10.1109/MWSYM.2010.5518080. |

| [4] |

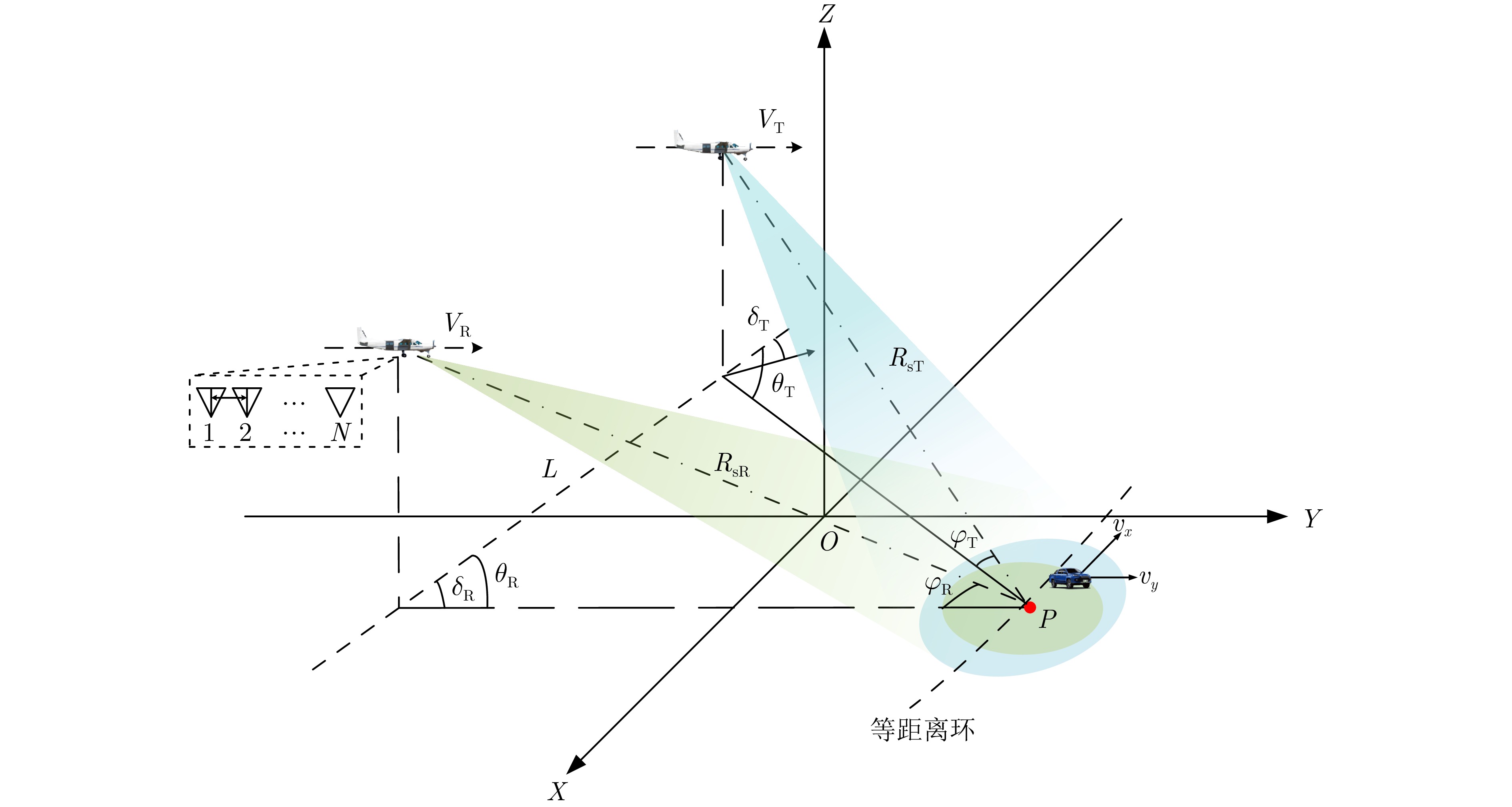

LI Zhongyu, WU Junjie, HUANG Yulin, et al. Ground-moving target imaging and velocity estimation based on mismatched compression for bistatic forward-looking SAR[J]. IEEE Transactions on Geoscience and Remote Sensing, 2016, 54(6): 3277–3291. doi: 10.1109/TGRS.2016.2514494. |

| [5] |

LI Junao, LI Zhongyu, YANG Qing, et al. Joint clutter suppression and moving target indication in 2-D azimuth rotated time domain for single-channel bistatic SAR[J]. IEEE Transactions on Geoscience and Remote Sensing, 2023, 61: 5202516. doi: 10.1109/TGRS.2023.3237553. |

| [6] |

LI Zhongyu, WU Junjie, YANG Jianyu, et al. Bistatic SAR Clutter Suppression[M]. Singapore: Springer, 2022: 8–19. doi: 10.1007/978-981-19-0159-1. |

| [7] |

李中余. 双基地合成孔径雷达动目标检测与成像技术研究[D]. [博士论文], 电子科技大学, 2017: 11–59.

LI Zhongyu. Research on bistatic SAR moving target detection and imaging technology[D]. [Ph.D. dissertation], University of Electronic Science and Technology of China, 2017: 11–59.

|

| [8] |

CHEN H C and MCGILLEM C D. Target motion compensation by spectrum shifting in synthetic aperture radar[J]. IEEE Transactions on Aerospace and Electronic Systems, 1992, 28(3): 895–901. doi: 10.1109/7.256313. |

| [9] |

FIENUP J R. Detecting moving targets in SAR imagery by focusing[J]. IEEE Transactions on Aerospace and Electronic Systems, 2001, 37(3): 794–809. doi: 10.1109/7.953237. |

| [10] |

MOREIRA J R and KEYDEL W. A new MTI-SAR approach using the reflectivity displacement method[J]. IEEE Transactions on Geoscience and Remote Sensing, 1995, 33(5): 1238–1244. doi: 10.1109/36.469488. |

| [11] |

LIGHTSTONE L, FAUBERT D, and REMPEL G. Multiple phase centre DPCA for airborne radar[C]. IEEE National Radar Conference, Los Angeles, USA, 1991: 36–40. doi: 10.1109/NRC.1991.114720. |

| [12] |

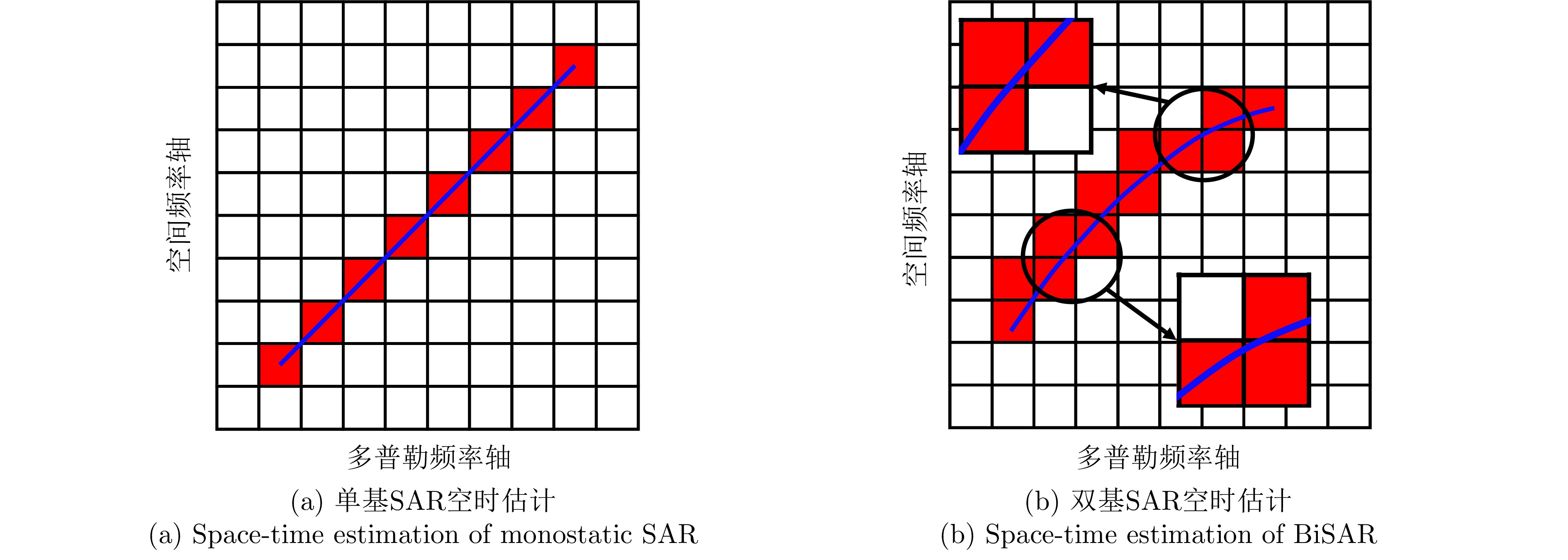

LI Zhongyu, LI Shanchuan, LIU Zhutian, et al. Bistatic forward-looking SAR MP-DPCA method for space-time extension clutter suppression[J]. IEEE Transactions on Geoscience and Remote Sensing, 2020, 58(9): 6565–6579. doi: 10.1109/TGRS.2020.2977982. |

| [13] |

谢文冲, 段克清, 王永良. 机载雷达空时自适应处理技术研究综述[J]. 雷达学报, 2017, 6(6): 575–586. doi: 10.12000/JR17073. XIE Wenchong, DUAN Keqing, and WANG Yongliang. Space time adaptive processing technique for airborne radar: An overview of its development and prospects[J]. Journal of Radars, 2017, 6(6): 575–586. doi: 10.12000/JR17073. |

| [14] |

REED I S, MALLETT J D, and BRENNAN L E. Rapid convergence rate in adaptive arrays[J]. IEEE Transactions on Aerospace and Electronic Systems, 1974, AES-10(6): 853–863. doi: 10.1109/TAES.1974.307893. |

| [15] |

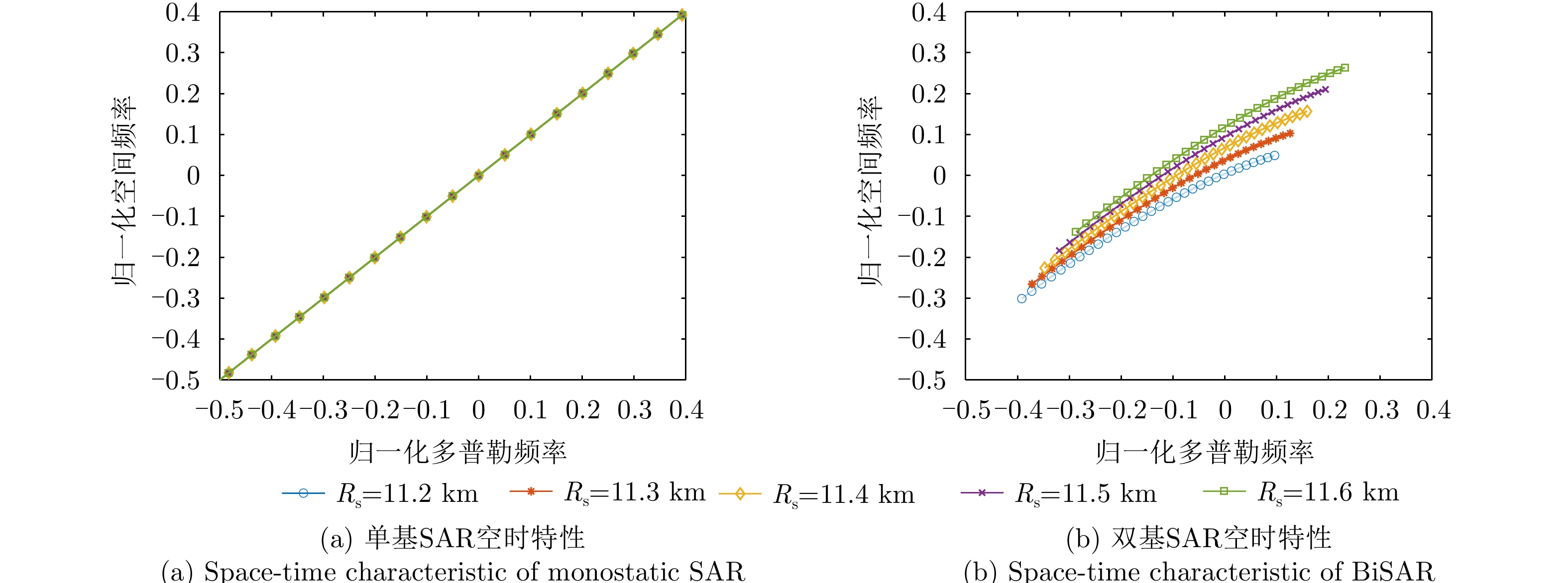

KLEMM R. Comparison between monostatic and bistatic antenna configurations for STAP[J]. IEEE Transactions on Aerospace and Electronic Systems, 2000, 36(2): 596–608. doi: 10.1109/7.845248. |

| [16] |

LIU Zhutian, YU Huaiqin, LI Zhongyu, et al. Non-stationary clutter suppression approach based on cascading cancellation for bistatic forward-looking SAR[C]. 2019 IEEE Radar Conference, Boston, USA, 2019: 1–5. doi: 10.1109/RADAR.2019.8835707. |

| [17] |

LI Junao, LI Zhongyu, YANG Qing, et al. Efficient matrix sparse recovery STAP method based on Kronecker transform for BiSAR sea clutter suppression[J]. IEEE Transactions on Geoscience and Remote Sensing, 2024, 62: 5103218. doi: 10.1109/TGRS.2024.3362844. |

| [18] |

MA Zeqiang, WANG Xiqin, LIU Yimin, et al. An overview on sparse recovery-based STAP[J]. Journal of Radars, 2014, 3(2): 217–228. doi: 10.3724/SP.J.1300.2014.14002. |

| [19] |

SUN Ke, ZHANG Hao, LI Gang, et al. A novel STAP algorithm using sparse recovery technique[C]. 2009 IEEE International Geoscience and Remote Sensing Symposium, Cape Town, South Africa, 2009: V-336–V-339. doi: 10.1109/IGARSS.2009.5417664. |

| [20] |

TANG Gongguo, BHASKAR B N, SHAH P, et al. Compressed sensing off the grid[J]. IEEE Transactions on Information Theory, 2013, 59(11): 7465–7490. doi: 10.1109/TIT.2013.2277451. |

| [21] |

YE Hongda, LI Zhongyu, LIU Zhutian, et al. Clutter-ridge matched SR-STAP technique for non-stationary clutter suppression[C]. 2020 IEEE Radar Conference, Florence, Italy, 2020: 1–4. doi: 10.1109/RadarConf2043947.2020.9266628. |

| [22] |

DUAN Keqing, LIU Weijian, DUAN Guangqing, et al. Off-grid effects mitigation exploiting knowledge of the clutter ridge for sparse recovery STAP[J]. IET Radar, Sonar & Navigation, 2018, 12(5): 557–564. doi: 10.1049/iet-rsn.2017.0425. |

| [23] |

LI Zhihui, ZHANG Yongshun, GE Qichao, et al. Off-grid STAP algorithm based on reduced-dimension local search orthogonal matching pursuit[C]. 2019 IEEE 4th International Conference on Signal and Image Processing, Wuxi, China, 2019: 187–191. doi: 10.1109/SIPROCESS.2019.8868509. |

| [24] |

DUAN Keqing, WANG Zetao, XIE Wenchong, et al. A space-time adaptive processing algorithm based on joint sparse recovery[J]. Journal of Radars, 2014, 3(2): 229–234. doi: 10.3724/SP.J.1300.2014.13149. |

| [25] |

HE Pengyuan, HE Shun, YANG Zhiwei, et al. An off-grid STAP algorithm based on local mesh splitting with bistatic radar system[J]. IEEE Signal Processing Letters, 2020, 27: 1355–1359. doi: 10.1109/LSP.2020.3010161. |

| [26] |

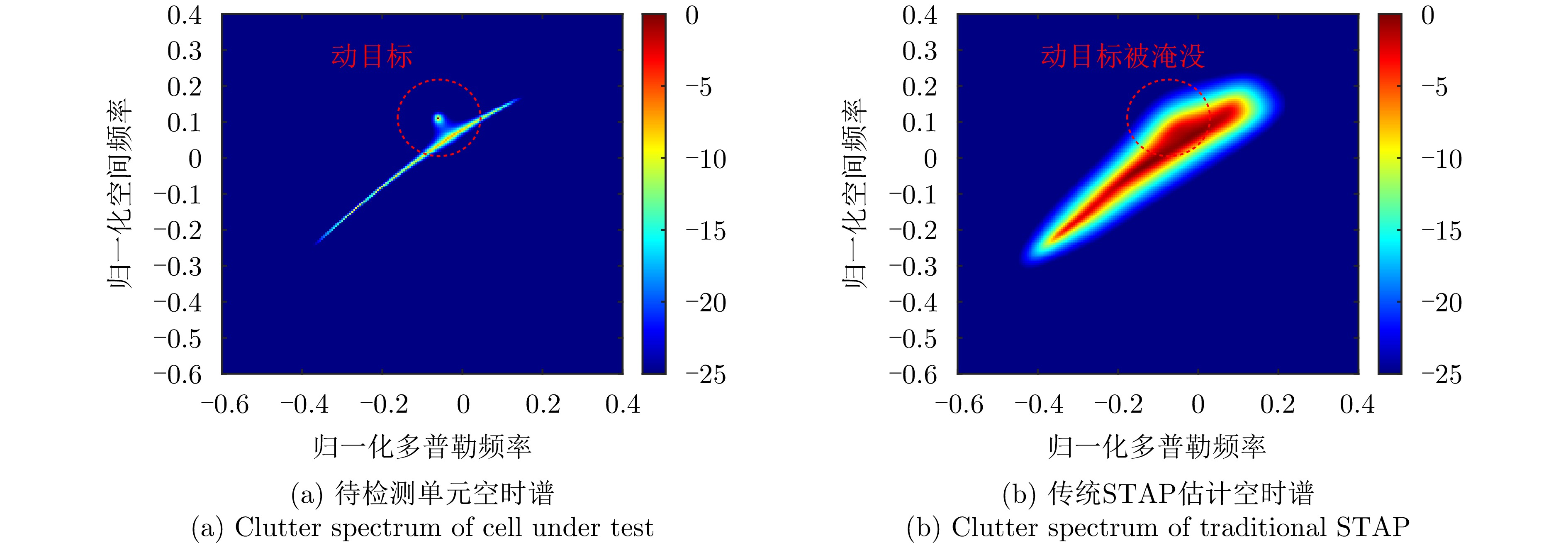

LI Zhongyu, YE Hongda, LIU Zhutian, et al. Bistatic SAR clutter-ridge matched STAP method for nonstationary clutter suppression[J]. IEEE Transactions on Geoscience and Remote Sensing, 2022, 60: 5216914. doi: 10.1109/TGRS.2021.3125043. |

| [27] |

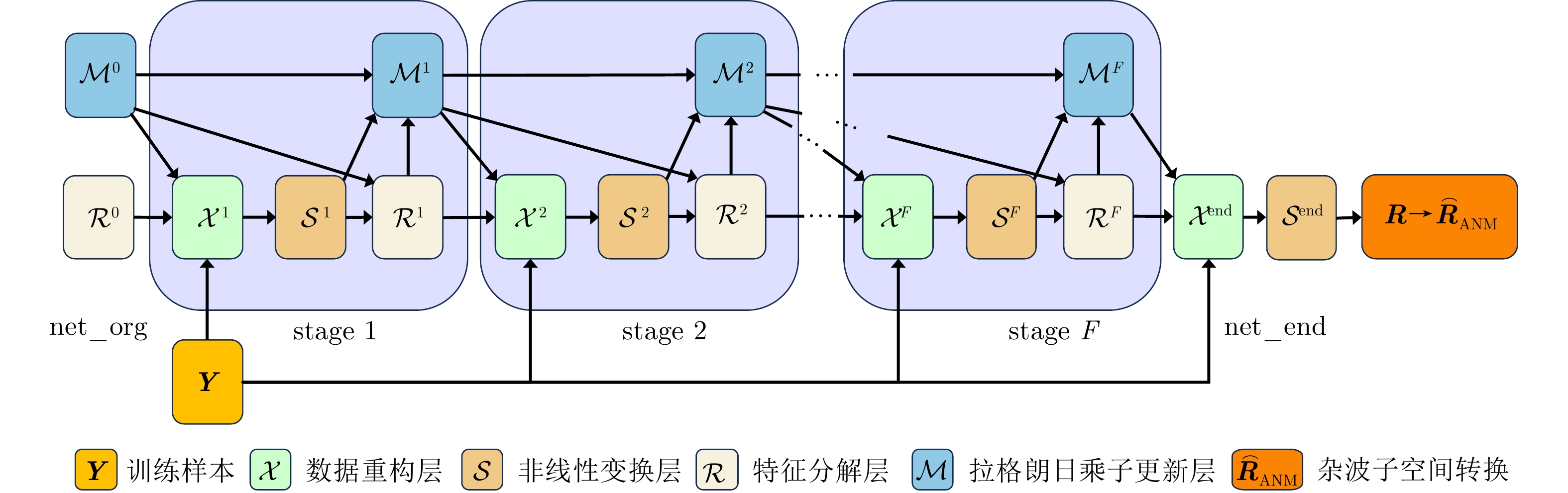

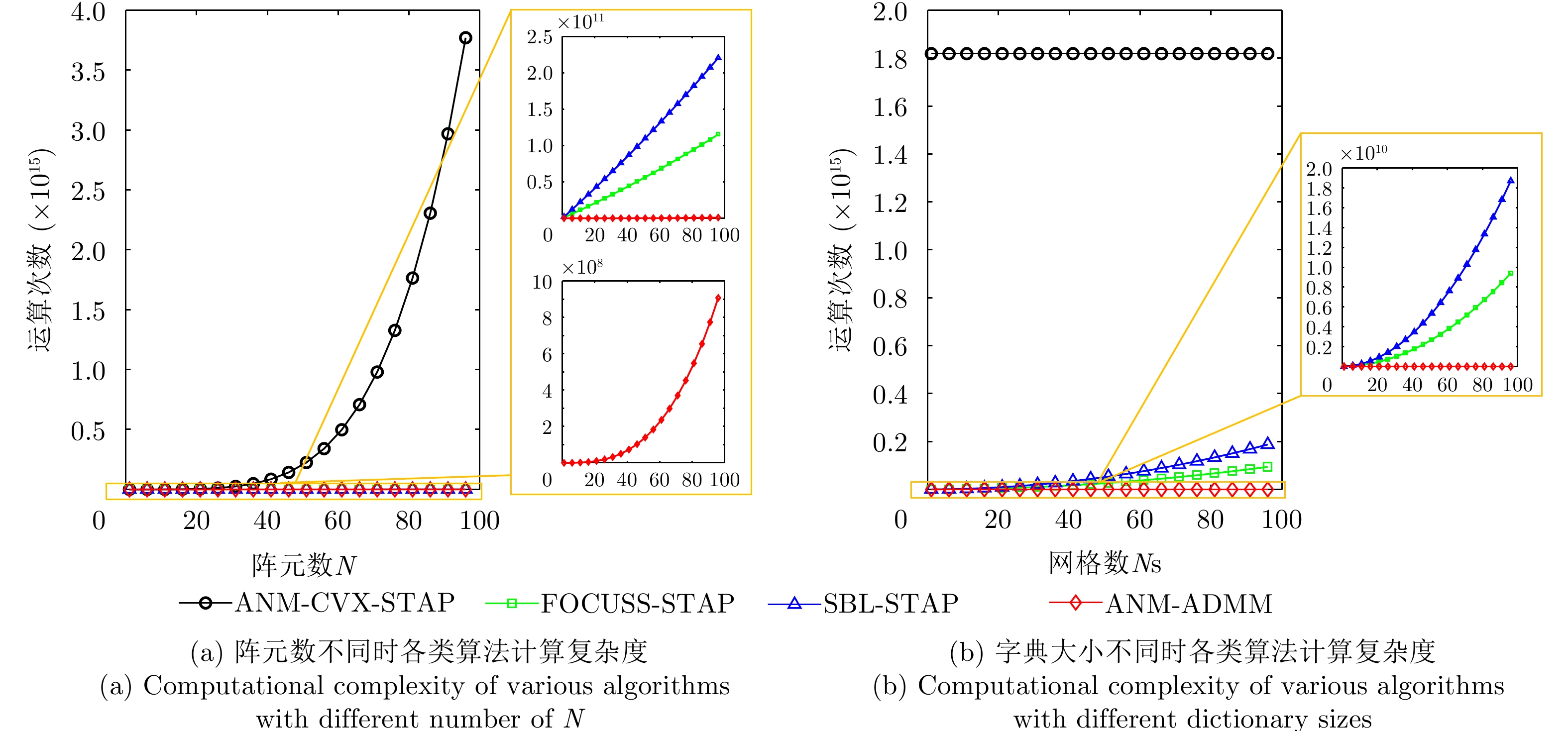

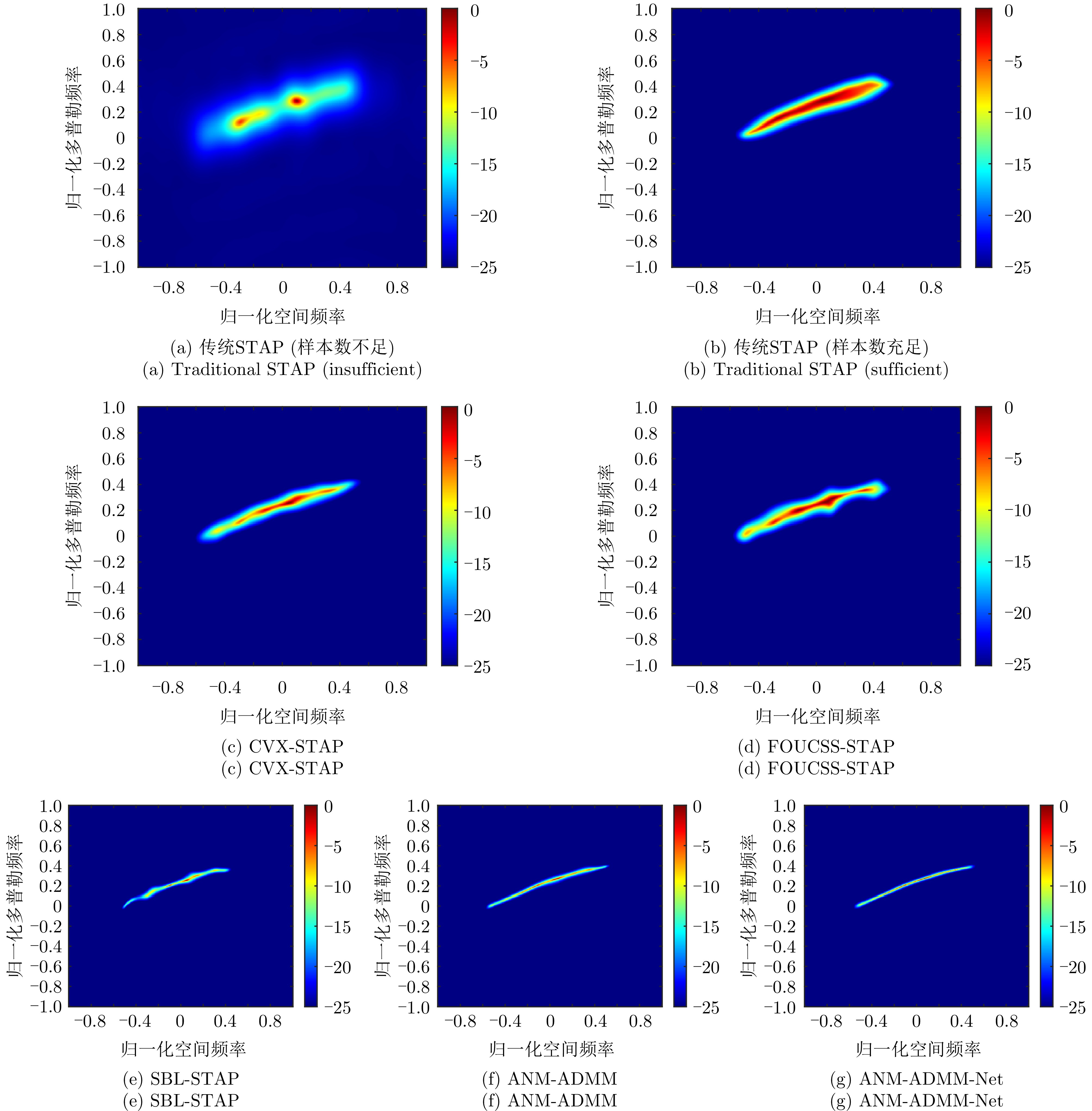

FENG Weike, GUO Yiduo, ZHANG Yongshun, et al. Airborne radar space time adaptive processing based on atomic norm minimization[J]. Signal Processing, 2018, 148: 31–40. doi: 10.1016/j.sigpro.2018.02.008. |

| [28] |

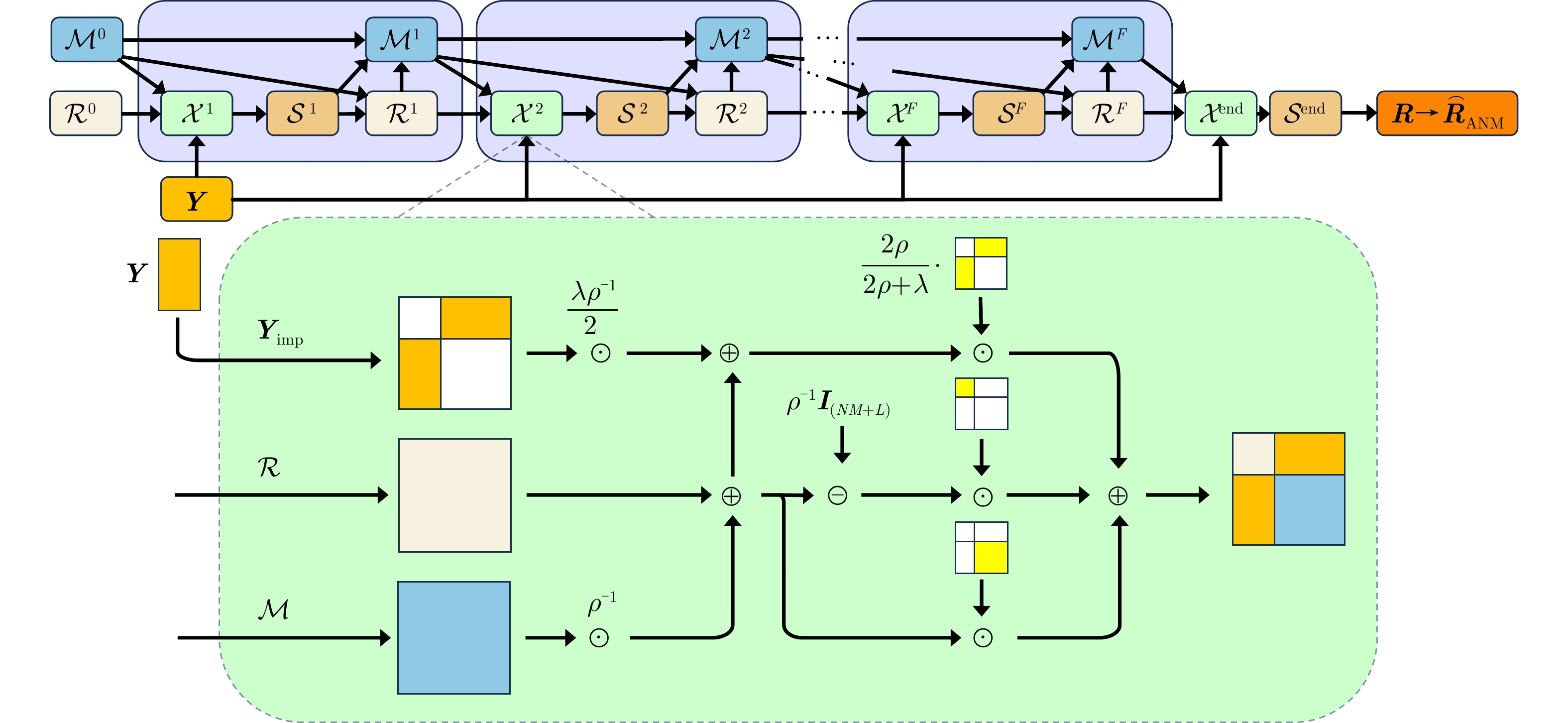

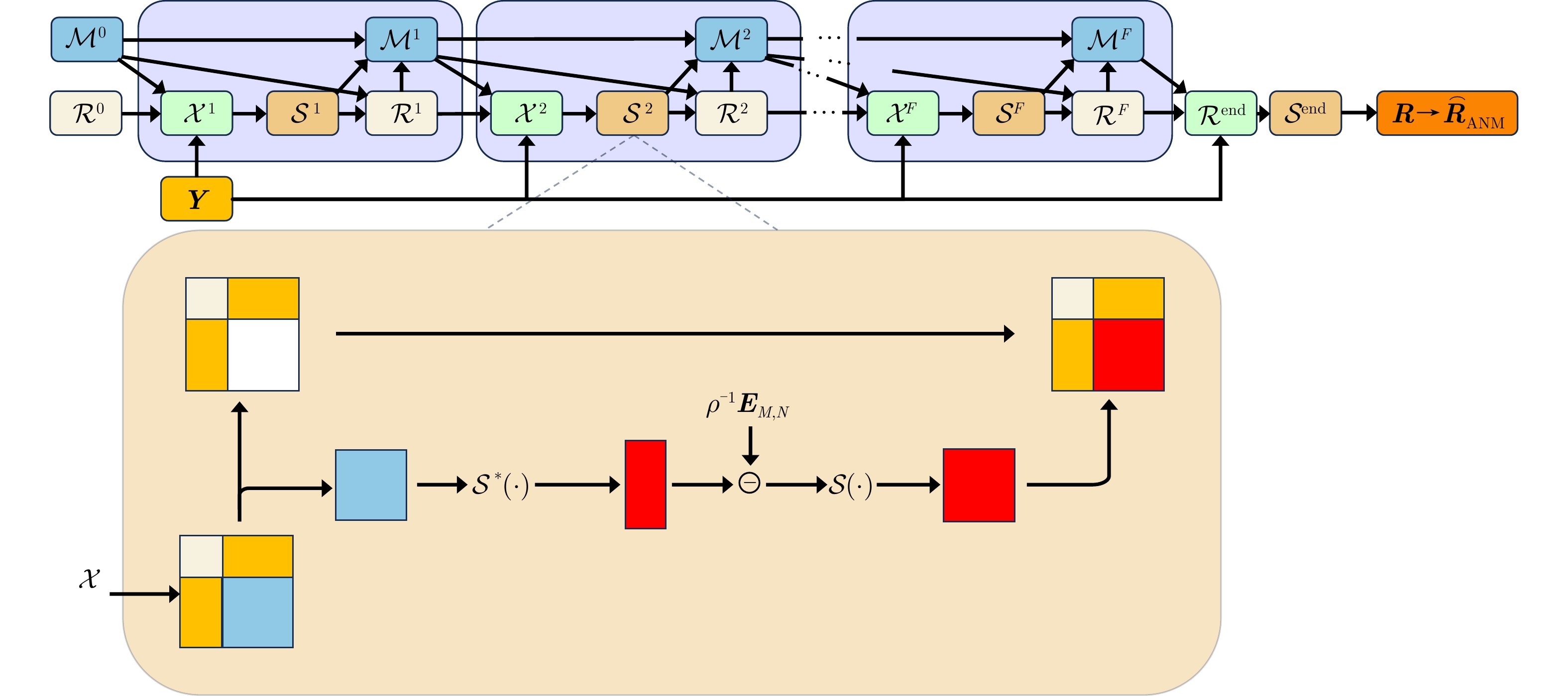

LI Zhongyue and WANG Tong. ADMM-based low-complexity off-grid space-time adaptive processing methods[J]. IEEE Access, 2020, 8: 206646–206658. doi: 10.1109/ACCESS.2020.3037652. |

| [29] |

ZOU Bo, WANG Xin, FENG Weike, et al. DU-CG-STAP method based on sparse recovery and unsupervised learning for airborne radar clutter suppression[J]. Remote Sensing, 2022, 14(14): 3472. doi: 10.3390/rs14143472. |

| [30] |

SU Hanning, BAO Qinglong, and CHEN Zengping. ADMM-net: A deep learning approach for parameter estimation of chirp signals under sub-nyquist sampling[J]. IEEE Access, 2020, 8: 75714–75727. doi: 10.1109/ACCESS.2020.2989507. |

| [31] |

RICHARDS M A. The keystone transformation for correcting range migration in range-doppler processing[J]. Pulse, 2014, 1000(1).

|

| [32] |

LIU Zhutian, LI Zhongyu, YU Huaiqin, et al. Bistatic forward-looking SAR moving target detection method based on joint clutter cancellation in echo-image domain with three receiving channels[J]. Sensors, 2018, 18(11): 3835. doi: 10.3390/s18113835. |

Submit Manuscript

Submit Manuscript Peer Review

Peer Review Editor Work

Editor Work

DownLoad:

DownLoad: