②(江西省机场集团公司九江机场分公司 九江 332000)

②(Jiujiang Airport Branch, Jiangxi Airports Group Company, Jiujiang 332000, China)

近几年稀疏表示理论[1]发展迅速,得到很多学者的广泛关注并被应用到多个领域,如图像编码[2, 3]、图像去噪[4, 5]、人脸识别[6, 7]、SAR图像目标识别[8, 9, 10, 11]等。在SAR图像目标识别方面,文献[8]提出了一种基于主元分析和稀疏表示的SAR图像目标识别算法,该方法首先对样本进行PCA降维,将降维后的样本进行稀疏表示,利用优化算法求得样本的稀疏系数并作为样本特征,最后利用最近邻法对SAR图像目标分类识别,实验结果表明在没有预处理的情况下该算法能有效地识别目标。

最近有学者将稀疏表示理论运用到特征提取中,如QIAO[12]等人提出了稀疏保持投影(Sparsity Preserving Projections,SPP)特征提取方法,该方法可保证在投影空间内的样本与稀疏重构样本误差最小,将该特征提取方法运用到人脸识别中,实验结果证明了该方法的有效性。

本文在SPP方法的基础上借鉴局部保持投影(Locality Preserving Projection,LPP)特征提取方法思想[13],使得提取的特征在保持稀疏重构误差最小的同时使同类样本间距最小,利用该思想构造目标函数,求解特征空间,在特征空间内利用SVM分类器进行分类,采用MSTAR数据对该方法进行验证,实验结果表明,在不利用目标成像方位信息情况下该方法可以有效地提高目标的正确识别率。

2 SPP特征提取方法目标的稀疏系数可描述目标的特征,SPP特征提取方法将每个样本的稀疏系数构成稀疏重构权重矩阵,通过寻找最佳投影向量w,使得原始样本在w上的投影与稀疏重构样本在w上的投影误差最小。

设有样本集$X = \{ {x_{_1}},{x_{_1}},...,{x_N}\} $,其中${x_i} \in {R^{M \times 1}}$,N表示样本总数,i=1,2,$ \cdots $,N。对于每一个样本xi,都存在一个对应的子集${T_i} = \{ {x_1},\cdots ,{x_{i - 1}},{x_{i + 1}},\cdots ,{x_N}\} \in {R^{M \times (N - 1)}}$,通过以下1-范数最小化问题求得每个样本xi的稀疏系数${\alpha _i}$:

| $\left. {\begin{array}{*{20}{l}} {\mathop {\min }\limits_{{\alpha _i}} {{\left\| {{\alpha _i}} \right\|}_1}}\\ {{\rm{s}}.{\rm{t}}.\;{x_i} = {T_i}{\alpha _i}}\\ {1 = {1^{\rm{T}}}{\alpha _i}} \end{array}} \right\}$ | (1) |

式(1)中稀疏系数可以通过以下1-范数优化方法来求解:

| $\left. \begin{array}{l} \begin{array}{*{20}{l}} {\mathop {\min }\limits_{{\alpha _i}} {{\left\| {{\alpha _i}} \right\|}_1}} \end{array}\\ \begin{array}{*{20}{c}} {{\rm{s}}.{\rm{t}}.\;\left\| {{x_i} - {T_i}{\alpha _i}} \right\|\varepsilon }\\ {1 = {1^{\rm{T}}}{\alpha _i}} \end{array} \end{array} \right\}$ | (2) |

式(2)求解稀疏系数的问题又可转化为有约束的2次规划问题,可以利用梯度投影法[14]来求解,其优化函数形式如下:

| $\left. {\begin{array}{*{20}{l}} {\min \{ ||{x_i} - {T_i}{\alpha _i}|{|_2} + \lambda ||{\alpha _i}|{|_1}{\rm{\} }}}\\ {s.t.1 = {1^T}{\alpha _i}} \end{array}} \right\}$ | (3) |

通过式(3)求得每个样本xi在其对应子集Ti上的稀疏系数${\alpha _i}$后,构造稀疏重构权重矩阵$S = {[{s_1},{s_2},\cdots ,{s_N}]^{\rm{T}}} \in {R^{N \times N}}$,其中,${s_i} = [{\alpha _i},1,{\left. { \cdots ,{\alpha _{i,i - 1}},0,{\alpha _{i,i}},\cdots ,{\alpha _{i,N - 1}}} \right]^{\rm{T}}} \in {R^{N \times 1}}$。由于稀疏表示得到的稀疏系数可描述不同目标的特征,因此希望这种特性在低维空间得到保持,故可通过求得投影向量w,使得样本xi在w上的投影与稀疏重构样本在w上的投影误差最小,具体目标函数形式如下:

| $\mathop {\min }\limits_w \sum\limits_{i = 1}^N {||} {w^{\rm{T}}}{x_i} - {w^{\rm{T}}}X{s_i}|{|^2}$ | (4) |

将式(4)整理写成以下形式:

| $\mathop {\min }\limits_w {\rm{tr}}({w^{\rm{T}}}X(I - S - {S^{\rm{T}}} + {S^{\rm{T}}}S){X^{\rm{T}}}w)$ | (5) |

为避免退化解,令${w^{\rm{T}}}X{X^{\rm{T}}}w = 1$,式(5)可以转化成以下优化问题:

| $\mathop {\min }\limits_w \frac{{{w^{\rm{T}}}X(I - S - {S^{\rm{T}}} + {S^{\rm{T}}}S){X^{\rm{T}}}w}}{{{w^{\rm{T}}}X{X^{\rm{T}}}w}}$ | (6) |

式(6)最终转换成求解以下最优化问题:

| $\mathop {\max }\limits_w \frac{{{w^{\rm{T}}}X{S_\beta }{X^{\rm{T}}}w}}{{{w^{\rm{T}}}X{X^{\rm{T}}}w}}$ | (7) |

通过以下特征值分解问题求得投影向量w:

| $X{S_\beta }{\rm{ }}{X^{\rm{T}}}w = \lambda X{X^{\rm{T}}}w$ | (8) |

| ${g_i}({x_i}) = {W^{\rm{T}}}{x_i}$ | (9) |

由于SPP特征提取方法是一种全局降维方法,它通过数据的稀疏重构关系求得投影向量,这种稀疏性自然地捕获了数据的局部结构特性。SAR目标图像对成像方位很敏感,不同方位下的SAR图像相差很大,由稀疏表示得到的稀疏系数不能完全满足在同类样本位置上的系数值非零,在其余类样本上的系数值为零,此时利用每类样本稀疏系数构成稀疏重构权重矩阵并不能很好地体现出数据的局部结构关系。本文在SPP方法基础上,对目标函数建立准则进行了改进,即在特征空间内保持稀疏重构误差最小的同时使同类样本间距最小。

改进的SPP特征提取方法目标函数的建立从两个方面考虑:

(1) 保持SPP特征提取的目标函数,即

| $\mathop {\min }\limits_u {\rm{tr}}({u^{\rm{T}}}X(I - S - {S^{\rm{T}}} + {S^{\rm{T}}}S){X^{\rm{T}}}u)$ | (10) |

将式(10)的目标函数转化成以下形式:

| $\mathop {\max }\limits_u {\rm{tr}}({u^{\rm{T}}}X(S + {S^{\rm{T}}} - {S^{\rm{T}}}S){X^{\rm{T}}}u)$ | (11) |

(2) 在投影空间建立目标函数使同类样本间距最小,设${y_i} = {u^{\rm{T}}}{x_i},{y_j} = {u^{\rm{T}}}{x_j}$为不同训练样本在投影空间的投影,$i,j = 1,2,\cdots ,N\left( {i \ne j} \right)$,则目标函数的建立如下:

| $\mathop {\min }\limits_u \frac{1}{2}\sum\limits_{i,j} {{\rm{||}}{y_i} - {y_j}|{|^2}{M_{i,j}}} $ | (12) |

通过运算将式(12)化成以下形式:

| \[\begin{array}{*{20}{l}} {\min \frac{1}{2}{\rm{tr}}\{ \sum\limits_{ij} {({y_i}} - {y_j}){{({y_i} - {y_j})}^T}{M_{i,j}}\} }\\ {\quad = \min \frac{1}{2}{\rm{tr}}\{ \sum\limits_{ij} {({y_i}{y_i}^{\rm{T}} - {y_j}{y_i}^{\rm{T}}} }\\ {\quad \quad - {y_i}{y_j}^{\rm{T}} + {y_j}{y_j}^{\rm{T}}){M_{i,j}}\} }\\ {\quad = \min {\rm{tr}}\{ YD{Y^{\rm{T}}} - YM{Y^{\rm{T}}}\} }\\ {\quad = \min {\rm{tr}}\{ Y(D - M){Y^{\rm{T}}}\} }\\ {\quad = \min {\rm{tr}}\{ {u^{\rm{T}}}X(D - M){X^{\rm{T}}}u\} }\\ {\quad = \min {\rm{tr}}\{ {u^{\rm{T}}}XL{X^{\rm{T}}}u\} } \end{array}\] | (13) |

结合式(11)和式(13),可得到改进的稀疏保持投影特征提取方法的目标函数:

| $\mathop {\max }\limits_u \frac{{{\rm{tr}}({u^{\rm{T}}}X(S + {S^{\rm{T}}} - {S^{\rm{T}}}S){X^{\rm{T}}}u)}}{{{\rm{tr}}({u^{\rm{T}}}XL{X^{\rm{T}}}u)}}$ | (14) |

该目标函数表示提取的特征在投影空间不仅能保持样本间的稀疏重构误差最小,还保证了同类样本间距最小。

式(14)的求解等价于求以下特征值分解问题:

| $X{S_\beta }{\rm{ }}{X^{\rm{T}}}u = \lambda XL{X^{\rm{T}}}u$ | (15) |

将式(15)求得的特征值按照从大到小的顺序排列,对应的特征向量为${u_1},{u_2},\cdots ,{u_N}$,取前l个特征值对应的特征向量构成投影矩阵$U = [{u_1},{u_2},\cdots ,{u_l}]$。此时样本${x_i}(i = 1,2,\cdots ,N)$在U上的投影:

| ${q_i}({x_i}) = {U^{\rm{T}}}{x_i}$ | (16) |

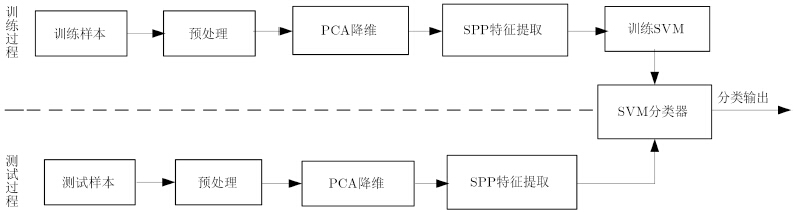

采用本文特征提取方法进行SAR图像目标识别框图如图 1所示,下面对算法的各个步骤进行详细介绍。

| 图 1 SAR目标识别框图 Fig. 1 A diagram of the SAR target recognition |

步骤1 预处理:

(a) 对训练样本集进行对数变换,将乘性噪声转化为加性噪声;

(b) 将对数变换后的样本集进行傅里叶变换,取其幅频特性,以保证目标在图像中的平移不变性,同时利用幅频特性的对称性取一半信息以此来降低样本的维数;

(c) 对幅频特性进行归一化处理,得到预处理后的训练样本。

步骤2 特征提取:由步骤(1)预处理后的图像形成列矢量,并进行PCA处理,以保证当训练样本个数相对于样本维数较小时,式(15)中的XLXT不可逆[12],然后通过式(16)即可得到训练样本集的特征$A = [{q_1}({x_1}),{q_2}({x_2}),\cdots ,{q_N}({x_N})]$。

步骤3 分类:将训练样本集的特征A送到SVM分类器[15]中进行训练,得到已训练的分类器。

4.2 测试过程待识别样本采用与训练过程相同的预处理和特征提取方法提取样本特征,并送入已训练好的SVM分类器进行分类,得到测试样本的类别。

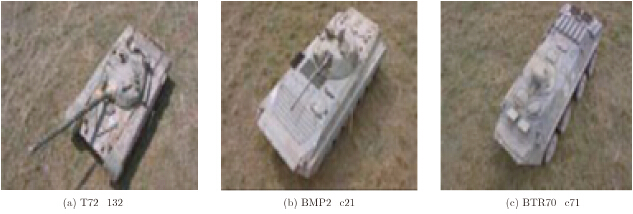

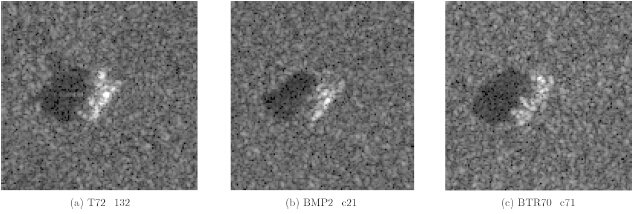

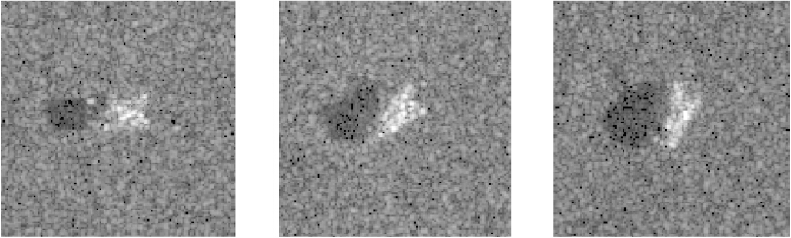

5 实验结果与分析 5.1 实验数据本实验所用数据是由美国DARPA/AFRL MSTAR工作组提供的实测SAR地面静止目标数据。该数据包括3大类目标,共7种型号SAR图像,训练样本是在俯仰角为17°时的成像数据,包括T72_132,BMP2_c21,BTR70_c71 3类目标,测试样本是在俯仰角为15°时的成像数据,包括T72的3种型号(T72_132,T72_812,T72_s7)、BMP2的3种型号(BMP2_c21,BMP2_9563,BMP2_9566)和BTR70_c71共7种型号目标。图像大小均为128×128,成像方位为0°~360°。图 2给出了3种训练样本的光学图像,图 3给出了3种训练样本在某一方位角下的SAR图像,图 4给出了T72_132在不同方位下的图像,表 1给出了样本具体类别型号及样本数。

| 图 2 3类军用目标的光学图像 Fig. 2 The optical image of three military targets |

| 图 3 3类军用目标的SAR图像 Fig. 3 The SAR image of three military targets |

| 图 4 T72_132在3个不同方位角下的SAR图像 Fig. 4 T72_132 under three different azimuth of SAR images |

| 表 1 3类目标训练样本和测试样本 Tab. 1 The training and testing samples in experiments |

实验中,为了提高运算速度,将每幅图像截取图像子块(65×65),待识别样本经过PCA降维后得到样本维数为233,SVM分类器中核函数选取高斯径向基核函数,$K({x_i},x) = \exp ( - \gamma * ||{x_i} - x|{|^2})$,核参数γ=44。

表 2给出了特征维数l=100时本文方法的识别结果,由表 2可知,本文方法对T72_132,T72_s7,BMP2_c21以及BTR70_c71 4种型号目标都有很好的识别结果,识别率都达到了100%,此外,对其他型号的目标识别率都在90%以上,平均识别率为97.81%。

| 表 2 各类目标的识别率 Tab. 2 The recognition rate of different samples |

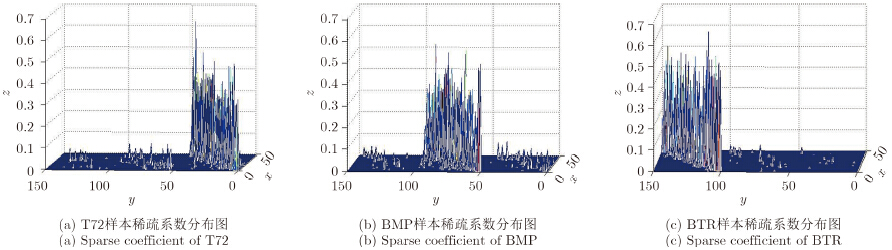

图 5给出了T72,BMP和BTR 3类目标的稀疏系数分布图,其中每类目标取前50个样本,x轴表示稀疏重构权重矩阵的行,y轴表示稀疏重构权重矩阵的列,z轴表示稀疏重构权重矩阵的值,y轴序号为1~50对应样本分布在T72目标所在的区域,y轴序号为51~100对应样本分布在BMP目标所在的区域,y轴序号为101~150对应样本分布在BTR目标所在的区域。由图 5(a)可知,T72样本稀疏系数非零值主要分布在y轴序号为1~50的区域,即T72目标所在的区域,且在该区域的系数值很大,在其他区域的系数值很小或者为零,由图 5(b)可知,BMP样本稀疏系数非零值主要分布在y轴序号为51~100的区域,即BMP目标所在的区域,且在该区域的系数值很大,在其他区域的系数值很小或者为零,由图 5(c)可知,BTR样本稀疏系数非零值主要分布在y轴序号为101~150的区域,即BTR目标所在的区域,且在该区域的系数值很大,在其他区域的系数值很小或者为零。由此表明样本非零大系数值主要分布在每类样本所在的区域,所得的稀疏系数可描述目标的特征。

| 图 5 3类样本稀疏系数分布图 Fig. 5 Sparse coefficient distribution of three types of samples |

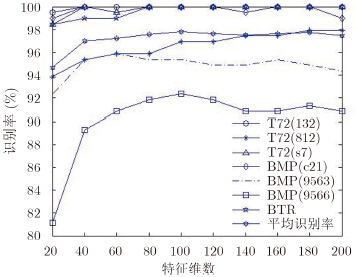

图 6给出了本文方法在不同l取值下的识别结果。由图 6可知,特征维数l的不同会直接影响识别结果,随着特征维数的增加,平均识别率总体呈现增长的趋势。但是对于BMP2_9563和BMP2_9566来说,其识别率随着特征维数的变化波动比较大,这是因为这两类目标是变体且其SAR图像质量明显劣于其它类目标。

| 图 6 不同特征维数下本文方法的识别结果 Fig. 6 The recognition results of this method under different characteristic dimension |

另外,将本文方法与SPP方法进行比较,实验结果如表 3所示,其中SPP方法与本文方法的处理过程相同,且都利用SVM分类器分类识别,T72的识别结果表示T72 3种型号目标的平均识别率,BMP的识别结果表示BMP 3种型号目标的平均识别率。由表 3可知,本文方法在T72和BMP两类目标识别结果上都优于SPP特征提取方法,且平均识别率为97.81%,优于SPP方法。

| 表 3 不同特征提取方法的识别结果比较 Tab. 3 The recognition results of different feature extraction |

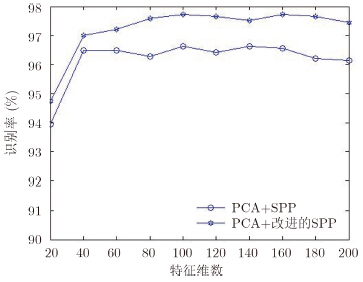

图 7还给出了两种方法在不同特征维数l下的识别结果比较。由图 7可知,本文方法明显优于SPP特征提取方法,当特征维数为40时,本文方法识别结果已达到97%,说明当特征维数较低时,本文方法仍能取得较好的识别结果。

| 图 7 两种方法不同特征维数下的识别结果比较 Fig. 7 Two methods of comparing the identification results under different characteristic demension |

本文是在SPP特征提取方法的基础上进行改进的,SPP特征提取方法根据稀疏重构误差最小得到样本的特征向量,而本文方法以保证稀疏重构误差最小的同时保证同类样本类内距最小为目标函数,确定投影空间提取特征向量,最后利用SVM分类器进行分类识别。实验结果表明该方法在方位角未知的情况下能有效提高目标的正确识别率,是一种有效的识别方法。

| [1] | Alpert B K. A class of bases in L2 for sparse representation of integral operators[J]. SIAM Journal on Mathematical Analysis, 1993, 24(1): 246-262.( 1) 1) |

| [2] | Olshausen B A, Sallee P, and Lewicki M S. Learning Sparse Image Codes Using a Wavlet Pyramid Architecture[C]. Advances in Neural Information Processing Systems, 2001: 887-893.( 1) 1) |

| [3] | 邓承志, 曹汉强. 多尺度脊波字典的构造及其在图像编码中的应用[J]. 中国图象图形学报, 2009, 14(7): 1273-1278. Deng Cheng-zhi and Cao Han-qiang. Construction of multiscale ridgelet dictionary and its application for image coding[J]. Journal of Image and Graphics, 2009, 14(7): 1273-1278.(  1) 1) |

| [4] | LI S T, YIN H T, and FANG L Y. Group sparse representation with dictionary learning for medical image denoising and fusion[J]. IEEE Transactions on Biomedical Engineering, 2012, 59(12): 3450-3459.( 1) 1) |

| [5] | 马路, 邓承志, 汪胜前, 等. 特征保留的稀疏表示图像去噪[J]. 计算机应用, 2013, 33(5): 1416-1419. Ma Lu, Deng Cheng-zhi, Wang Sheng-qian, et al. Feature-retained image de-noising via sparse representation[J]. Journal of Computer Applications, 2013, 33(5): 1416-1419.(  1) 1) |

| [6] | Wright J, Yang A Y, Ganesh A, et al.. Robust face recognition via sparse representation[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2009, 31(2): 210-227.( 1) 1) |

| [7] | 胡正平, 赵淑欢. 分辨性分解块稀疏表示遮挡人脸识别算法[J]. 信号处理, 2014, 30(2): 214-220. Hu Zheng-ping and Zhao Shu-huan. Discriminative decomposition structure sparse representation for face recognition with occlusion[J]. Journal of Signal Processing, 2014, 30(2): 214-220.(  1) 1) |

| [8] | 刘中杰, 庄丽葵, 曹云峰, 等. 基于主元分析和稀疏表示的SAR图像目标识别[J]. 系统工程与电子技术, 2013, 35(2): 282-286. Liu Zhong-jie, Zhuang Li-kui, Cao Yun-feng, et al. Target recognition of SAR images using principal component analysis and sparse representation[J]. Systems Engineering and Electronics, 2013, 35(2): 282-286.(  2) 2) |

| [9] | 王燕霞, 张弓. 基于特征参数稀疏表示的SAR图像目标识别[J]. 重庆邮电大学学报(自然科学版), 2012, 24(3): 308-313. Wang Yan-xia and Zhang Gong. Target recognition in SAR images using sparse representation based on feature space[J]. Journal of Chongqing University of Posts and Telecommunications National Science Edition (Natural Science Edition), 2012, 24(3): 308-313.(  1) 1) |

| [10] | LIU M, WU Y, and ZHANG Q, et al. Dempster-shafer fusion of multiple sparse representation and statistical property for SAR target configuration recognition[J]. IEEE Geoscience and Remote Sensing Letters, 2014, 11(6): 1106-1110.( 1) 1) |

| [11] | 韩萍, 王欢. 结合KPCA和稀疏表示的SAR目标识别方法研究[J]. 信号处理, 2013, 29(12): 1696-1701. Han Ping and Wang Huan. Research on the synthetic aperture radar target recognition based on KPCA and sparse representation[J]. Journal of Signal Processing, 2013, 29(12): 1696-1701.(  1) 1) |

| [12] | QIAO L S, CHEN S C, and TAN X Y. Sparsity preserving projections with applications to face recognition[J]. Pattern Recognition, 2010, 43(1): 331-341.( 2) 2) |

| [13] | He X F and Niyogi P. Local Preserving Projections[C]. Proceedings of Conference on Advances in Neural Information Processing Systems, 2003: 153-160.( 1) 1) |

| [14] | Figueiredo M A T, Nowak R D, and Wright S J. Gradient projection for sparse reconstruction: application to compressed sensing and other inverse problems[J]. IEEE Journals of Selected Topics in Signal Processing, 2007, 1(4): 586-597.( 1) 1) |

| [15] | Bryant M and Garber F. SVM classifier applied to the MSTAR public data set[C]. SPIE Algorithm for Synthetic Aperture Rader Imagery, Orlando, FL, 1999, 3721: 662-672.( 1) 1) |

2015, Vol. 4

2015, Vol. 4